01.ai của Trung Quốc huấn luyện mô hình AI cạnh tranh với GPT-4 chỉ với 2.000 GPU và chi phí 3 triệu USD

- Công ty 01.ai của Trung Quốc đã huấn luyện mô hình AI tiên tiến chỉ với 2.000 GPU và chi phí 3 triệu USD, trong khi OpenAI chi 80-100 triệu USD cho GPT-4

- Theo biểu đồ của UC Berkeley, mô hình Yi-Lightning của 01.ai đứng thứ 6 về hiệu suất trong bảng xếp hạng LMSIS

- Kai-Fu Lee, người sáng lập 01.ai, cho biết công ty phải đối mặt với 2 thách thức lớn:

+ Hạn chế tiếp cận GPU do quy định của Mỹ

+ Bất lợi về định giá so với các công ty AI Mỹ

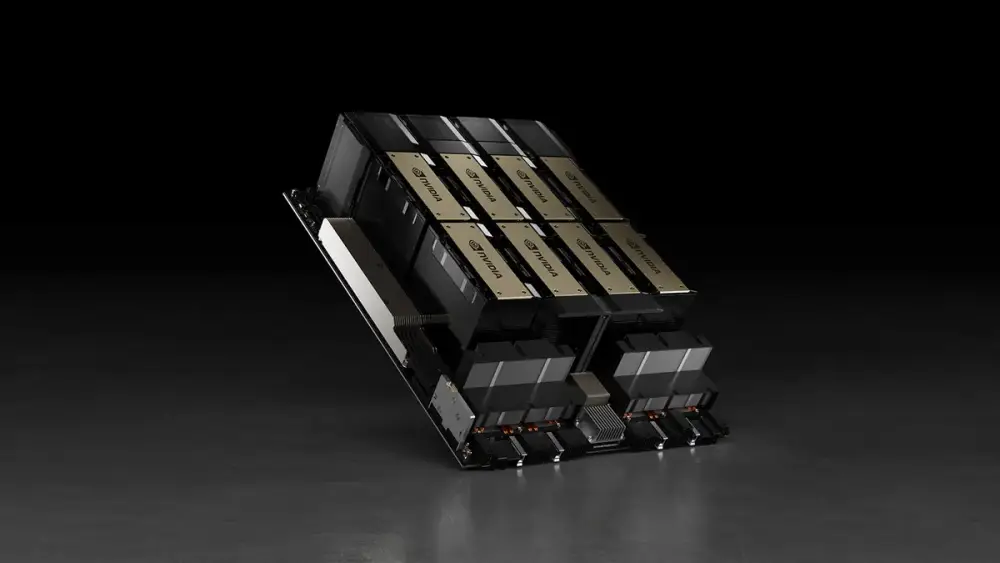

- OpenAI được cho là đã sử dụng:

+ 10.000 GPU Nvidia A100 để huấn luyện GPT-3

+ Nhiều GPU H100 hơn để huấn luyện GPT-4 và GPT-4o

+ Dự kiến chi khoảng 1 tỷ USD cho GPT-5

- 01.ai đã tối ưu hóa hiệu suất bằng cách:

+ Chuyển đổi yêu cầu tính toán thành tác vụ bộ nhớ

+ Xây dựng hệ thống bộ nhớ đệm đa tầng

+ Thiết kế động cơ suy luận chuyên biệt

- Chi phí suy luận của 01.ai chỉ 10 cent/triệu token, thấp hơn 30 lần so với các mô hình tương đương

📌 Với nguồn lực hạn chế (2.000 GPU, 3 triệu USD), 01.ai đã tạo ra mô hình Yi-Lightning đứng thứ 6 về hiệu suất toàn cầu, chứng minh việc tối ưu hóa kỹ thuật có thể mang lại kết quả tương đương với chi phí thấp hơn 96% so với các đối thủ.

https://www.tomshardware.com/tech-industry/artificial-intelligence/chinese-company-trained-gpt-4-rival-with-just-2-000-gpus-01-ai-spent-usd3m-compared-to-openais-usd80m-to-usd100m

Thảo luận

Follow Us

Tin phổ biến