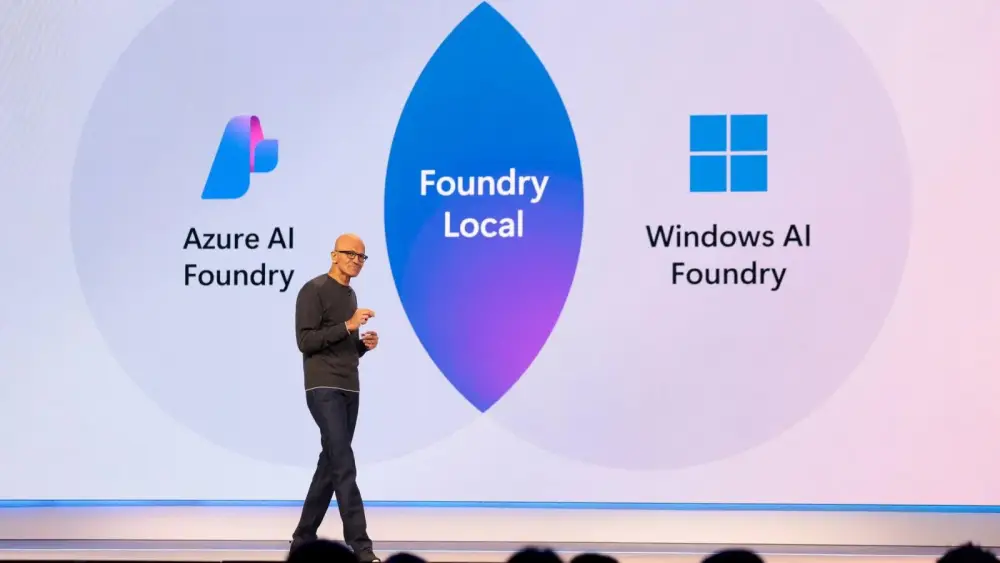

CEO Microsoft nói về cách AI sẽ định hình lại mọi công ty

-

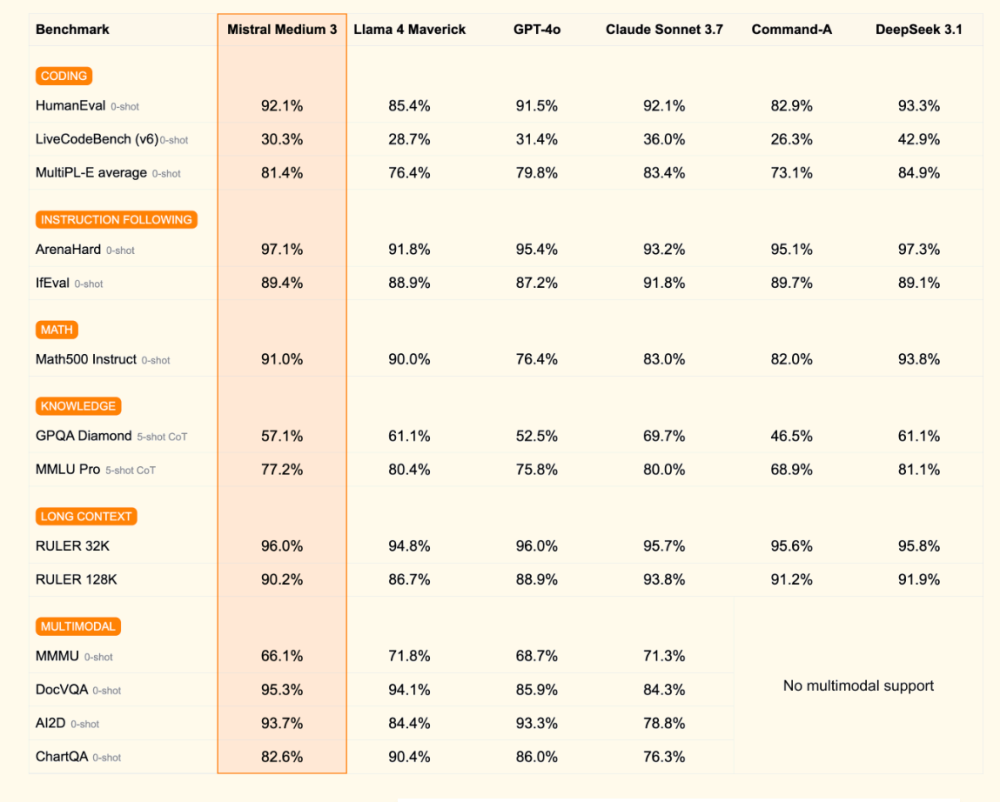

Satya Nadella bị bất ngờ tại Diễn đàn Kinh tế Thế giới khi startup Trung Quốc DeepSeek tung mô hình AI R1, mạnh ngang OpenAI nhưng chỉ tốn 36 USD so với 1.000 USD, và còn mã nguồn mở.

-

Thay vì loại bỏ đối thủ, Nadella tích hợp R1 lên nền tảng Azure, cho phép khách hàng chọn mô hình AI tùy theo nhu cầu và chi phí, từ OpenAI, Meta đến DeepSeek.

-

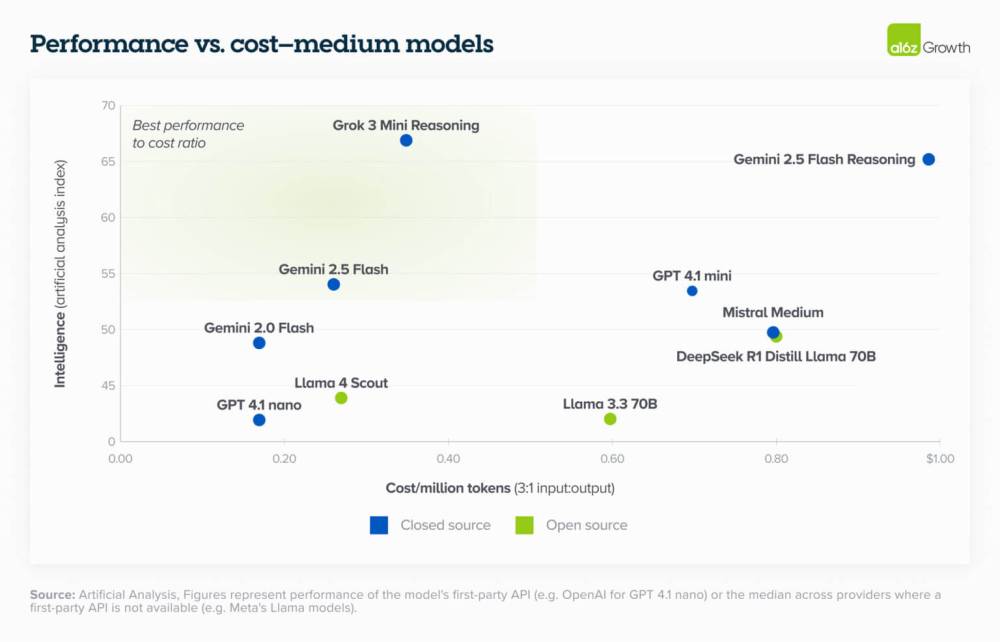

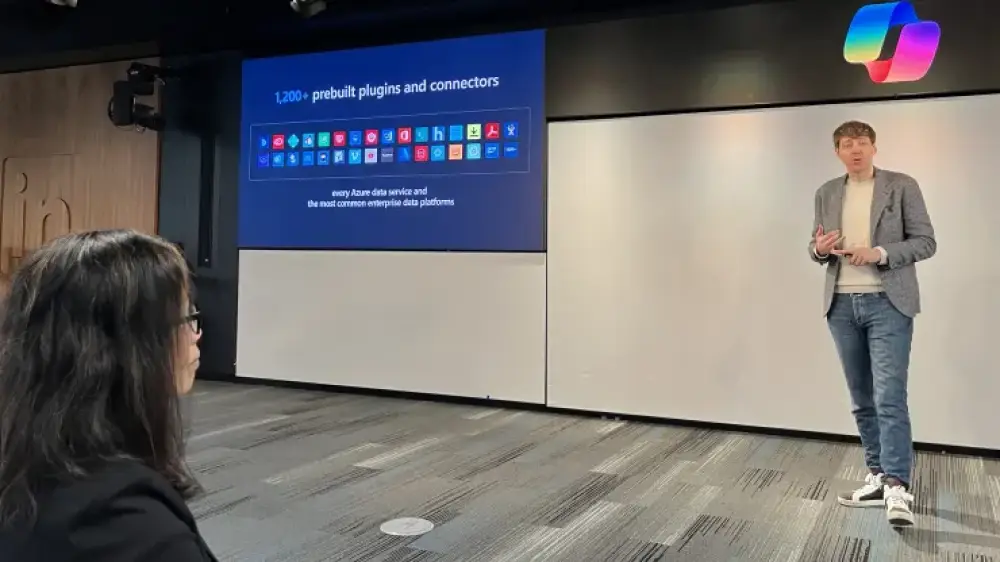

Microsoft hiện cung cấp hơn 1.900 mô hình AI khác nhau trên Azure, kiếm lợi từ phí lưu trữ, điện toán đám mây, bảo mật, hơn là chỉ bán AI.

-

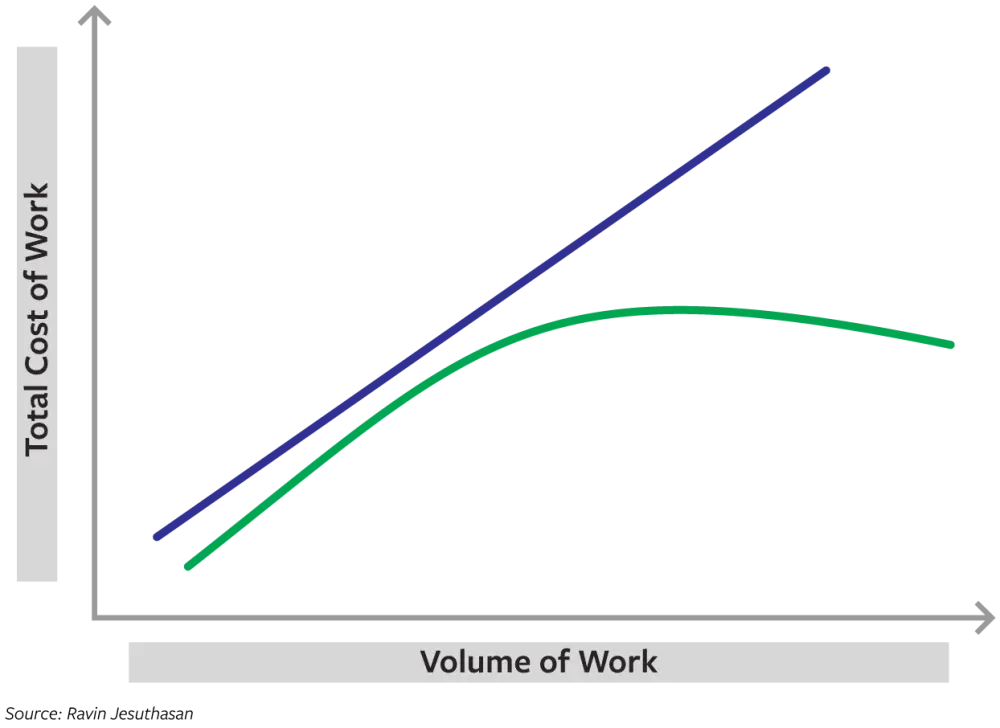

Nadella nhấn mạnh AI đang bước vào giai đoạn "hàng hóa hóa" như từng xảy ra với than đá theo nghịch lý Jevons: càng rẻ, càng tăng nhu cầu.

-

Microsoft phát triển dòng MAI-2 nội bộ – mô hình tương tự ChatGPT nhưng tiết kiệm chi phí, đề phòng rủi ro nếu OpenAI gặp sự cố.

-

Mối quan hệ với OpenAI trở nên căng thẳng sau vụ Sam Altman bị sa thải năm 2023, khiến Nadella dừng đầu tư thêm hàng chục tỉ USD vào startup này.

-

Nadella chi 650 triệu USD để mua công nghệ và tuyển đội ngũ từ Inflection AI, đặt Mustafa Suleyman phụ trách mảng AI tiêu dùng.

-

Copilot được nâng cấp theo hướng "đồng cảm", giúp người dùng tương tác như một người bạn hoặc nhà trị liệu.

-

Dù Copilot vẫn yếu thế so với ChatGPT (chỉ chiếm 4,9% thị phần chatbot toàn cầu), Microsoft đã có hơn 70% công ty Fortune 500 sử dụng dịch vụ.

-

Các khách hàng như Nestlé, Moderna, Estée Lauder dần nhận thấy Copilot hữu ích, đặc biệt trong tóm tắt cuộc họp và tự động hóa công việc tẻ nhạt.

-

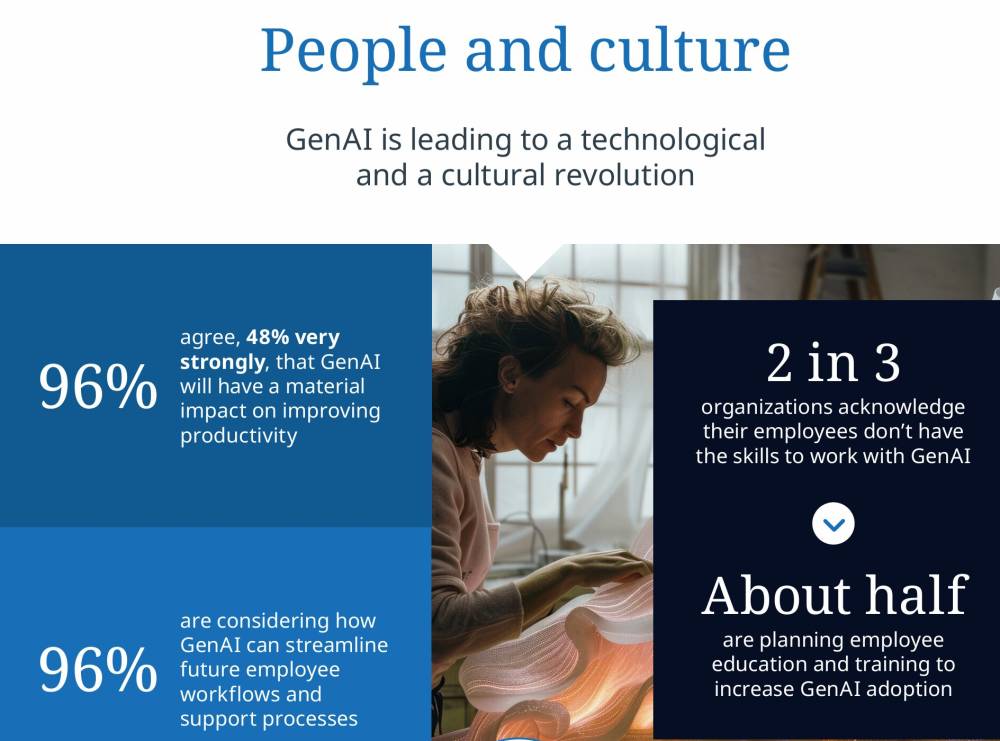

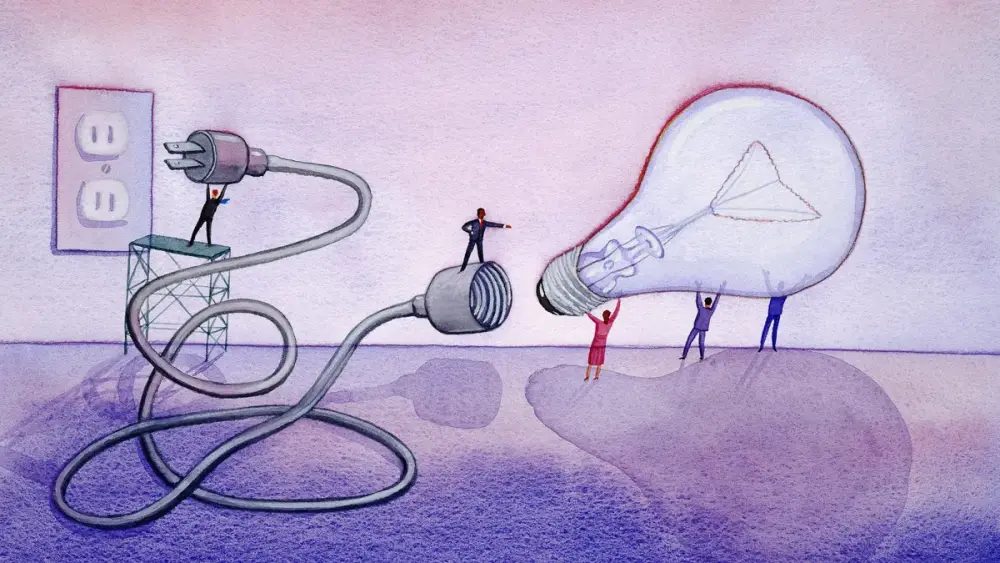

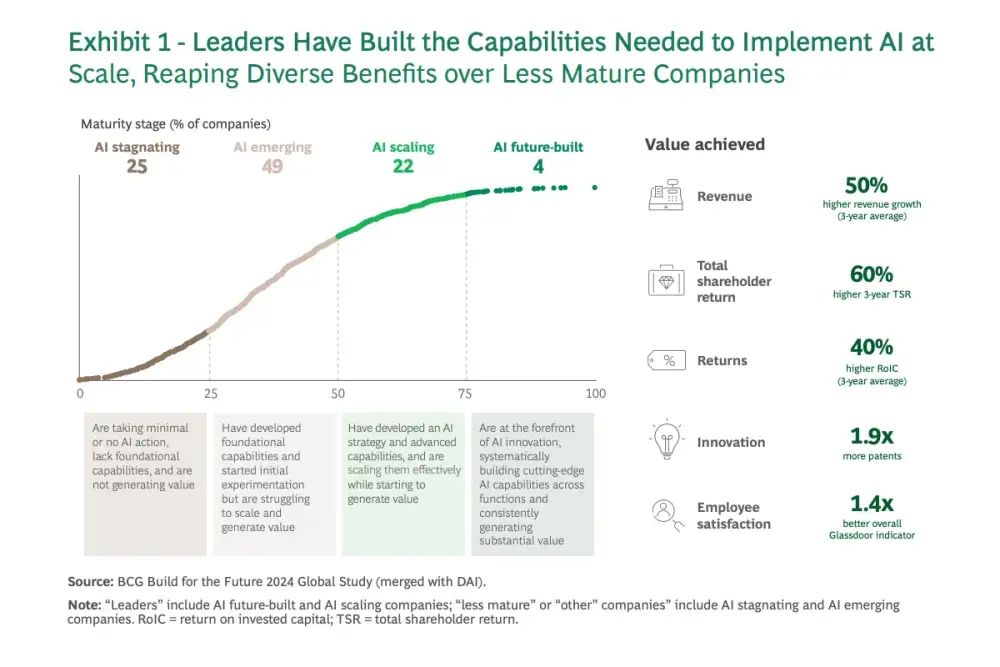

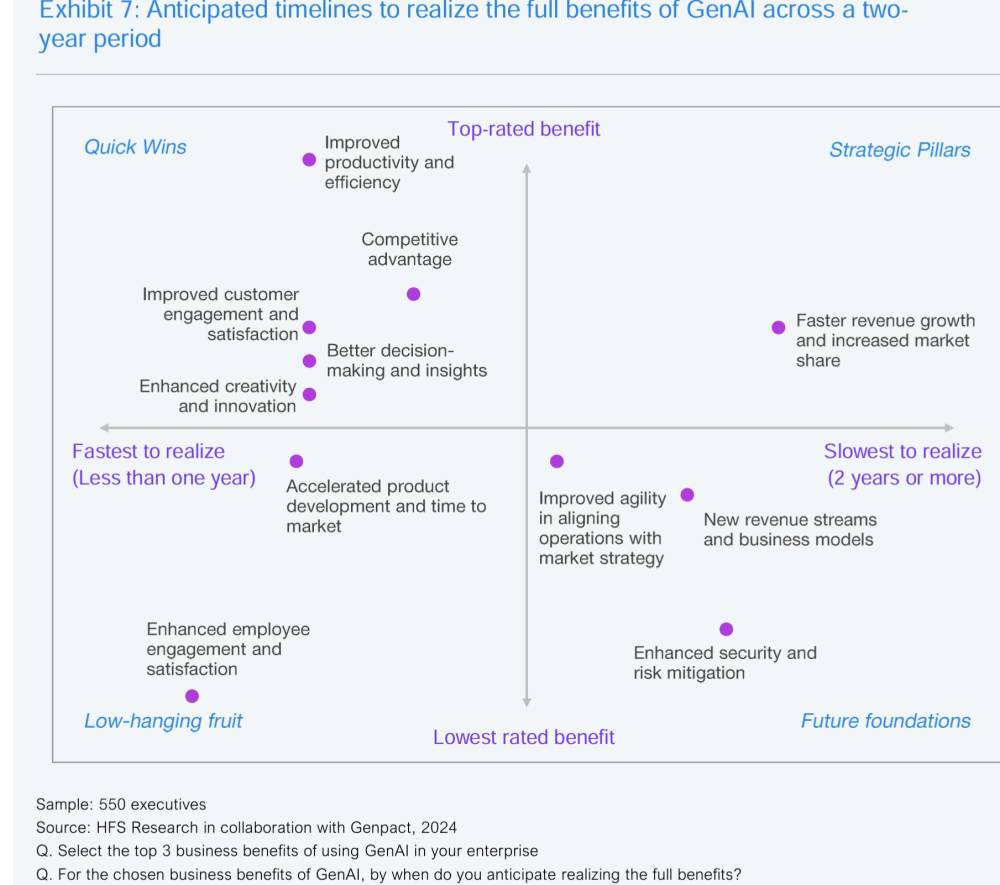

Nadella cam kết đầu tư hàng trăm tỉ USD vào AI để tạo ra hàng ngàn tỉ USD giá trị kinh tế, tin tưởng AI sẽ thúc đẩy năng suất toàn xã hội giống như điện và internet từng làm.

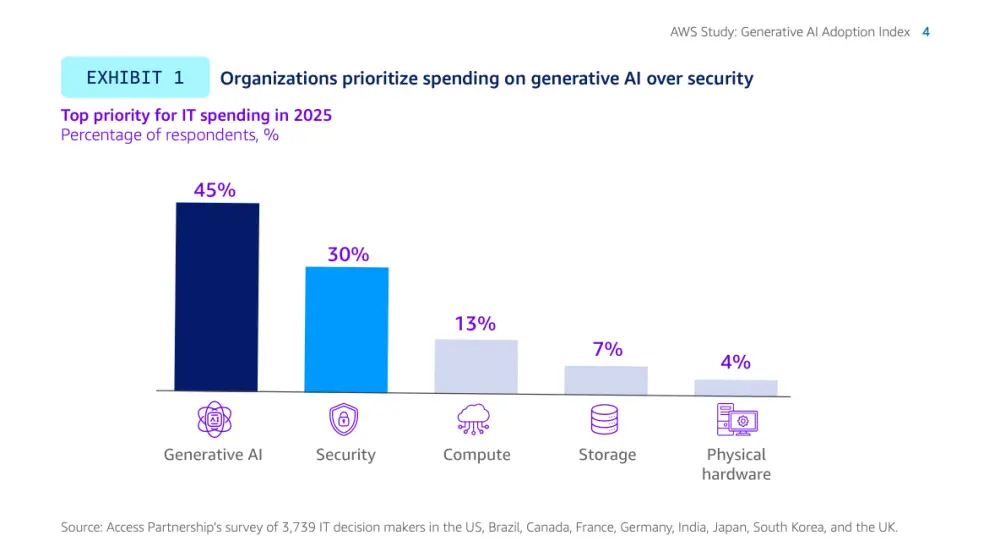

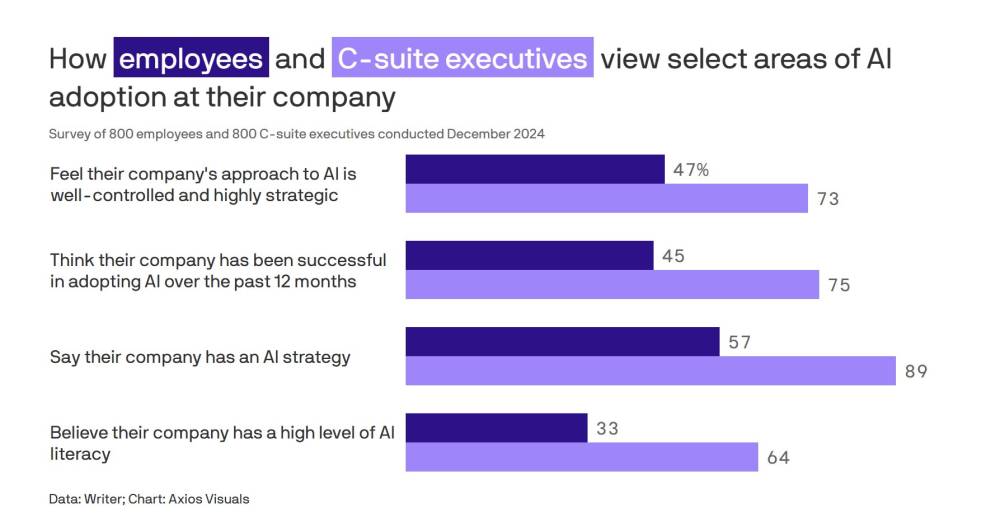

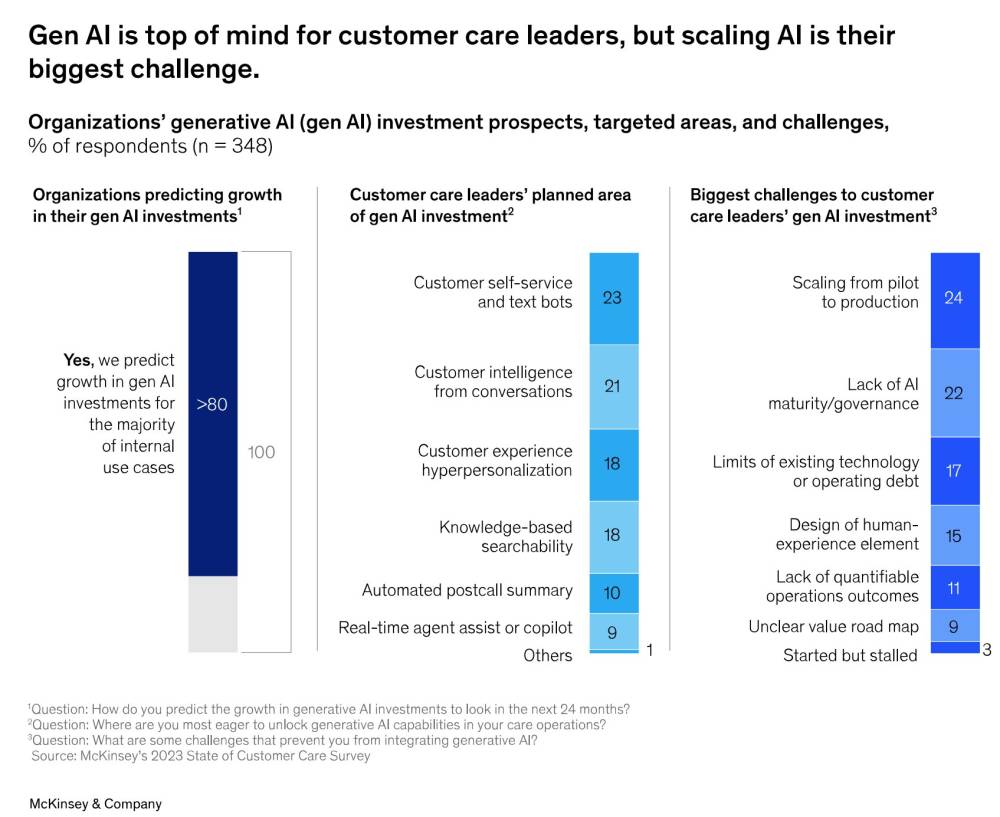

📌 Microsoft đang đối mặt với áp lực kép: cạnh tranh từ mô hình AI mã nguồn mở DeepSeek-R1 và sự rạn nứt với đối tác OpenAI. Nadella phản ứng linh hoạt bằng cách thương mại hóa mọi mô hình AI trên Azure, phát triển MAI-2 để tự chủ và đầu tư vào AI tiêu dùng giàu cảm xúc. Copilot đã thu hút 70% các công ty Fortune 500 và đạt doanh thu AI dự kiến hơn 13 tỉ USD/năm, dù thị phần chatbot vẫn kém xa ChatGPT (80,6%).

https://www.bloomberg.com/news/features/2025-05-15/microsoft-ceo-satya-nadella-on-his-ai-efforts-and-openai-partnership

CEO Microsoft nói về cách AI sẽ định hình lại mọi công ty, kể cả công ty của ông

Khách hàng lo lắng và mối quan hệ đối tác biến động với OpenAI đang gây khó khăn cho Satya Nadella và công ty có giá trị lớn nhất thế giới.

Bài viết của Austin Carr và Dina Bass

Ngày 15 tháng 5 năm 2025

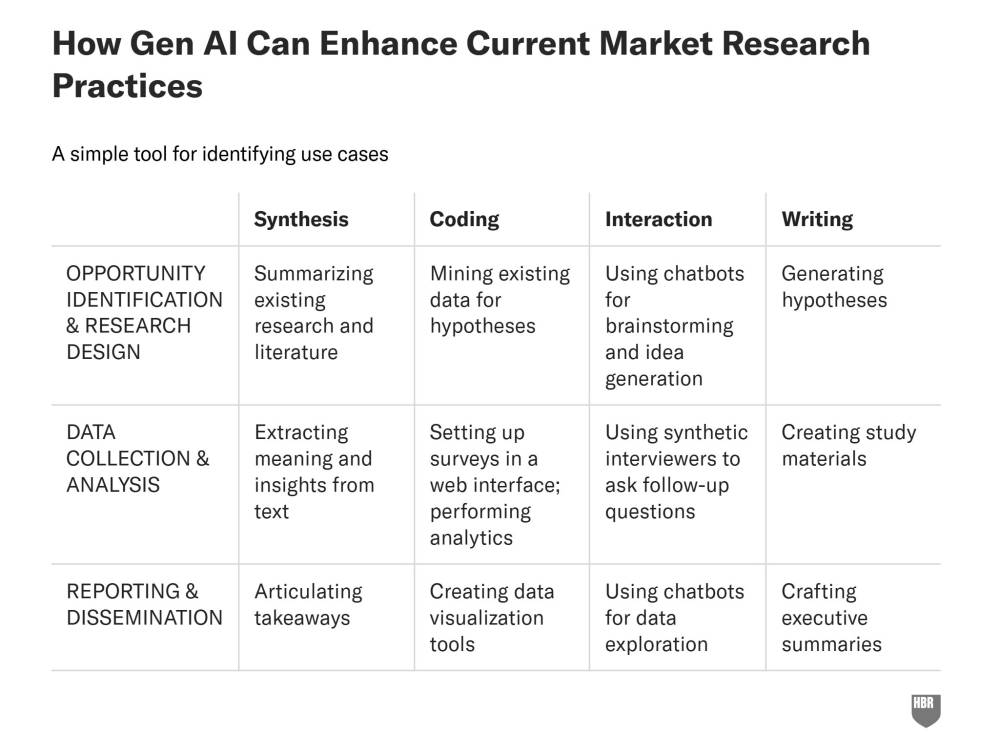

Satya Nadella đến Diễn đàn Kinh tế Thế giới vào tháng 1 sẵn sàng khoe khoang thành tựu trí tuệ nhân tạo của mình, khi một mối đe dọa nguy hiểm xuất hiện. Một startup Trung Quốc ít được biết đến tên DeepSeek vừa phát hành một mô hình AI nhanh chóng trở thành chủ đề bàn tán ở Davos, Thụy Sĩ. Nadella, giám đốc điều hành của Microsoft Corp., tập hợp các phụ tá để đánh giá sự cạnh tranh bất ngờ này. Họ thiết lập một phòng chiến tranh ảo trên Microsoft Teams để phối hợp phản ứng.

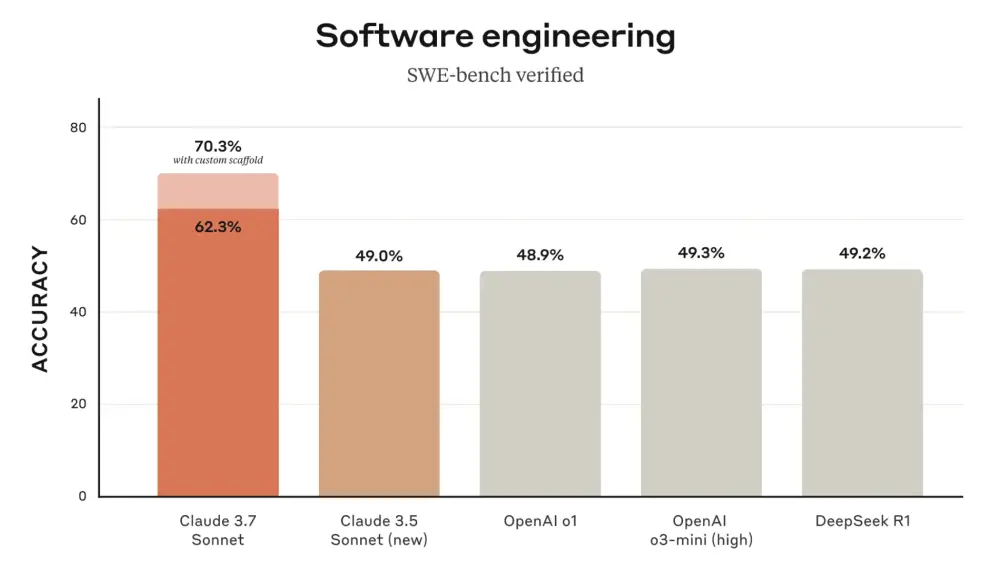

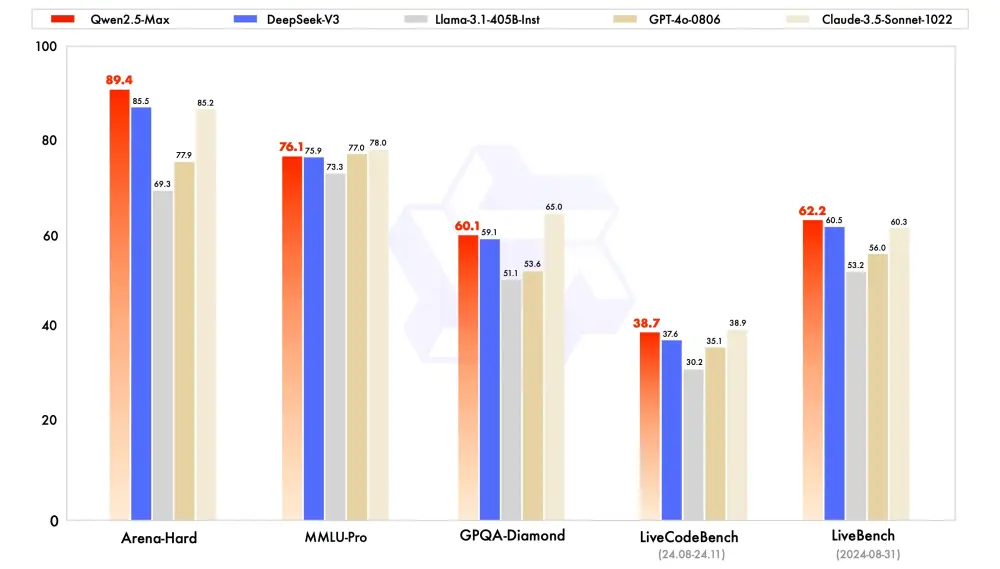

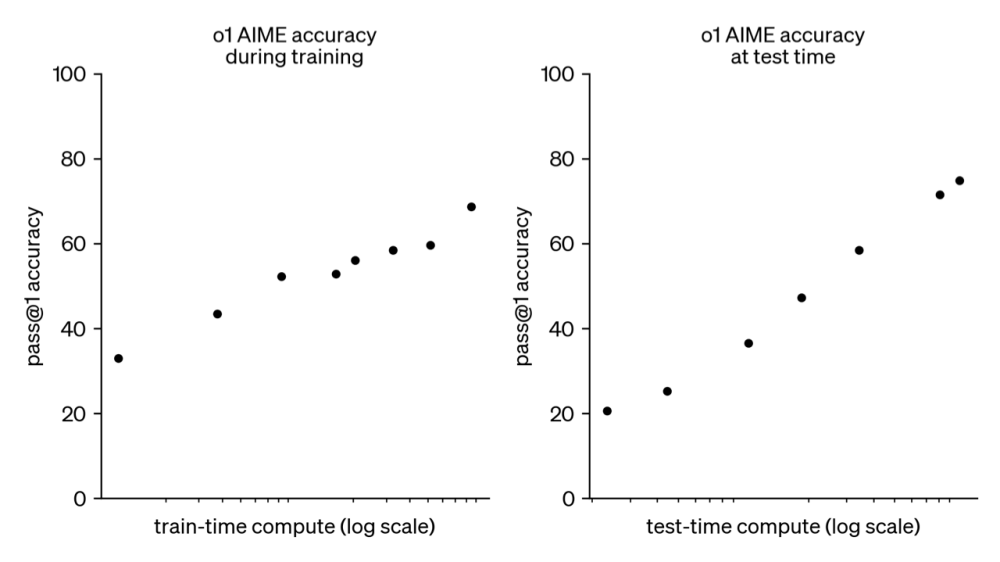

Mô hình mới, DeepSeek-R1, có thể mang lại kết quả tương đương với OpenAI nhưng với giá rẻ hơn nhiều. Xử lý máy tính qua OpenAI tốn 1.000 đô la chỉ mất 36 đô la qua R1. Điều còn điên rồ hơn, DeepSeek đã làm cho R1 trở thành mã nguồn mở, nghĩa là bất kỳ ai cũng có thể cài đặt các phiên bản miễn phí nếu có máy tính đủ mạnh. "OpenAI đã dẫn đầu quá xa đến nỗi không ai thực sự tiến gần được," Nadella nói với Bloomberg Businessweek. "DeepSeek, và đặc biệt là R1, là mô hình đầu tiên tôi thấy ghi điểm."

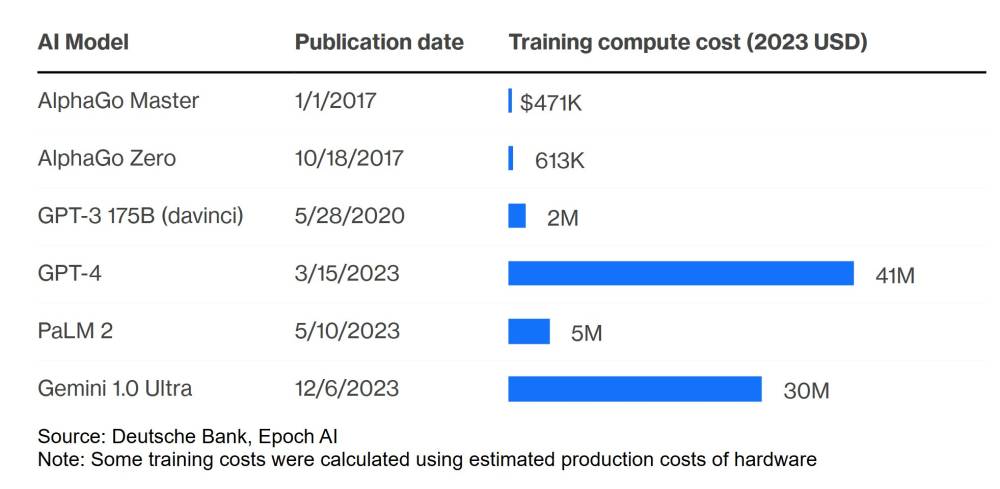

Với những người giao lưu ở Davos, điều này dường như là một vấn đề lớn cho Microsoft. Công ty đã đầu tư 13,75 tỷ đô la vào OpenAI vào thời điểm đó và đã cam kết chi 80 tỷ đô la cho các trung tâm dữ liệu AI chỉ trong năm tài chính này, tất cả dựa trên giả định rằng AI tốt hơn cần nhiều tài nguyên điện toán hơn. Nadella ngay lập tức yêu cầu nhóm của mình tiến hành đánh giá bảo mật của DeepSeek-R1. Họ xem xét kỹ lưỡng bài báo nghiên cứu DeepSeek công bố về công việc của họ và liên hệ với các kỹ sư của startup, liên tục đặt câu hỏi về mô hình. (Ít người khác thậm chí có thể nhận được phản hồi email từ công ty Trung Quốc kín tiếng này.)

Chẳng bao lâu sau, khoảng 100 nhân viên Microsoft ra vào các phòng họp video Teams để kiểm tra bảo mật mã nguồn của DeepSeek và trao đổi ghi chú. "Mọi người không ngủ," Asha Sharma, người đứng đầu nền tảng AI của công ty, người đi đầu trong nỗ lực này, nói. "Là 48 giờ xem xét từng thứ." R1 có vẻ hợp pháp. Nhưng thay vì cố gắng loại bỏ đối thủ mới này, Nadella chọn cách chấp nhận nó. Ông chỉ đạo nhóm của mình cài đặt R1 trên đám mây của Microsoft và bán quyền truy cập vào đó cho khách hàng cùng với các sản phẩm từ OpenAI và Microsoft. "Tung ra đi," Nadella nhớ lại đã nói với nhân viên của mình.

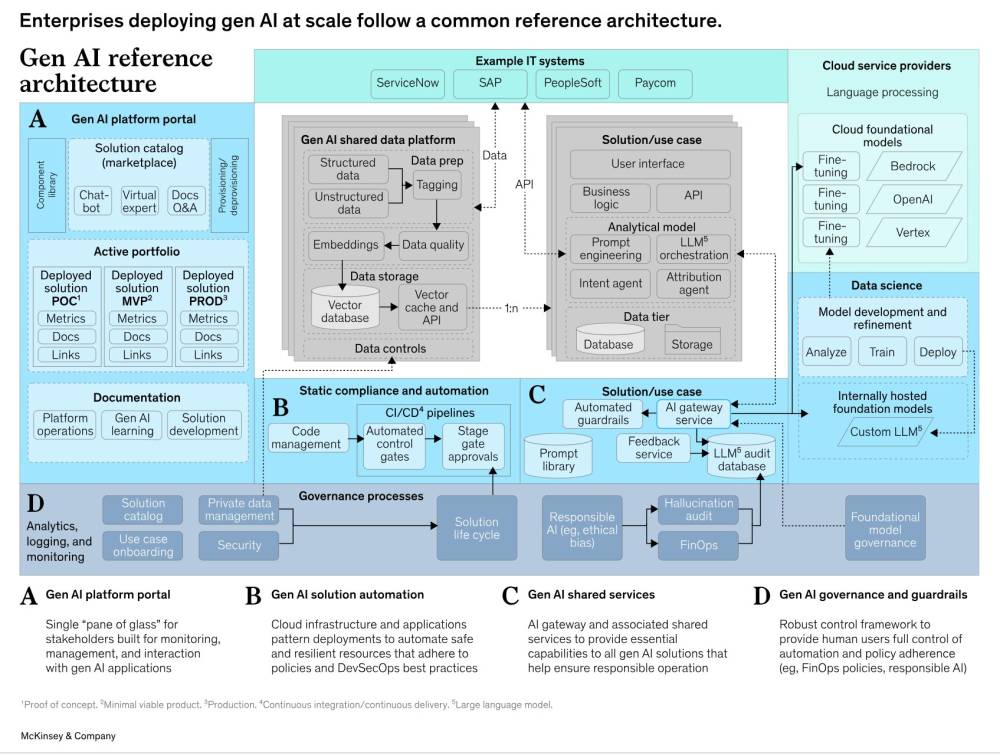

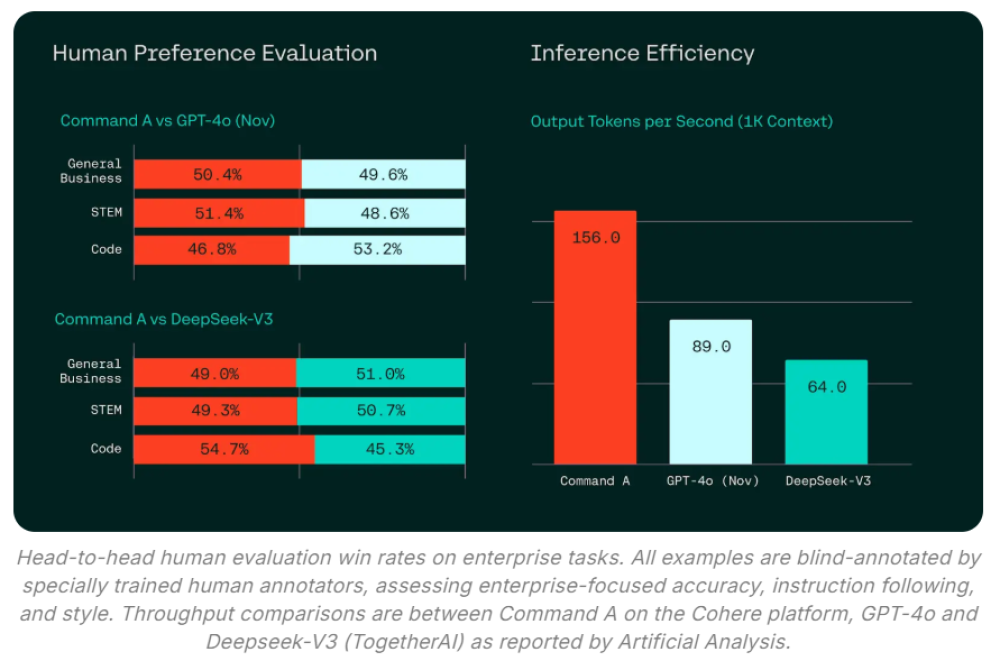

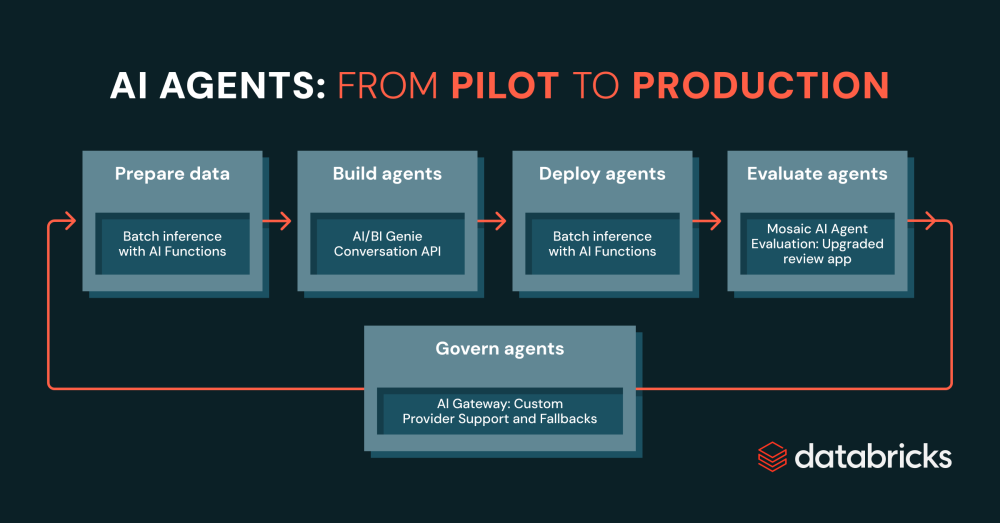

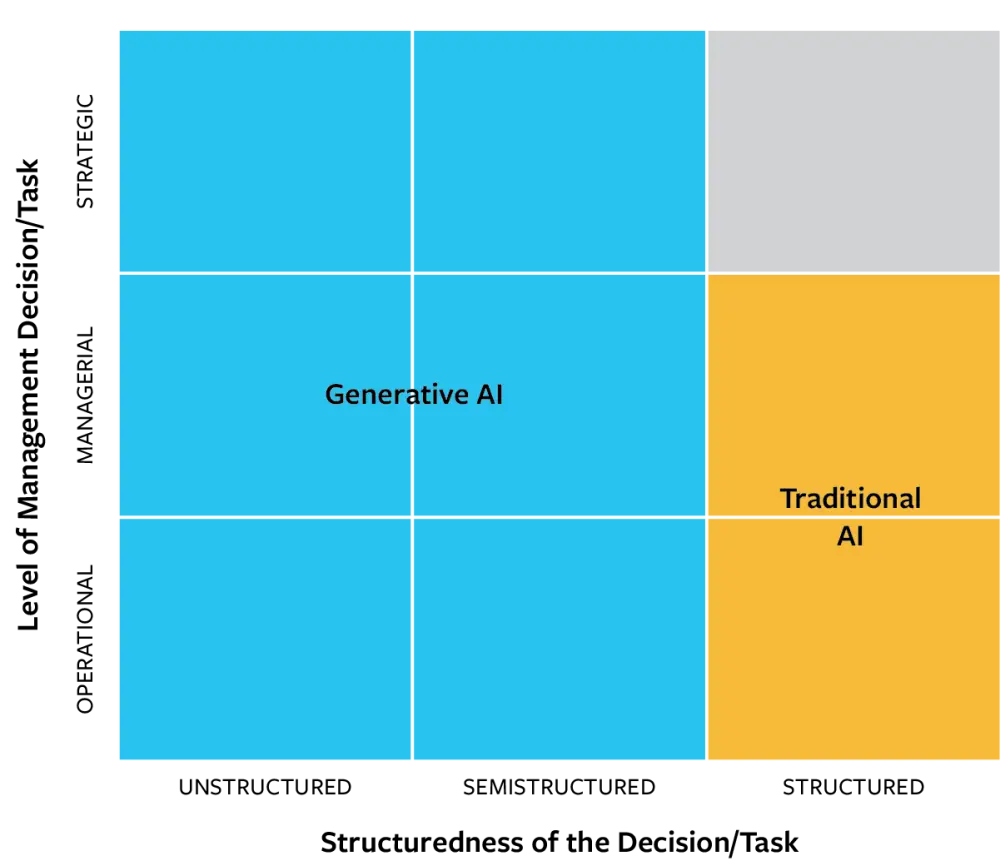

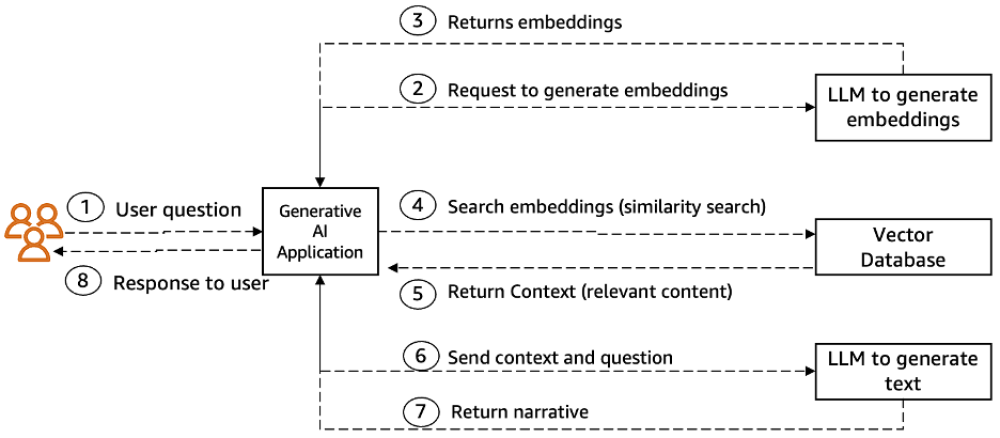

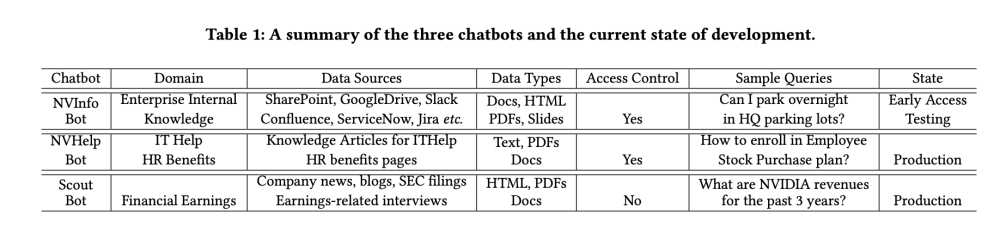

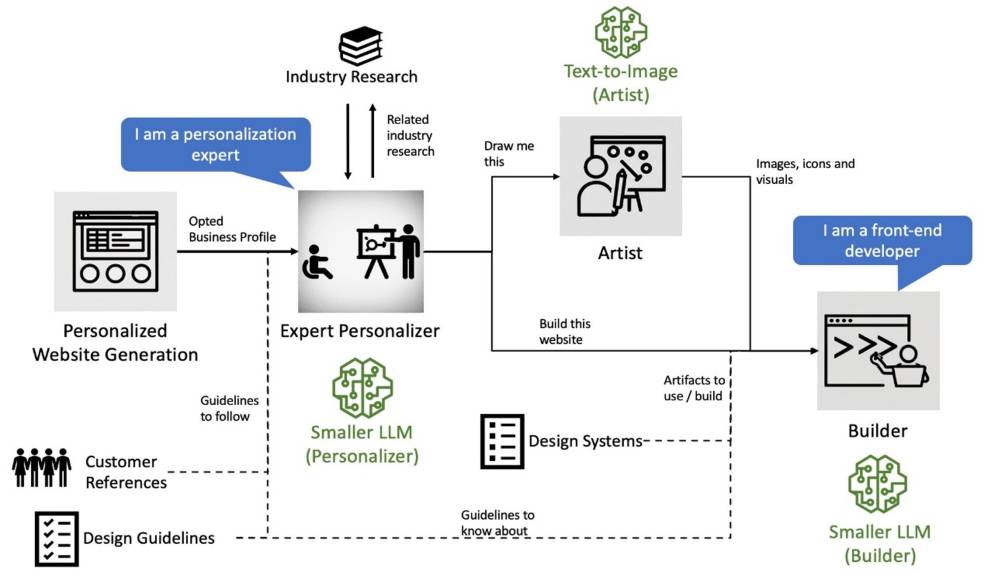

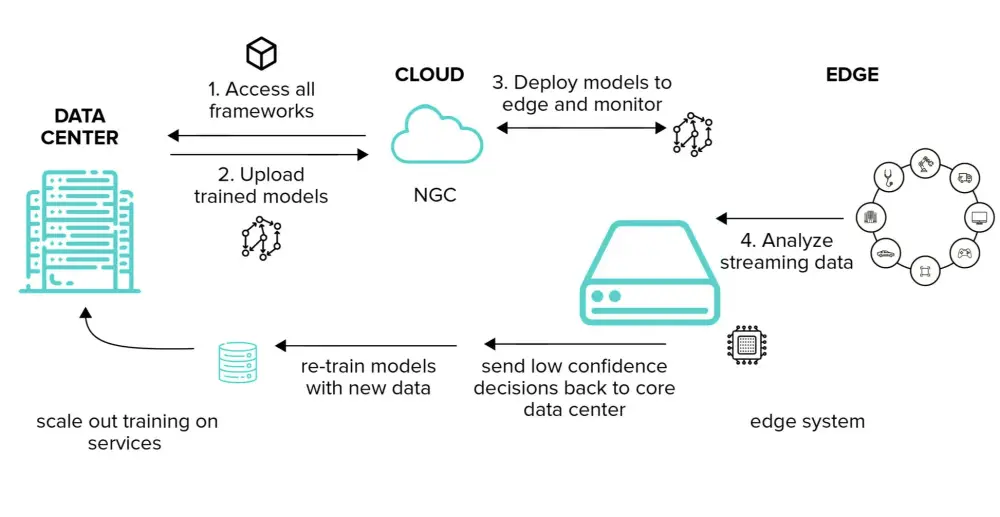

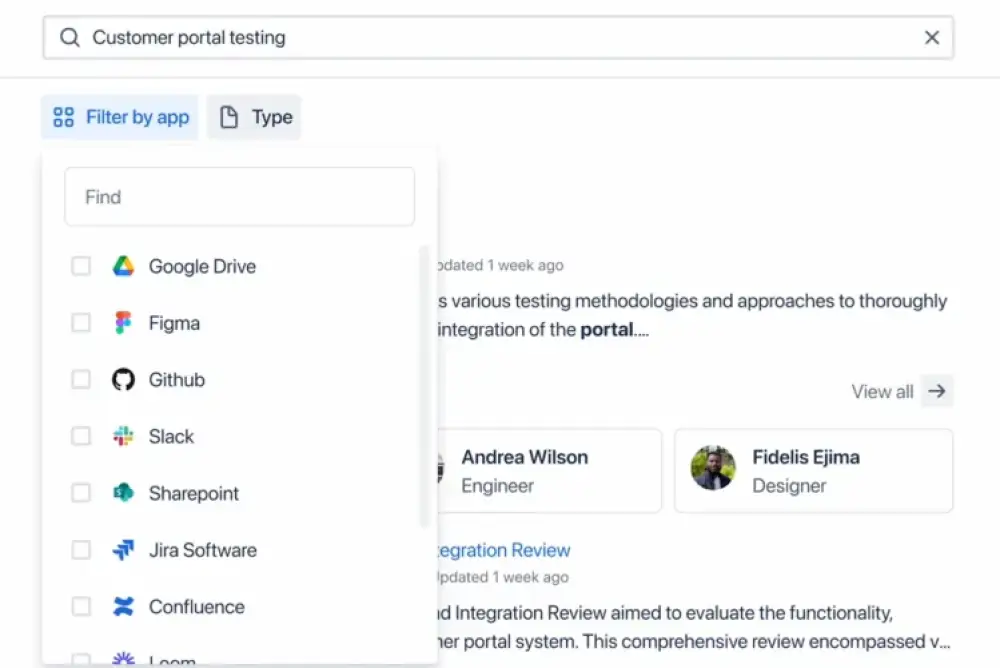

Lòng trung thành hàng đầu của Nadella giờ đây không phải với những dự án bí mật rất đắt tiền của OpenAI. Mục tiêu cuối cùng của ông là bán bất kỳ AI nào khách hàng có thể muốn thông qua nền tảng Microsoft. Nadella đã dành ba năm điều hành các bộ phận khác nhau của dịch vụ đám mây của công ty, được gọi là Azure, trước khi trở thành CEO vào năm 2014, và hiện tại đó là trung tâm chiến lược AI của ông. Khách hàng có thể lựa chọn từ hơn 1.900 mô hình khác nhau trên Azure, bao gồm những mô hình được tạo bởi Meta và OpenAI, và các startup như Cohere, Mistral, Stability AI và giờ đây là DeepSeek. (Một số, chẳng hạn như Gemini của Google, không có sẵn cho Microsoft vì lý do cạnh tranh.) Cho dù việc sử dụng mô hình có tốn 10 đô la cho khách hàng thông qua OpenAI hay 90 xu thông qua DeepSeek, Microsoft đều được trả tiền cho điện toán đám mây, bảo vệ an ninh mạng, lưu trữ dữ liệu và các dịch vụ bán kèm khác.

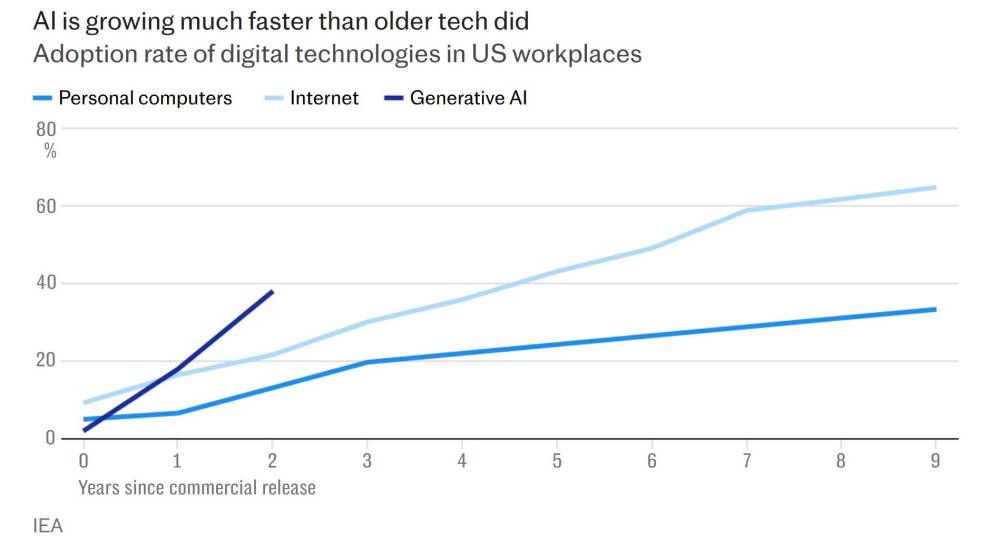

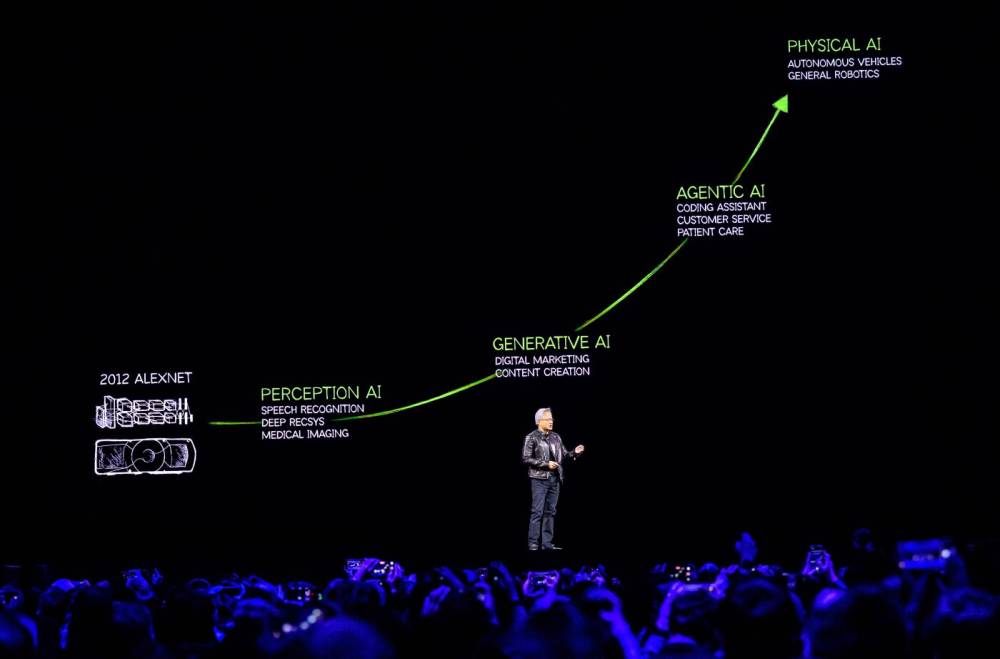

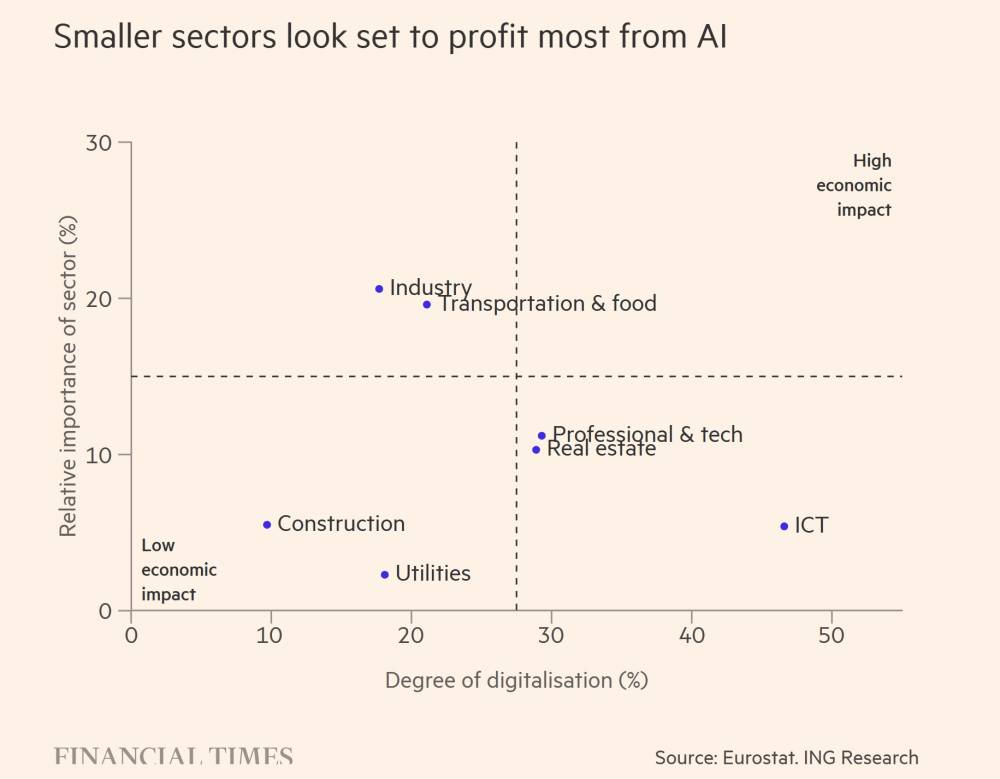

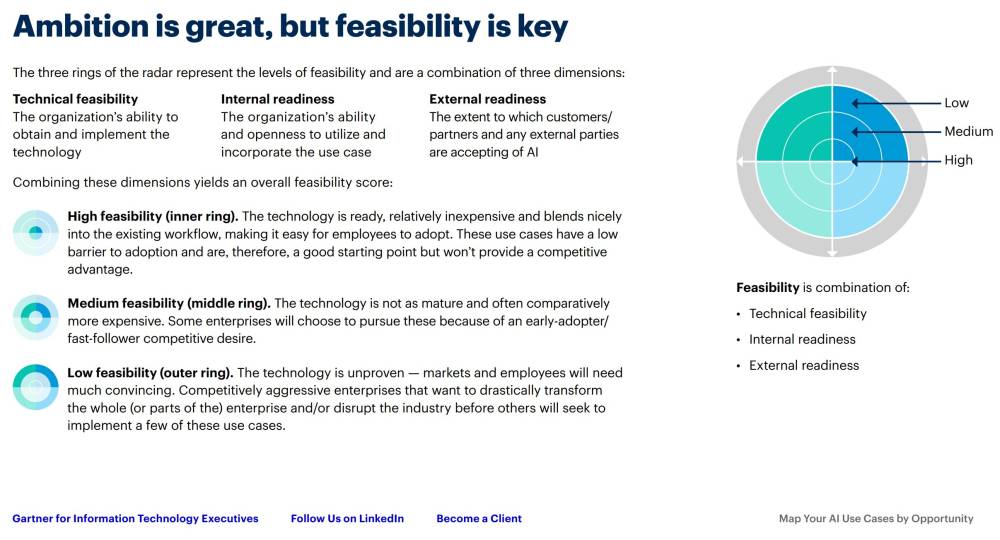

Vụ việc DeepSeek làm nổi bật một phần khác, có thể nói là quan trọng hơn trong suy nghĩ của Nadella: AI đang nhanh chóng trở thành hàng hóa, và đây là điều tốt cho Microsoft. Trong khi mọi người ở Davos tập trung vào tiêu thụ AI, Nadella đang suy ngẫm về lịch sử sản xuất than đá. Một trong những lý thuyết kinh tế yêu thích của ông là nghịch lý Jevons, cho rằng khi một nguồn tài nguyên trở nên dễ tiếp cận hơn và việc sử dụng nó hiệu quả hơn, mức tiêu thụ sẽ tăng lên. Điều này đã xảy ra với than đá trong thế kỷ 18 và 19 và gần đây hơn với du lịch bằng máy bay, khi chi phí vận hành và giá vé giảm mạnh đã tạo ra những hành khách thường xuyên, điểm đến bay mới và doanh số bán hàng bùng nổ cho các hãng hàng không. Nadella tin rằng một hiện tượng tương tự sẽ diễn ra với AI.

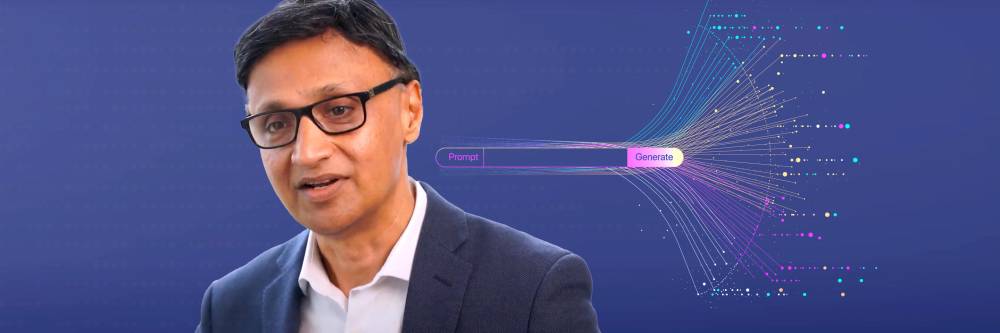

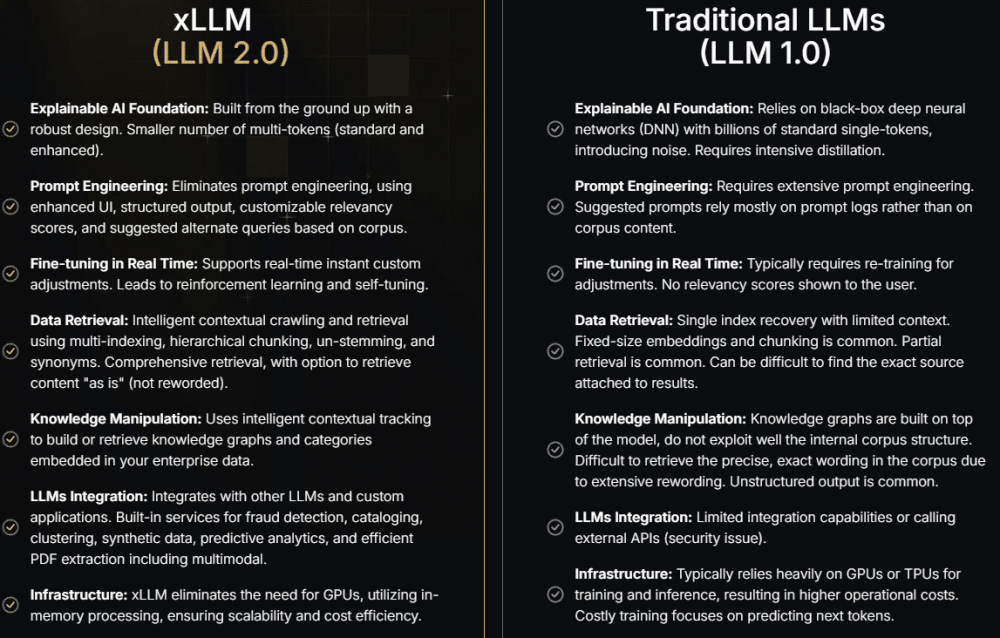

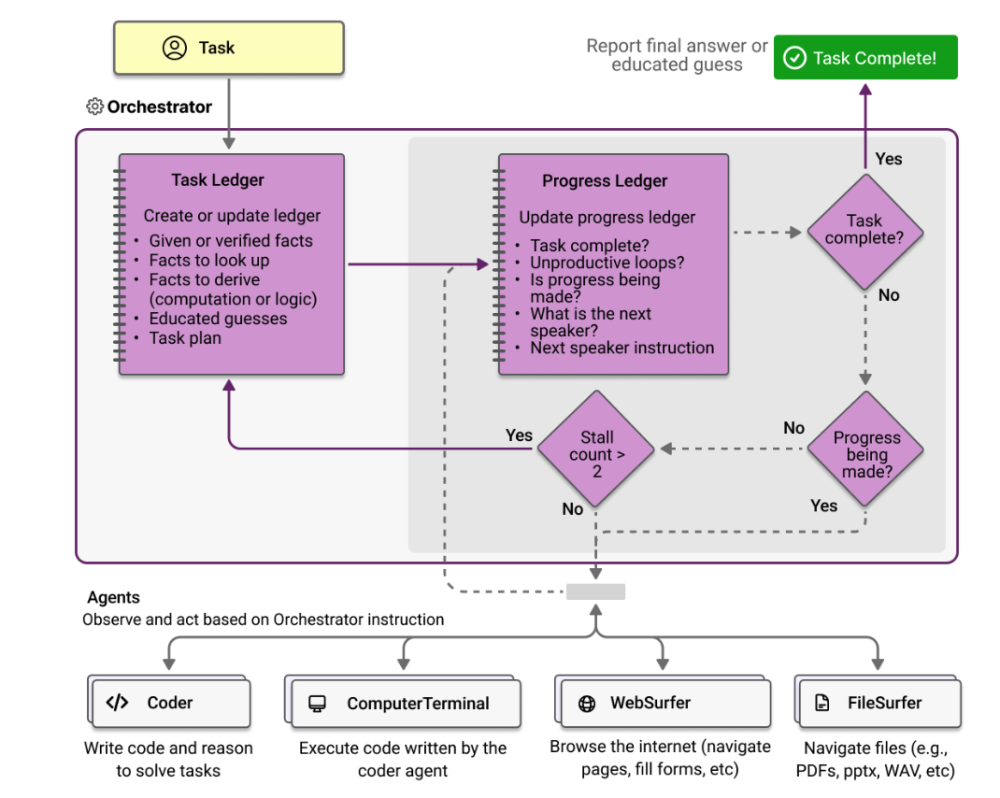

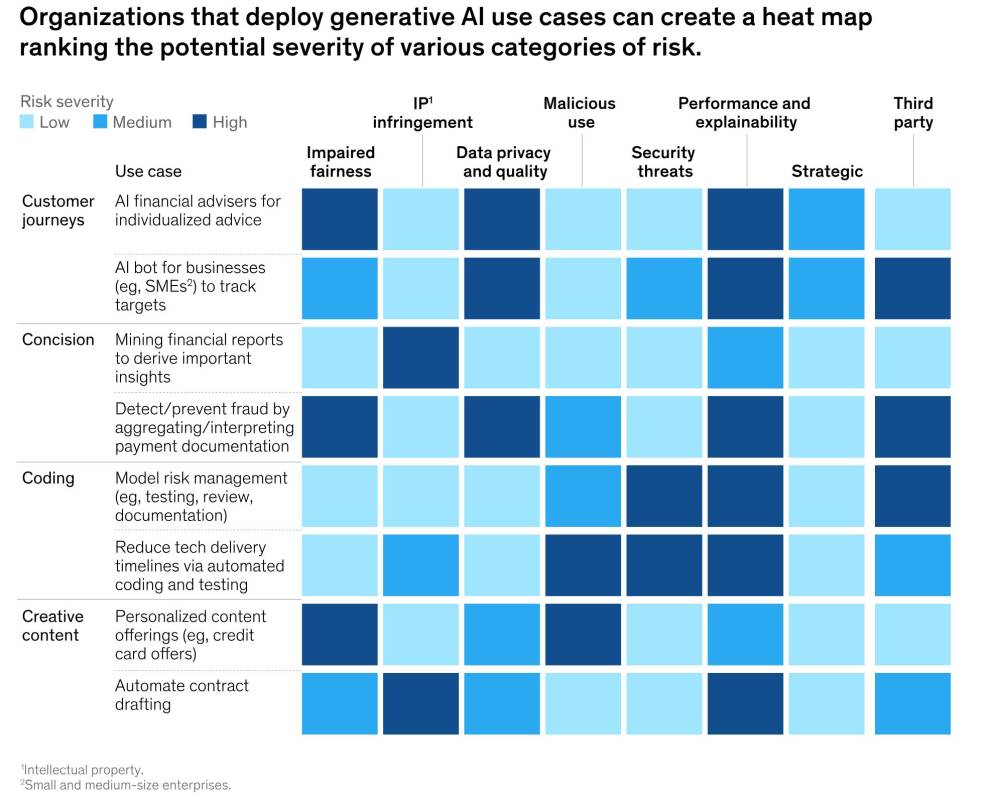

Tư duy kinh tế này đã thúc đẩy công ty hướng tới việc tạo ra kiến trúc AI riêng, bao gồm một số mô hình nhỏ với khả năng tương tự như DeepSeek-R1. Trong năm qua, công ty cũng đang đào tạo một loạt mô hình ngôn ngữ lớn có tên MAI-2, phiên bản mới nhất của các giải pháp thay thế nội bộ của Microsoft cho các mô hình OpenAI, mà công ty đã phát triển bí mật. Mục tiêu là xây dựng AI yêu cầu ít sức mạnh điện toán hơn ChatGPT và giảm chi phí vận hành dịch vụ tương đương của Microsoft, Copilot. Công ty vẫn sẽ thường xuyên sử dụng công nghệ tiên tiến nhất của OpenAI, nhưng Nadella tin rằng Microsoft có thể cung cấp chất lượng gần bằng ChatGPT với mức giá thấp hơn nhiều.

Tất cả những điều này có ý nghĩa gì đối với thỏa thuận của Microsoft với OpenAI thì khá phức tạp. Sau sáu năm, mối quan hệ nuôi dưỡng ban đầu đã trở thành sự cạnh tranh gay gắt giữa anh em. Cuộc tranh giành quyền lực trong OpenAI vào năm 2023 là bước ngoặt trong mối quan hệ giữa các công ty, và theo nhiều cách Microsoft đang khẳng định sự thống trị của mình. Dự án MAI-2, ví dụ, cung cấp sự bảo vệ cho Microsoft, để tránh bị "phơi nhiễm" trong trường hợp điều gì đó "thảm khốc" xảy ra với OpenAI, theo Mustafa Suleyman, người đứng đầu nỗ lực Copilot tiêu dùng của Microsoft. "Mối quan hệ với OpenAI cho đến nay khá tuyệt vời," ông nói. "Nhưng đây là một công ty 50 tuổi cần phải ở vị trí tuyệt vời vào năm 2030, 2035 và 2040."

CEO OpenAI Sam Altman đã nhiều lần cho thấy sứ mệnh của công ty ông là tạo ra trí tuệ nhân tạo tổng quát, biên giới cuối cùng cho kỷ nguyên AI hiện tại. Với MAI-2, Nadella thay vào đó đang theo đuổi hiệu quả chi phí tối đa, mặc dù nó sẽ không thông minh bằng các mô hình tiên tiến nhất của OpenAI. Ông đã cảm thấy một cảm giác sở hữu đối với tài sản trí tuệ của OpenAI. "MAI không phải là bản sao," ông nói. "Khi tôi có hợp đồng [với OpenAI] nói rằng, 'Ồ, tôi về cơ bản tài trợ cho nó và có quyền sở hữu trí tuệ,' sẽ thật ngớ ngẩn khi làm điều đó hai lần. Vì vậy chúng tôi tránh sự ngớ ngẩn đó."

Nếu Nadella nghe có vẻ phòng thủ, đó là vì ông đang đối mặt với một phiên bản tập trung của thử thách mà hầu như mọi CEO đang trải qua hiện nay. Ngay cả với nguồn lực đáng kể của Microsoft, Nadella phải quyết định cách AI sẽ định hình lại doanh nghiệp của mình bằng cách đưa ra một loạt đánh đổi cực kỳ khó khăn—giữa việc áp dụng công nghệ mới lạ và bảo vệ nhân viên và đối tác kinh doanh khỏi các hệ thống gây rối, và giữa việc đi theo những gì đã hiệu quả trong quá khứ và nhảy mù quáng vào tương lai. Cho đến thời điểm này, các cổ đông đã ca ngợi hiệu suất của Nadella, biến Microsoft thành công ty có giá trị nhất trên Trái đất. Tuy nhiên, nếu ông thất bại, công việc của ông có thể là một trong những công việc đầu tiên bị đe dọa bởi AI.

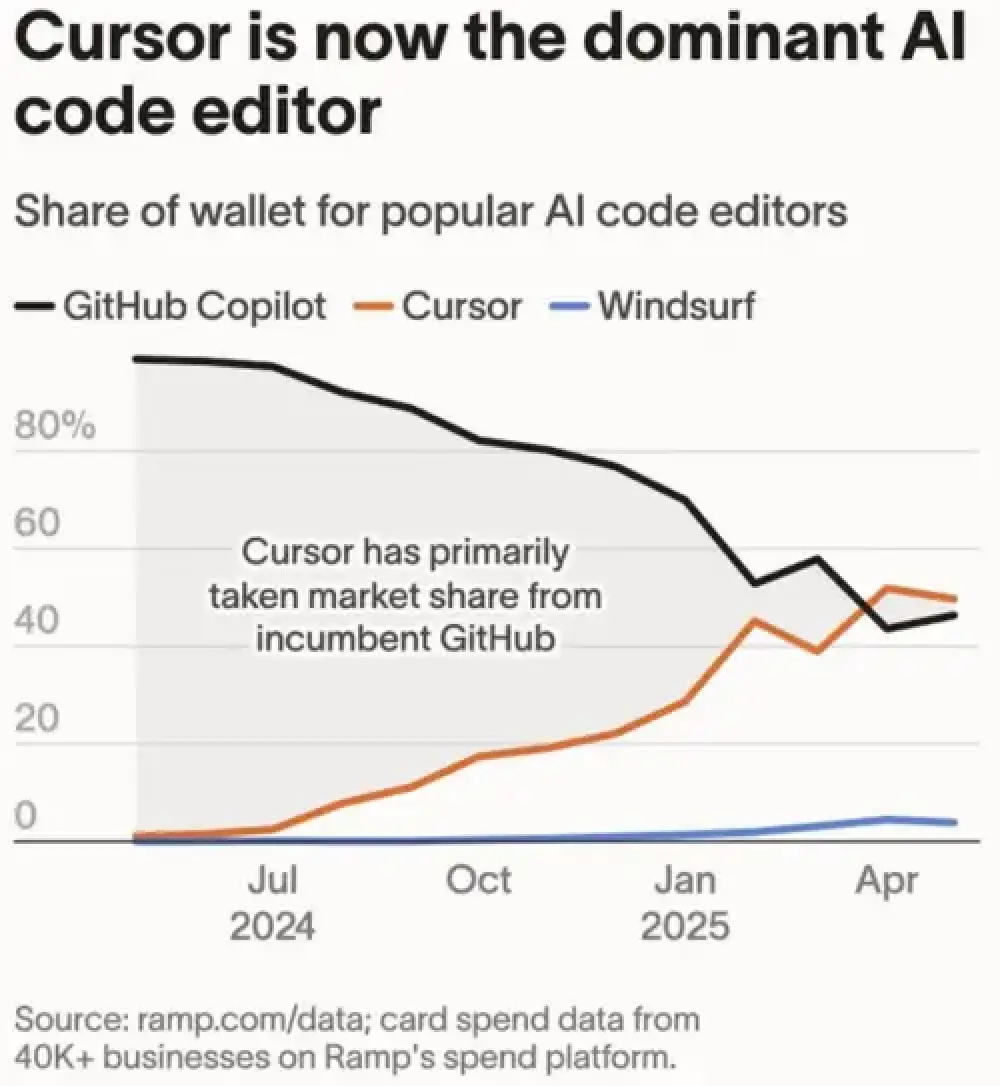

Liên minh giữa Microsoft và OpenAI—và giữa Nadella và Altman—là nền tảng của làn sóng AI hiện tại. Để thực hiện tham vọng của họ, các kỹ sư thông minh của Altman cần tiền và trung tâm dữ liệu của Nadella. Khoản đầu tư 1 tỷ đô la của Nadella vào OpenAI vào giữa năm 2019 là một sự tiên đoán, mang lại cho Microsoft quyền truy cập sớm và độc quyền vào công nghệ của phòng thí nghiệm nghiên cứu. Hai năm sau, Microsoft ra mắt GitHub Copilot, một trợ lý lập trình nhanh chóng trở thành công cụ thiết yếu cho các lập trình viên.

Vào năm 2022, OpenAI tổ chức các cuộc trình diễn cho các lãnh đạo cấp cao của Microsoft về một mô hình đột phá mới. Trong vài tháng tiếp theo, các nhóm trong Microsoft thử nghiệm với các cách khác nhau mà họ có thể điều chỉnh công nghệ của OpenAI theo nhu cầu hàng ngày của người làm văn phòng hiện đại. Một nguyên mẫu đầy hứa hẹn có tên "tóm tắt thông minh" sẽ tóm tắt các cuộc gọi hội nghị trong Teams. Tuy nhiên, trước khi Microsoft có thể phát hành bất kỳ thứ gì, OpenAI đã xây dựng một giao diện trò chuyện đơn giản nhưng đầy lừa dối xung quanh công cụ ngôn ngữ của mình, và mọi người phát cuồng lên. Sau khi phát hành ChatGPT vào tháng 11 năm 2022, Microsoft thấy mình trong một vị thế tương tự như mọi công ty công nghệ khác: phải đuổi theo. Đặc biệt đau đớn đối với Microsoft—gần như thể công ty đã nắm giữ các thành phần cho iPhone gốc và không biết phải làm gì với chúng.

Nadella quyết đoán hơn trong việc chỉ đạo các dự án AI và đặt ra thời hạn quyết liệt. Trong khoảng một tháng sau khi ChatGPT ra mắt, một nhóm phần mềm tổ chức trình diễn cho Nadella cho thấy một số chức năng được hỗ trợ bởi OpenAI được tích hợp vào các chương trình Office. Ý tưởng là người dùng chọn một tùy chọn trong Outlook để AI soạn thảo email trả lời hoặc nhấn nút trong Word để chuyển đổi một dàn ý thành bản nháp. "Satya nói, 'Nhìn này, tôi cảm thấy chúng ta đang bỏ lỡ điều gì đó,'" Jared Spataro, người giám sát tiếp thị cho các ứng dụng nơi làm việc của Microsoft, nhớ lại. "'Điều này cảm giác chỉ như một tập hợp các tính năng.'"

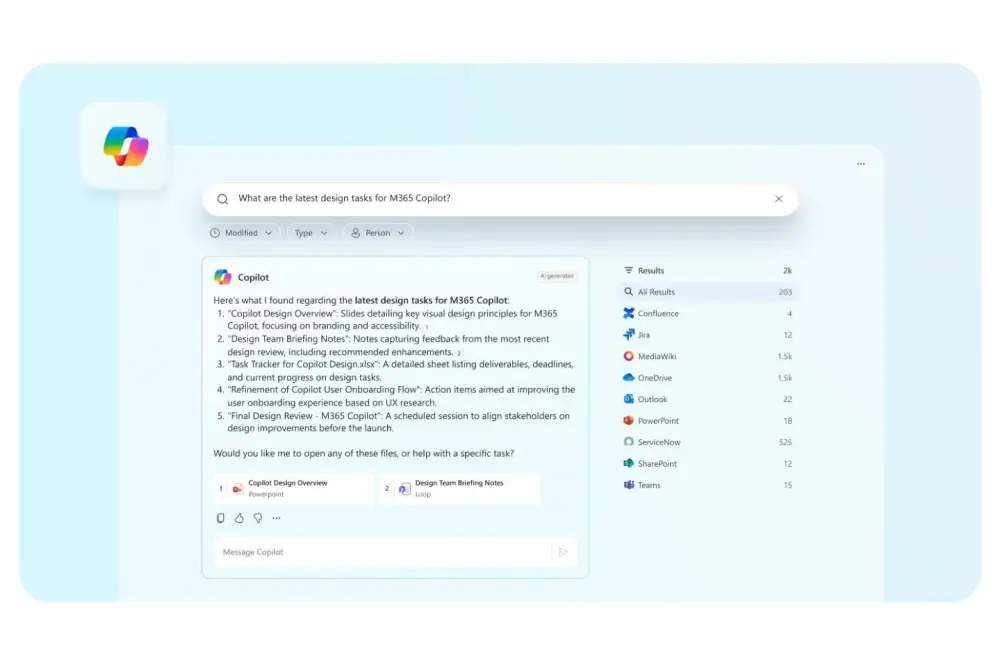

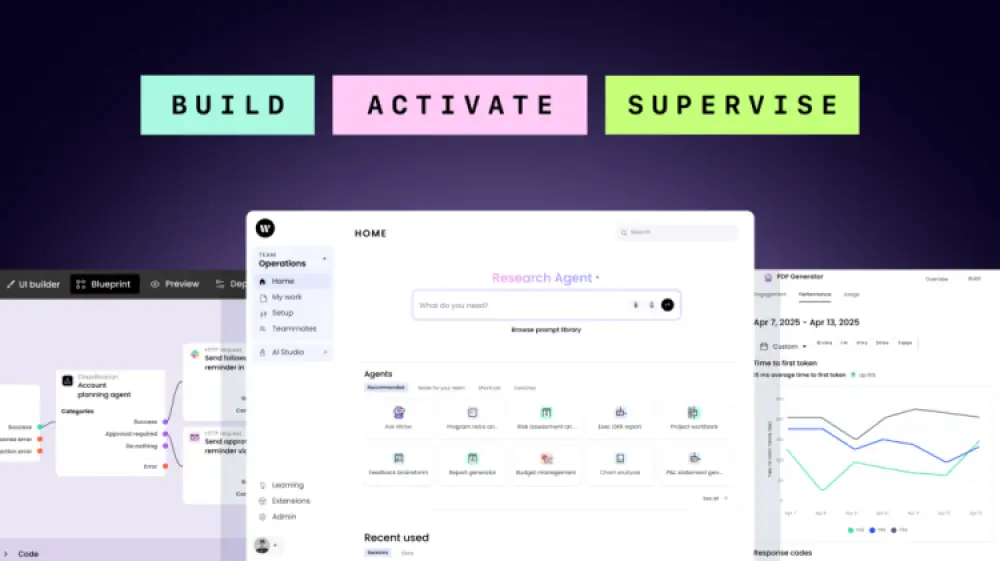

Thay vì chôn vùi các công cụ mới này trong các menu khác nhau, Nadella thúc đẩy các nhóm gộp tất cả các cải tiến OpenAI thành một trợ lý duy nhất—sau này được gọi là Copilot—gắn vào bên cạnh các ứng dụng của Microsoft. Một số người sau đó phàn nàn rằng tầm nhìn không hoàn toàn rõ ràng. Một phần do thiếu phối hợp giữa các nhóm và sự miễn cưỡng can thiệp quá nhiều vào "đồ trang sức quý giá" (Windows, Word, Excel) theo lời một cựu quản lý sản phẩm Copilot, các trợ lý AI kết quả không nhất quán. Copilot PowerPoint hoạt động khác nhiều so với GitHub hoặc Teams Copilot. "Cảm giác như có 13 Copilot khác nhau," một cựu lãnh đạo thiết kế Microsoft nói, người giống như một số cựu nhân viên khác được Businessweek phỏng vấn, yêu cầu không được tiết lộ danh tính để tránh hậu quả nghề nghiệp.

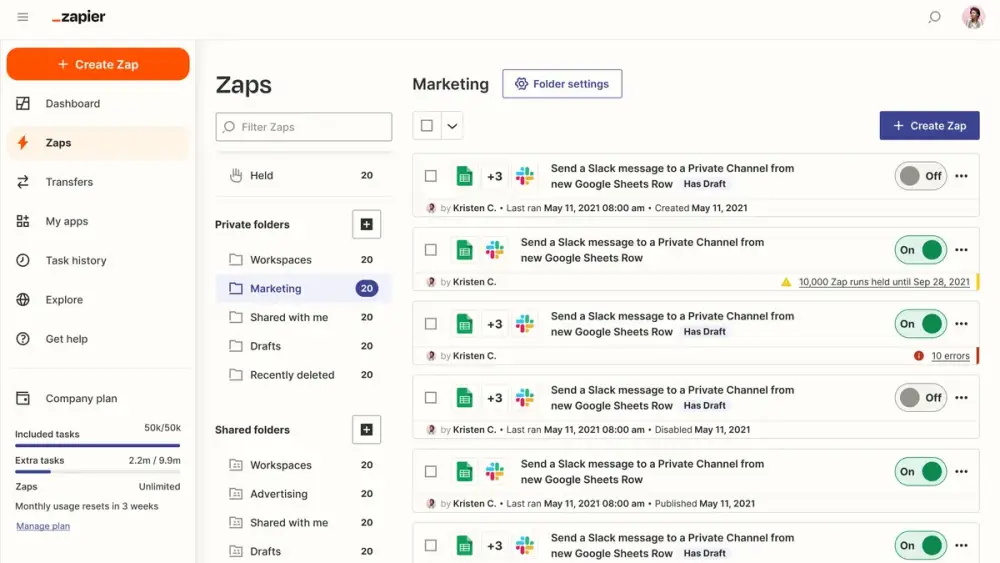

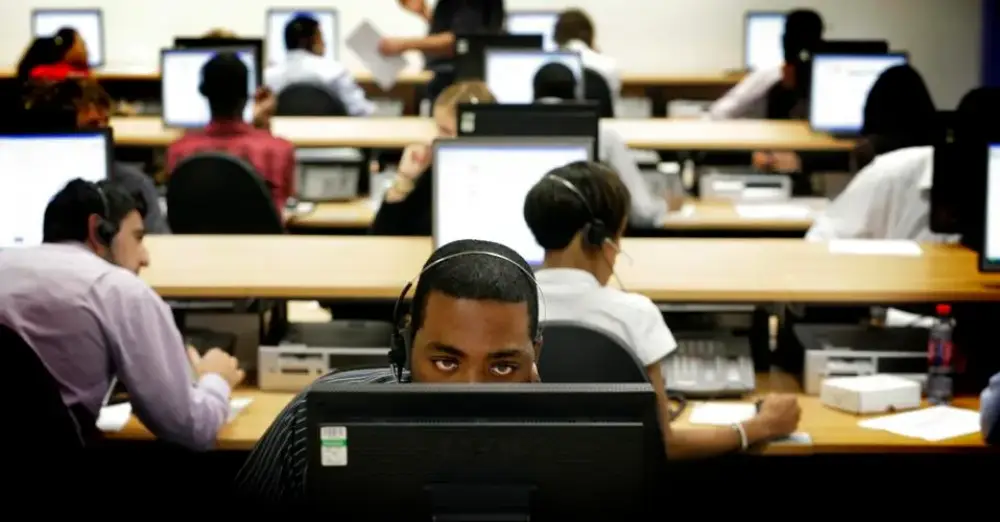

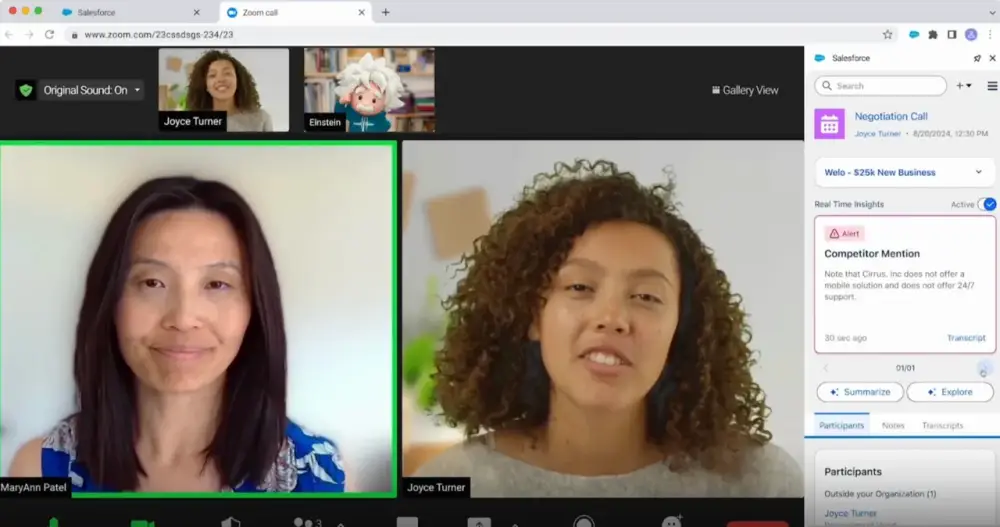

Vào tháng 3 năm 2023, công ty giới thiệu Copilot dành cho doanh nghiệp cho các chương trình Office, là một phần trong gói đăng ký Microsoft 365. Vào thời điểm đó, ChatGPT đã có hơn 100 triệu người dùng hoạt động và đang bán gói đăng ký 20 đô la một tháng cho AI tiên tiến nhất. Để có quyền truy cập sớm vào Copilot, các doanh nghiệp được yêu cầu mua tối thiểu 300 giấy phép với giá 30 đô la mỗi tháng mỗi giấy phép, bổ sung vào các gói Microsoft 365 hiện tại. Nhiều khách hàng đã thử Copilot này thấy nó là một sản phẩm kém hơn, và một kiểu mẫu đáng báo động xuất hiện: Người dùng thường thích vào ChatGPT để đặt câu hỏi và dán câu trả lời vào Word. (Một ngoại lệ đáng chú ý: Mọi người thích tính năng tóm tắt thông minh trong Teams khi nó xuất hiện vào tháng 5 năm 2023. ChatGPT chưa có kỹ năng đó.)

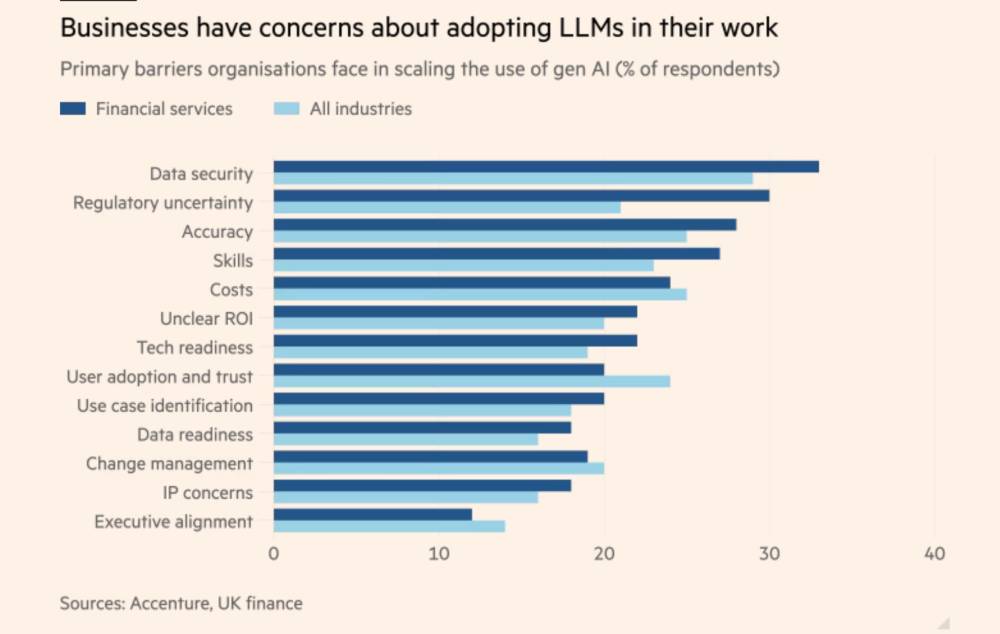

Một phần lý do Microsoft chậm lại là do quá chú trọng vào bảo mật phần mềm. Việc tuân thủ, bảo vệ dữ liệu và đánh giá pháp lý khiến công nghệ của họ tụt hậu nhưng cuối cùng đã trở thành điểm bán hàng xuất sắc cho các công ty. "Thật tuyệt vời khi chúng tôi đến với khách hàng và nói, 'Này, bạn thích ChatGPT? Đây là điều đó, nhưng tốt hơn: trải nghiệm người dùng mạnh mẽ hơn, bảo mật tốt hơn,'" Jeff Teper, người điều hành Teams, nói.

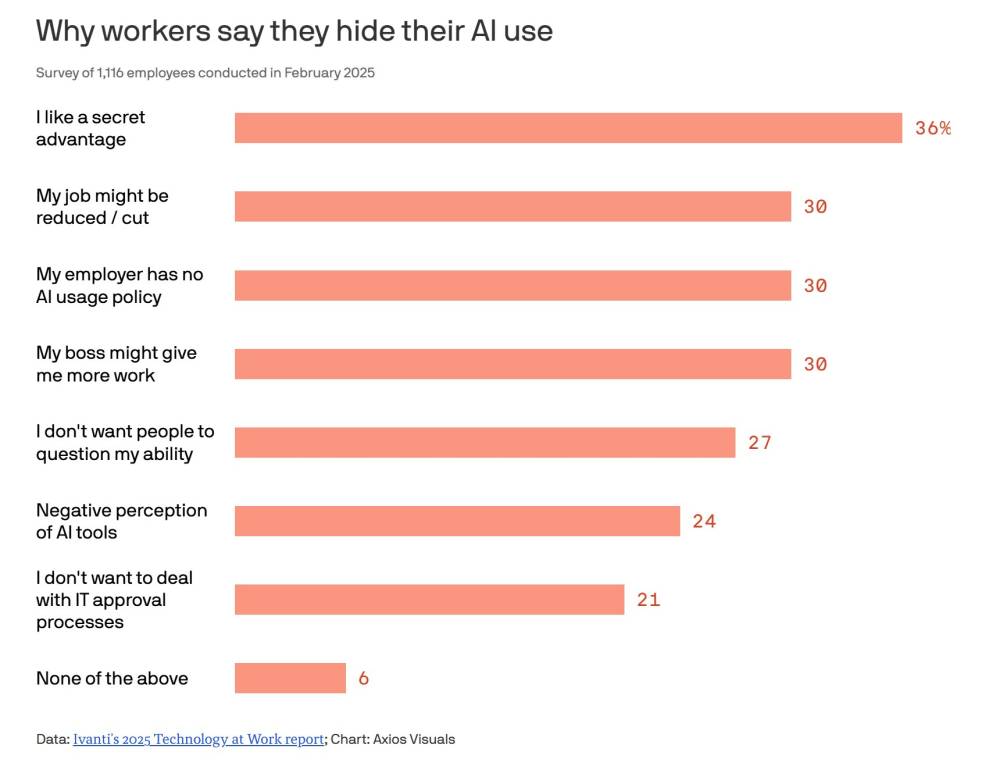

Tuy nhiên, rõ ràng có điều gì đó khác đang ngăn công ty không đưa ra rủi ro lớn hơn với sản phẩm của mình. Cựu quản lý Copilot mô tả nó như một loại rối loạn căng thẳng sau chấn thương từ những sự cố đáng xấu hổ kéo dài đến chatbot tiền thân Clippy, chiếc kẹp giấy hoạt hình đã trở thành trò đùa dai dẳng. ChatGPT có thể thực hiện nhiều hành động hơn với ít giới hạn quan liêu hơn, và các kỹ sư Microsoft biết điều đó, người này nói. Ông ước tính rằng, trong số hàng trăm người trong tổ chức của ông, ba phần tư đã tự bỏ tiền túi để sử dụng ChatGPT, vì Microsoft không cho phép họ được thanh toán chi phí. (Teper nói rằng việc nhân viên kiểm tra dịch vụ của các công ty khác để hiểu rõ hơn về thị trường là điều phổ biến.)

Khách hàng của Microsoft cũng đang chuyển sang ChatGPT. Moderna Inc. nhận thấy các tùy chọn tùy chỉnh ChatGPT của OpenAI làm cho nó linh hoạt hơn nhiều so với Copilot, Brad Miller, cựu giám đốc thông tin của công ty công nghệ sinh học, nói. "Microsoft giống như, 'Nó được nhúng trong Office, chỉ cần sử dụng nó trong Office.' Và chúng tôi giống như, 'Có quá nhiều thứ hơn mà chúng tôi muốn làm,'" ông nói.

Mùa thu đó, khi Microsoft đang chuẩn bị Copilot cho một phát hành chung, hơn 18.000 doanh nghiệp đang truy cập các mô hình OpenAI thông qua Azure, trong khi người đăng ký doanh nghiệp của Copilot được tính bằng hàng trăm. Microsoft vẫn kiếm được rất nhiều tiền từ việc cho thuê quyền truy cập vào các mô hình OpenAI và thỏa thuận chia sẻ doanh thu trên các đăng ký ChatGPT nhưng nói chung không nhiều như khi khách hàng trả tiền cho Copilot.

Nadella cố gắng tạo đà cho các dịch vụ AI của Microsoft tại hội nghị nhà phát triển thường niên của công ty vào tháng 11 năm 2023, giới thiệu một công cụ để tạo Copilot tùy chỉnh tương tự như những gì các doanh nghiệp đang làm với ChatGPT. Nỗ lực này bị lu mờ bởi tin tức vào ngày cuối cùng của sự kiện rằng hội đồng quản trị OpenAI đã loại bỏ Altman khỏi vị trí CEO. Nadella, mặc dù đã tăng cam kết tài chính với OpenAI thêm 10 tỷ đô la vào đầu năm đó, chỉ biết về việc Altman bị sa thải sau khi sự việc đã xảy ra.

Ban quản lý Microsoft hiện đề cập đến giai đoạn bốn ngày nổi tiếng—khi Altman mất việc, chấp nhận vai trò điều hành tại Microsoft và sau đó giành lại quyền kiểm soát OpenAI từ hội đồng quản trị của mình—bằng một loạt các cách nói: "sự cố cụ thể đó" hoặc "tình huống kiểu OpenAI vào tháng 11." Trong thực tế, sự cố cụ thể đó đã làm tổn hại không thể sửa chữa mối quan hệ đối tác giữa các công ty. Ngay trước đó, Nadella đã cân nhắc một khoản tiền mặt khổng lồ khác—hàng chục tỷ đô la—để giữ cho OpenAI tiến nhanh hơn Amazon.com và Google, theo một người có hiểu biết trực tiếp về các cuộc thảo luận. Không còn nữa. Nadella nghĩ rằng Microsoft đã mạo hiểm đủ với công ty khởi nghiệp được điều hành một cách thiếu trưởng thành.

Nadella đã gắn kết với Suleyman, một nhân vật có ảnh hưởng trong thế giới AI, người đồng sáng lập phòng thí nghiệm sau này trở thành Google DeepMind và vào thời điểm đó đang giám sát một công ty khởi nghiệp có tên Inflection AI Inc. Inflection có một chatbot hướng nhiều đến EQ hơn là IQ, định vị sản phẩm như một loại bạn bè có kiến thức cực kỳ rộng. Chatbot của Inflection không bao giờ đạt được sự nổi tiếng nào gần với ChatGPT, nhưng Nadella yêu thích các phản hồi rõ ràng, vui nhộn của nó. Đến lượt Nadella làm ngạc nhiên OpenAI: Vào tháng 3 năm 2024, Microsoft đã chi 650 triệu đô la để cấp phép phần mềm của Inflection và thuê hầu hết nhóm của họ. Microsoft thông báo cho OpenAI một ngày trước khi thỏa thuận được công bố.

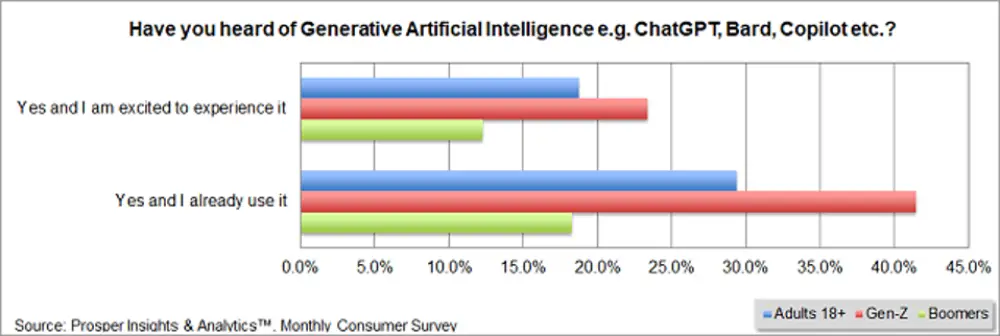

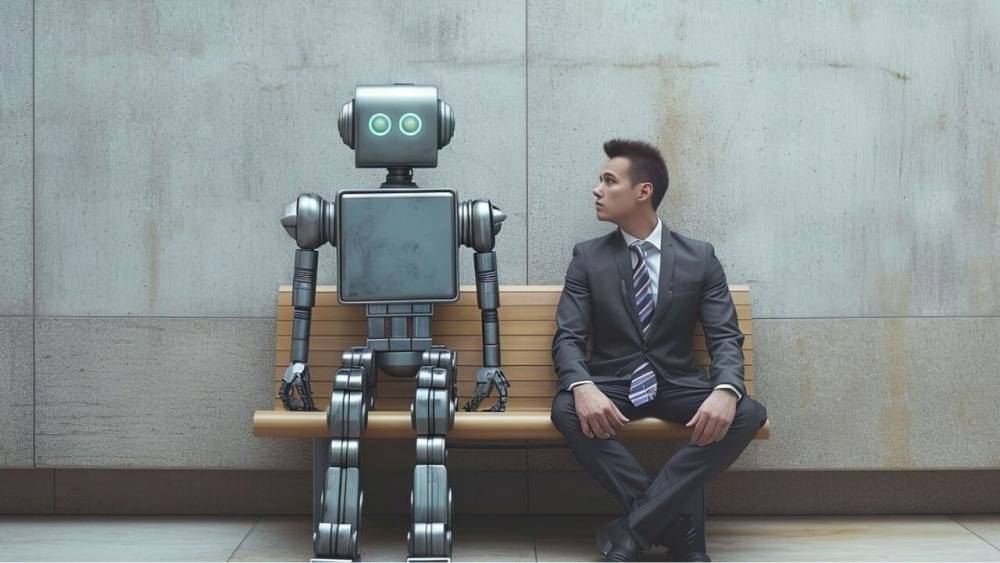

Nadella đặt Suleyman, một người Anh 40 tuổi, phụ trách AI tiêu dùng của Microsoft, danh mục bao gồm Bing, ứng dụng Copilot, trình duyệt web Edge và cổng thông tin web MSN. Danh sách này đang trong tình trạng yếu, đặc biệt là trong giới trẻ, những người không hẳn là nhân khẩu học cốt lõi của MSN.com. Thế hệ Z đang lớn lên với iPhone và MacBook, Gmail và Google Docs, Instagram và TikTok và bây giờ là ChatGPT. "Cách Satya nói với tôi là chúng ta đang trải qua sự thay đổi thế hệ này, nơi những người trẻ ngày nay, những người sẽ trở thành CEO và lãnh đạo ngành trong một thập kỷ tới và đưa ra quyết định mua sắm trong doanh nghiệp, sẽ không thực sự trải nghiệm Microsoft," Suleyman nói. "Đó là một thách thức cấu trúc lớn."

Làm việc từ văn phòng ở London và Mountain View, California, nhân viên của Suleyman bắt đầu tạo ra một phiên bản Copilot được thiết kế cho cuộc sống ngoài văn phòng. Như họ đã làm tại Inflection, họ dạy Copilot này sự đồng cảm, hài hước và tử tế. Mọi người có muốn kết nối cảm xúc với công ty làm ra Excel không? Suleyman nghĩ vậy. Hoặc ít nhất ông tin rằng sẽ khó chuyển sang đối thủ cạnh tranh hơn nếu người dùng xem Copilot như một người bạn hoặc nhà trị liệu.

Nhưng Suleyman đã vật lộn với một thách thức lớn hơn. Công việc của ông về cơ bản là sửa đổi công nghệ OpenAI, và ông nói Microsoft không nhận được quyền truy cập vào các mô hình mới của công ty khởi nghiệp sớm như nó được quyền. OpenAI sẽ triển khai một mô hình cho khách hàng ChatGPT với một làn sóng lớn trước khi ông có đủ thời gian để tích hợp nó vào phần mềm của Microsoft. Suleyman, người có tiếng là nóng tính dù với các giá trị EQ, có thể thiếu tế nhị trong các cuộc gọi hội nghị. Căng thẳng leo thang khi ông thúc đẩy OpenAI chia sẻ nhiều hơn và truy cập sớm hơn vào các mô hình của nó.

Brad Lightcap, giám đốc điều hành của OpenAI, nói rằng việc chuyển giao công nghệ là một "thách thức hoạt động cực kỳ phức tạp" và OpenAI là một trong những khách hàng Azure lớn nhất của Microsoft và dự kiến sẽ vẫn là khách hàng lớn sau khi thỏa thuận hiện tại của họ hết hạn vào năm 2030. Suleyman nói ông không ngạc nhiên khi công ty khởi nghiệp phát triển nhanh đôi khi quên một số nghĩa vụ của họ đối với Microsoft. "Tôi khá đồng cảm với họ," ông nói.

Đồng cảm là một chủ đề lớn đối với Suleyman. Để minh họa những gì ông đang làm trong Copilot, ông gõ vào tác nhân giọng nói trên ứng dụng iPhone của mình và nói rằng ông đang trong một trạng thái khó khăn và đang vật lộn với lo âu. Một giọng nam dịu dàng với âm hưởng tiếng Anh đáp lại, "Những tình huống khó khăn có thể làm mờ đi suy nghĩ rõ ràng," và nhẹ nhàng hỏi liệu ông có thể chia sẻ thêm về những gì đang khuấy động cảm xúc của mình. Copilot được lập trình để cảm nhận ranh giới thoải mái của người dùng và cẩn thận chẩn đoán vấn đề trước khi đề xuất giải pháp, Suleyman nói. "Bạn có nghe thấy khoảng dừng không? Bạn có nghe thấy âm lượng giảm xuống không?" ông hỏi với niềm tự hào. "Điều đó cực kỳ khó làm."

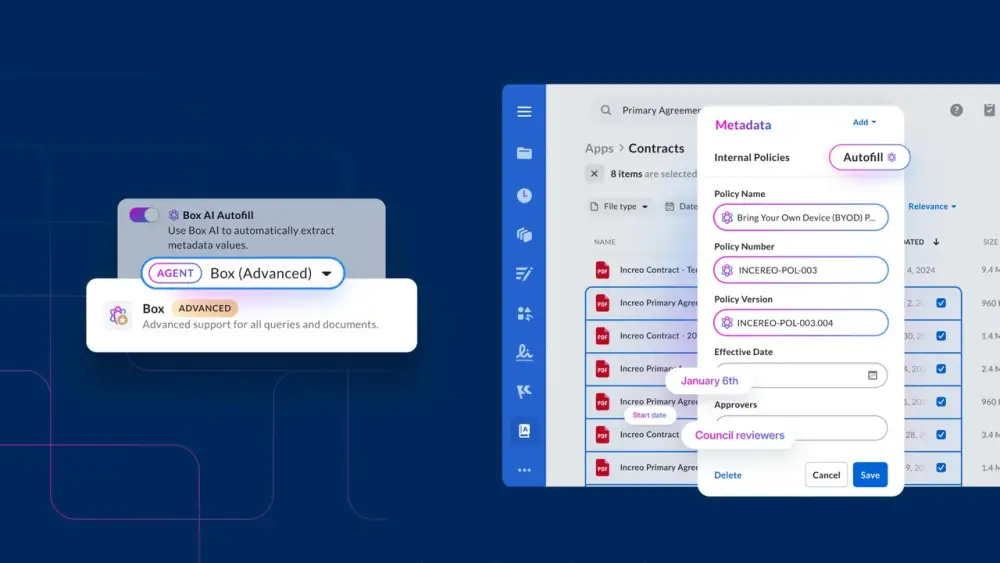

Vào một buổi sáng lạnh giá tháng Hai tại trụ sở của Microsoft ở Redmond, Washington, hơn một chục quản lý từ Estée Lauder Cos. đang nhận được một khóa học cấp tốc về Copilot. Công ty mỹ phẩm đã khám phá những cách mà AI của Microsoft có thể hỗ trợ trong việc tái cấu trúc doanh nghiệp nhằm cải thiện quản lý nguyên liệu, dòng sản phẩm và nguồn cung cấp. Mặc dù Estée Lauder là khách hàng lâu năm của Copilot với 15.000 giấy phép, nhân viên chỉ mới học về một số cách sử dụng nó. Khi một số người trong số họ bày tỏ sự quan tâm đến một công cụ để tự động quản lý những chi tiết nhỏ nhặt xung quanh việc tuyển dụng, một đại diện bán hàng của Microsoft thông báo rằng họ đã có quyền truy cập vào tính năng Copilot đó trong một thời gian.

Đối với Microsoft, những khoảnh khắc này—khi khách hàng nhận ra Copilot có thể làm điều gì đó thực sự hữu ích cho họ—là điều cần thiết. Roberto Canevari, phó chủ tịch điều hành của Estée Lauder giám sát chuỗi cung ứng toàn cầu, nói ông đã trải nghiệm chính điều đó chỉ vài tuần trước. Sau khi dành cả cuối tuần để nghiên cứu và chú thích một báo cáo hoạt động dài 30 trang, ông vô tình hỏi Copilot tóm tắt nó. Bản tóm tắt một trang kết quả gần như tốt như bản ông đã viết. "Nó làm tôi cảm thấy rất già và không thông minh lắm," ông nói đùa.

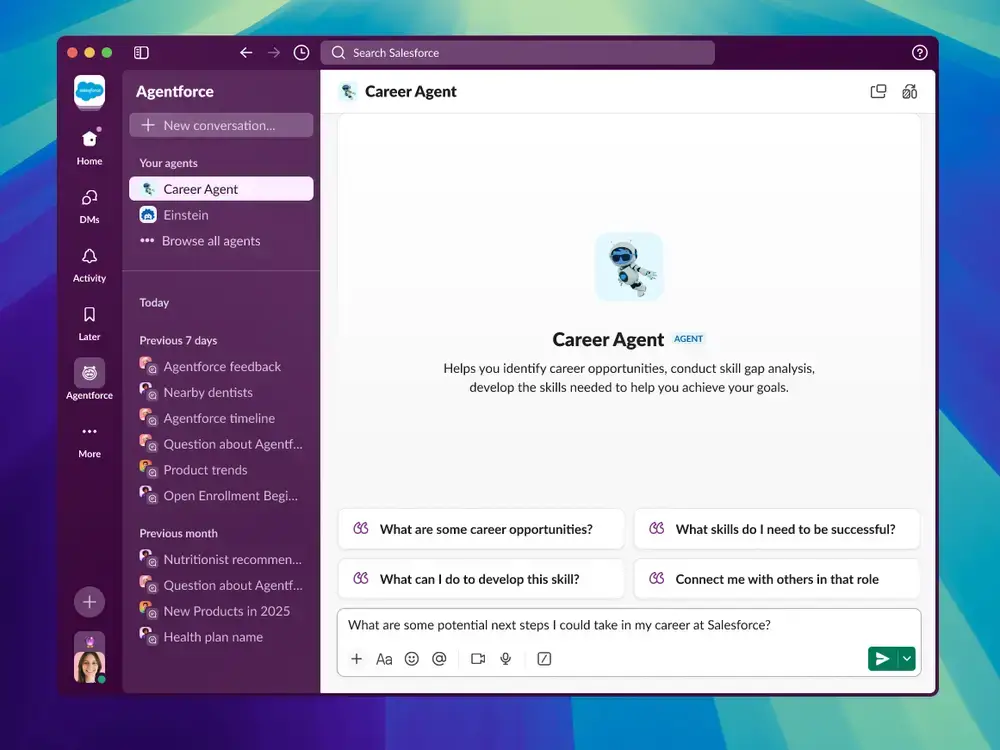

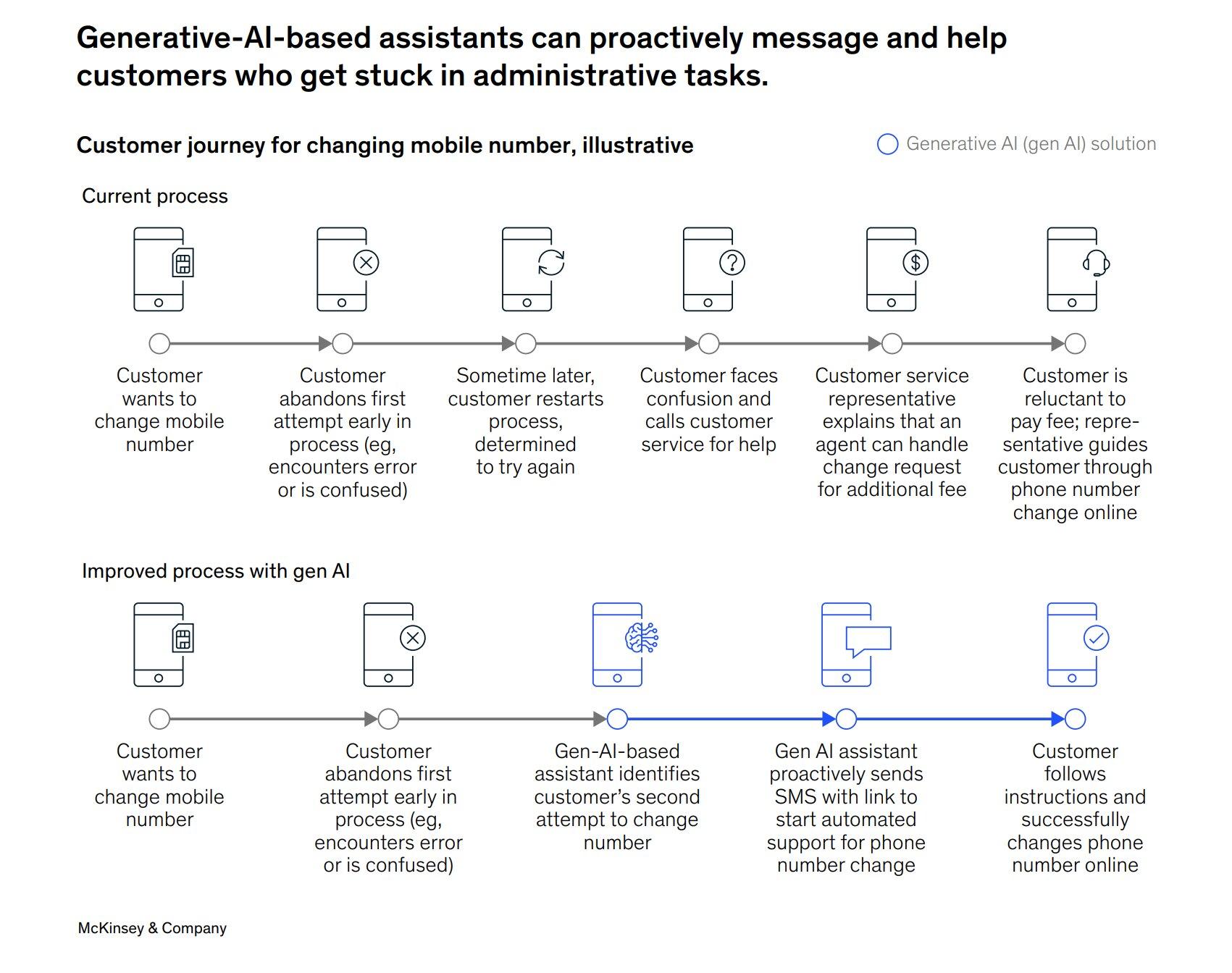

Trong khi Suleyman làm việc trên một Copilot đồng cảm hơn cho người tiêu dùng, các đồng nghiệp của ông trong nhóm doanh nghiệp đã tập trung vào việc tự động hóa quy trình làm việc thông thường và đơn điệu trong năm qua, chẳng hạn như đối chiếu hóa đơn ngân hàng hoặc xem xét hàng tồn kho trong kho. Microsoft phát hiện ra rằng nhân viên văn phòng ấn tượng nhất khi Copilot có thể làm những phần thực sự nhàm chán trong công việc của họ. Thay vì nói về tiềm năng thay đổi thế giới của AI một cách trừu tượng, các đại diện bán hàng của Microsoft giờ đây quảng cáo khả năng của Copilot để thêm một slide về sự khác biệt ngân sách vào PowerPoint.

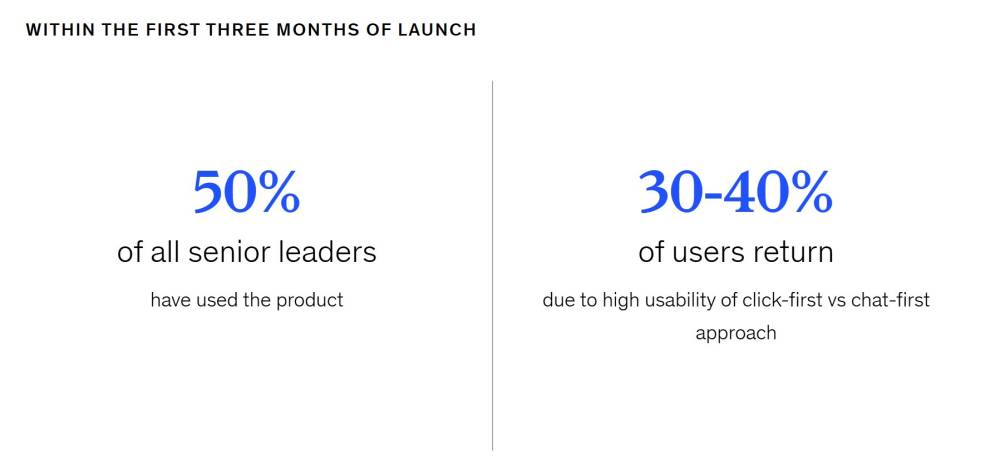

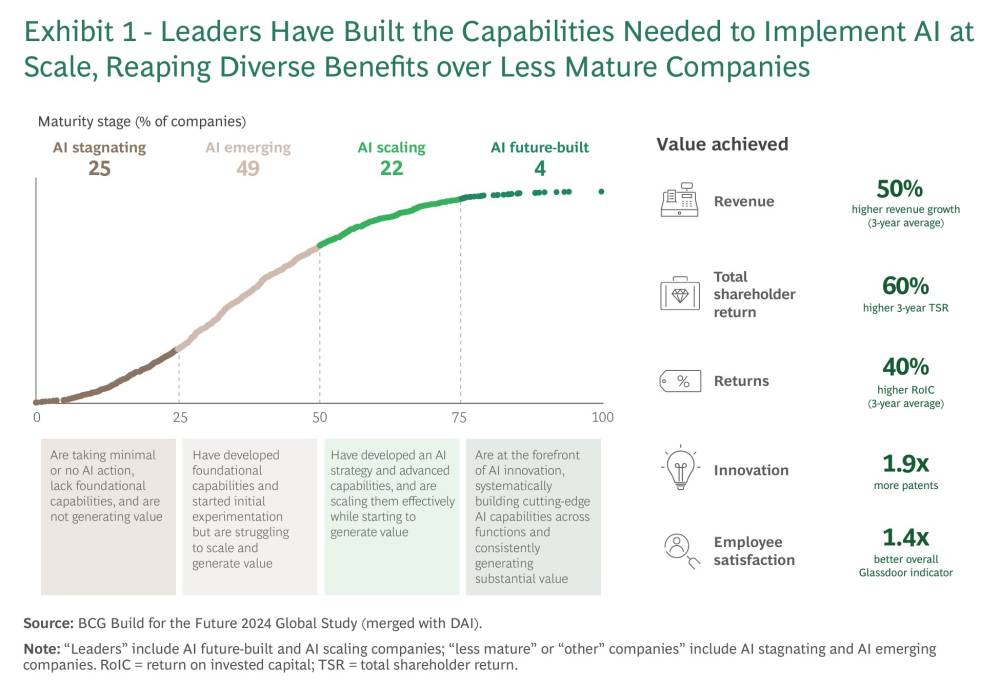

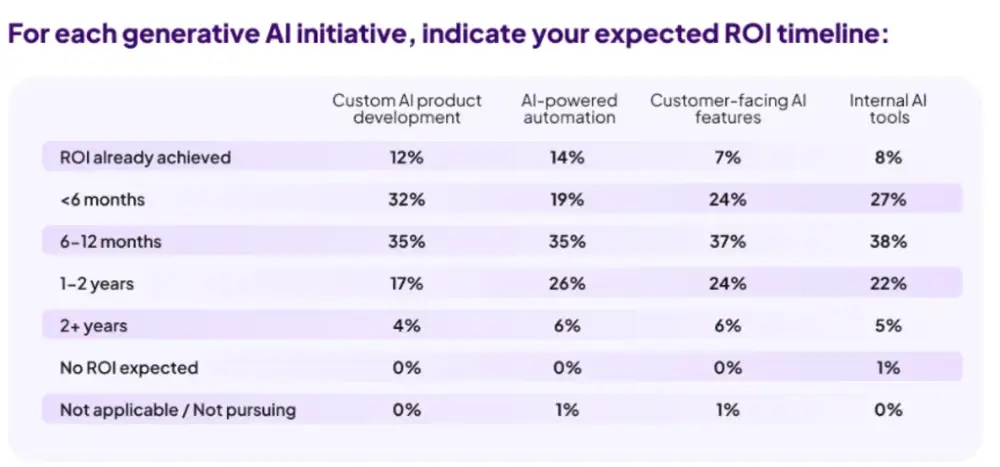

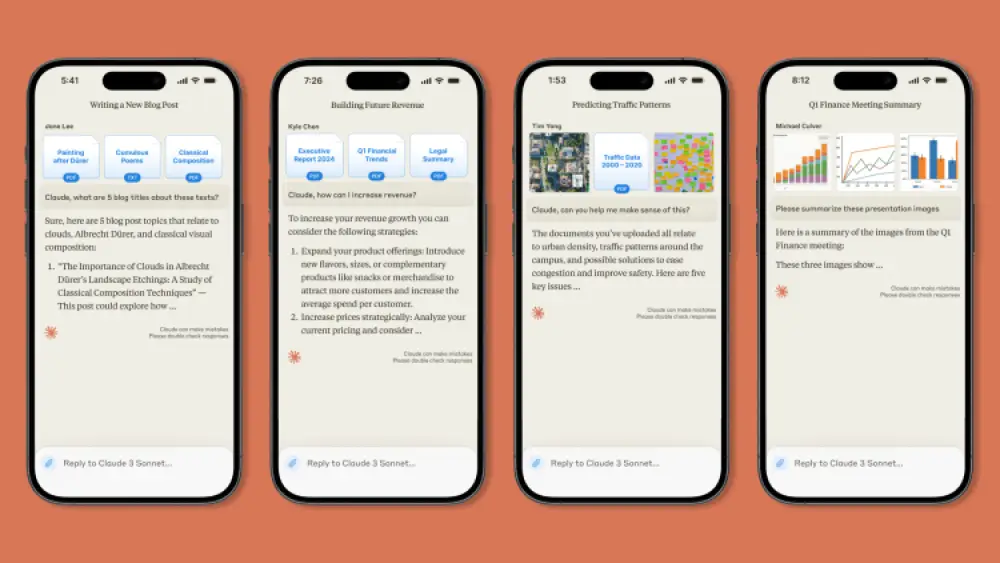

Cách tiếp cận này đang gây tiếng vang. Trong một báo cáo tài chính quý vào tháng 1, Microsoft cho biết công ty đang đi đúng hướng để tạo ra hơn 13 tỷ đô la doanh thu AI mỗi năm. Công ty kiếm tiền từ đăng ký Copilot, phí sử dụng từ các mô hình AI chạy trên Azure và chia sẻ doanh thu với OpenAI trên các gói thành viên ChatGPT. GitHub Copilot đã vượt qua 15 triệu người dùng tính đến tháng 3, và phiên bản doanh nghiệp của Copilot hiện có hàng trăm nghìn doanh nghiệp là khách hàng, với sự tham gia của họ tăng gấp ba lần trong năm qua.

Nestlé SA nhận thấy Copilot cực kỳ hữu ích để so sánh hợp đồng và dịch ngôn ngữ cho các nhóm dịch vụ khách hàng, Christopher Wright, CIO tại tập đoàn thực phẩm Thụy Sĩ cho biết. Nestlé trả tiền cho hơn 25.000 giấy phép Microsoft 365 với Copilot, và Wright ước tính rằng 10 phút tiết kiệm thời gian mỗi ngày sẽ trang trải chi phí đăng ký của mỗi nhân viên. Công ty cũng bắt đầu trả thêm tiền để sử dụng một sản phẩm có tên Copilot Studio để tạo ra các tác nhân AI tùy chỉnh với chuyên môn về chủ đề. Wright mô tả nó là rẻ đến đáng kinh ngạc cho những gì công ty nhận được. "Đừng nói với Microsoft điều đó, làm ơn," ông nói.

Nhiều khả năng AI này vẫn phụ thuộc vào các mô hình từ OpenAI, một thực tế mà Microsoft không mấy hăng hái quảng cáo gần đây. Copilot sẽ tự động đưa ra kết quả bằng cách sử dụng bất kỳ mô hình nào của Microsoft hoặc OpenAI tốt nhất cho một lời nhắc cụ thể, thay vì yêu cầu khách hàng lựa chọn. Trong khi đó, ChatGPT cho phép người dùng lựa chọn từ một danh sách lộn xộn bao gồm 4o, 4.5, o3, o4-mini và o4-mini-high—những ký hiệu có lẽ có ý nghĩa hơn với robot so với con người. Spataro, lãnh đạo tiếp thị của Microsoft, cười nhạo lựa chọn thiết kế này. "Chà, giao diện đang trở nên rất nặng nề," ông nói. (Altman đã nói OpenAI đang làm việc để đơn giản hóa các dịch vụ của mình.)

Judson Althoff, giám đốc bán hàng của Microsoft, nói rằng ít người mua xe quan tâm đến động cơ nào dưới mui xe miễn là xe có thể đưa họ từ điểm A đến B. "Đó có phải là động cơ tăng áp bốn xi-lanh không? Động cơ tám xi-lanh?" ông hỏi. "Họ quan tâm đến tổng chi phí của cả gói." Nếu ChatGPT là một chiếc Range Rover hàng đầu, MAI-2 sẽ giống như một chiếc Prius: Không nhanh hoặc mạnh bằng, nhưng hiệu quả hơn nhiều cho việc đi lại hàng ngày của bạn. Microsoft đã đào tạo các mô hình nhỏ hơn và hiệu quả hơn chuyên về toán học hoặc nhận dạng giọng nói, một phần của danh mục có tên Phi. Những nỗ lực AI này có thể cho phép bạn tóm tắt một tài liệu dài hoặc xử lý lệnh thoại bằng Copilot trên một máy tính xách tay tiêu chuẩn mà không cần kết nối internet.

Chìa khóa để đạt được điều đó, theo Suleyman, có thể được tìm thấy trong một khái niệm toán học được gọi là biên giới Pareto. (Bài viết Wikipedia hữu ích mô tả nó là "tập hợp tất cả các giải pháp hiệu quả Pareto.") Dựa trên lý thuyết hiệu quả được phát triển bởi một nhà kinh tế học người Ý thế kỷ 19, thuật ngữ này đề cập đến điểm ngọt ngào giữa một tập hợp các thuộc tính mong muốn. Nó được nhắc đến trong các cuộc họp bởi các kỹ sư phần mềm tìm kiếm sự cân bằng giữa tốc độ và chất lượng của một mô hình AI so với chi phí vận hành. CEO Google Sundar Pichai đã khoe về những tiến bộ của công ty trong biên giới Pareto trên một cuộc gọi thu nhập gần đây, vì vậy công ty có thể cung cấp nhiều tính năng AI hơn trên điện thoại Android, công cụ tìm kiếm và YouTube mà không làm vỡ ngân hàng. Apple Inc. cũng đã trích dẫn Pareto, trong nghiên cứu của mình về việc xây dựng các mô hình ngôn ngữ có thể chạy trên iPhone.

Nadella đưa ra nhiều lý do để Microsoft tăng cường các đơn vị AI nội bộ sau khi chi hàng tỷ đô la cho OpenAI. Một phần là về "tập luyện trong phòng tập thể dục," ông nói, để tăng cường sức mạnh đào tạo mô hình AI của công ty để không hoàn toàn phụ thuộc vào OpenAI. Ông nói ông sẽ không nhất thiết ưu tiên công nghệ của một phòng thí nghiệm này hơn phòng thí nghiệm khác. Đôi khi ưu tiên sẽ là các mô hình rẻ hơn của Suleyman, đôi khi là các mô hình thành thạo hơn của Altman.

Việc vội vàng áp dụng DeepSeek vào tháng 1 cũng không phải là một lần duy nhất. Microsoft đã thêm một mô hình DeepSeek khác vào danh mục đám mây của mình vào tháng 3, cho thuê nó với giá bằng một nửa so với một mô hình tương đương từ OpenAI. Một ngày nào đó, Copilot có thể chạy các truy vấn nhất định thông qua DeepSeek hoặc một mô hình khác có sẵn trong đám mây của Microsoft—điều mà các nhóm tiêu dùng và doanh nghiệp đã thử nghiệm. Những động thái này không hẳn là về việc phòng hộ cược của Nadella vào OpenAI; nó gần như ông đang ném chip khắp mọi hướng trên bàn roulette.

Tất nhiên, Nadella không phải lúc nào cũng thắng. Vào ngày DeepSeek lần đầu tiên truất ngôi ChatGPT đứng đầu App Store của Apple ở Mỹ vào tháng 1, Copilot không xuất hiện ở bất kỳ đâu trong top 200, theo công ty nghiên cứu Sensor Tower. (Mặc dù các mô hình mã nguồn mở của DeepSeek có sẵn trên Azure, công ty khởi nghiệp này vận hành ứng dụng trò chuyện di động riêng, không mang lại lợi ích nào cho Microsoft.) Những người đến sau khác, như Gemini của Google và Grok của Elon Musk, cũng liên tục đứng trước.

Nadella chỉ ra rằng Microsoft từng kém phù hợp hơn trong hội nghị truyền hình. "Mọi người sẽ nói, 'Này, Zoom, Zoom, Zoom,'" Nadella nói. "Chúng tôi đã thắng trong doanh nghiệp." (Một người phát ngôn của Zoom từ chối bình luận.)

Trong AI, các sản phẩm của công ty bị phân tán, và không theo cách tốt, Ethan Mollick, giáo sư tại Trường Wharton thuộc Đại học Pennsylvania, người nghiên cứu AI tạo sinh và viết cuốn sách Co-Intelligence: Living and Working With AI, nói. Nhưng Microsoft có lợi thế hơn mọi công ty khác. "Lợi thế của họ là họ sở hữu nơi làm việc," ông nói. "Nước Mỹ doanh nghiệp hoạt động dựa trên Microsoft." Các đối thủ cạnh tranh đã cáo buộc Microsoft sử dụng các chiến thuật chống cạnh tranh liên quan đến liên minh với OpenAI. Ủy ban Thương mại Liên bang của Donald Trump đang theo đuổi một cuộc điều tra chống độc quyền rộng rãi đối với công ty được mở bởi chính quyền Biden. Microsoft cho biết họ đang hợp tác với cơ quan này.

Nhiều động lực bên trong Microsoft đều hướng đến việc thúc đẩy Copilot. Vào ngày 19 tháng 5, công ty sẽ tổ chức hội nghị nhà phát triển thường niên lớn nhất, nơi Copilot dự kiến sẽ là ngôi sao của chương trình. Công ty đã tự hào rằng khoảng 70% công ty Fortune 500 sử dụng nó và BlackRock, PricewaterhouseCoopers và nhiều công ty khác đã ký các hợp đồng lớn cho giấy phép AI.

Armin Woworsky, một kỹ sư giám sát các giải pháp AI cho Raiffeisen Bank International AG của Áo, nói rằng đội ngũ bán hàng của Microsoft liên tục tiếp thị với nhân viên của ông để "sử dụng Copilot, sử dụng Copilot, sử dụng Copilot." Woworsky nói rằng nhân viên ngân hàng thích sử dụng Copilot trong Teams để tóm tắt cuộc họp, nhưng nhiều người hơn—hơn 25.000—dựa vào phiên bản doanh nghiệp tùy chỉnh của ChatGPT. RBI đã xây dựng nó bằng cách sử dụng các công cụ đám mây của Microsoft vì lý do tuân thủ. "Có thể họ không cung cấp mọi thứ ngay từ đầu hoặc đôi khi, đối với tôi, họ quá chậm," Woworsky nói. "Nhưng cuối cùng, Microsoft hoàn toàn hiểu cách đưa một số công nghệ nhất định vào môi trường của chúng tôi."

Copilot tiêu thụ cuộc sống của Nadella bên ngoài văn phòng. Ông thích podcast, nhưng thay vì nghe chúng, ông tải bản ghi vào ứng dụng Copilot trên iPhone để có thể trò chuyện với trợ lý giọng nói về nội dung của một tập trên đường đi làm đến Redmond. Tại văn phòng, ông dựa vào Copilot để cung cấp bản tóm tắt các tin nhắn ông nhận được trong Outlook và Teams và chuyển đổi giữa ít nhất 10 tác nhân tùy chỉnh từ Copilot Studio. Ông xem chúng như các tổng tham mưu trưởng AI của mình, ủy thác chuẩn bị cuộc họp, nghiên cứu và các nhiệm vụ khác cho các bot. "Tôi là người gõ email," Nadella nói đùa về công việc của mình, lưu ý rằng Copilot rất giỏi trong việc phân loại tin nhắn của ông.

Nadella, người lớn lên ở Hyderabad, Ấn Độ, con trai của một nhà kinh tế học Mác-xít, mới 7 tuổi khi Bill Gates và Paul Allen bắt đầu Microsoft vào năm 1975. Ông đã dành hơn nửa cuộc đời tại công ty. Trong nhiệm kỳ của Nadella, ông đã chứng kiến sự xuất hiện của World Wide Web, việc tạo ra Internet Explorer, sự sụp đổ của dot-com, vụ kiện chống độc quyền mang tính bước ngoặt của chính phủ Mỹ chống lại Microsoft và những tổn thất thảm khốc sau đó, trước Google trong tìm kiếm và Apple trong điện thoại. AI có thể vượt qua tất cả. Tại một sự kiện vào tháng 4 để kỷ niệm 50 năm thành lập công ty, Gates đã đùa rằng Copilot cuối cùng sẽ tiếp quản vị trí CEO.

Hiện tại, Nadella vẫn đang cố gắng kiếm được tiền công của mình. Ông đã tìm cách tập hợp quân đội bằng cách nói với họ quên đi những thành công trong quá khứ và sẵn sàng từ bỏ những gì đã hiệu quả cho đến nay, Charles Lamanna, một phó chủ tịch giám sát Copilot Studio và một số sản phẩm khác, nói. "Năm năm qua chúng ta dành để xây dựng, không quan trọng. Nó không đáng giá gì nữa," ông nhớ lại Nadella nói với họ. "Đốt cháy các con tàu." (Một con tàu gần đây đã bị đốt cháy: Vào tháng 5, Nadella đã đóng cửa Skype, mà Microsoft từng chi 8,5 tỷ đô la để mua lại, chỉ để sau đó thay thế nó bằng Teams.)

Với AI hứa hẹn (hoặc đe dọa) một sự thay đổi tồn tại như vậy, vẫn còn những câu hỏi quan trọng về ai sẽ thắng và ai sẽ thua từ sự chuyển đổi công nghệ tiếp theo này. Trước công chúng, Nadella thường nghe giống như một nhà kinh tế vĩ mô. Ông so sánh khoảnh khắc này trong AI với cuộc cách mạng công nghiệp, và sự hội tụ của Bắc và Nam toàn cầu, và trích dẫn các nhà lý thuyết kinh tế và lao động từ David Autor đến Friedrich Hayek đến Herbert Simon.

Đặc biệt, nghịch lý Jevons—được mô tả lần đầu tiên trong một cuốn sách năm 1865 về sản xuất than đá của Anh bởi William Stanley Jevons—đã thông báo rất nhiều cho sự hiểu biết của Nadella về vị trí của Microsoft trong cuộc cách mạng AI. Jevons phát hiện ra rằng việc phát minh ra một động cơ hơi nước tiết kiệm nhiên liệu hơn đã khiến than trở thành nguồn nhiên liệu mong muốn hơn, châm ngòi cho sự gia tăng mạnh mẽ trong tiêu thụ than. Đó là lý do tại sao Nadella dường như không bị ảnh hưởng bởi nhận thức DeepSeek làm suy giảm giá trị đầu tư của ông vào OpenAI hoặc việc xây dựng các trung tâm dữ liệu Microsoft. AI hiệu quả hơn cuối cùng sẽ có nghĩa là nhu cầu lớn hơn đối với các dịch vụ AI và cơ sở hạ tầng để cung cấp năng lượng cho chúng, theo quan điểm của ông.

Điều đó không có nghĩa là sẽ không có sự thanh toán cho chi tiêu quá mức vào đào tạo mô hình AI và các đơn vị xử lý đồ họa của Nvidia Corp. (GPU). OpenAI đang làm việc với Oracle Corp. và SoftBank Group Corp. trên một nỗ lực trung tâm dữ liệu khổng lồ có tên Dự án Stargate, hứa hẹn sẽ chi 500 tỷ đô la trong bốn năm tới. Nadella đã chọn không tham gia tài trợ do hàng chục tỷ đô la ông đã đầu tư hàng năm vào cơ sở hạ tầng AI của Microsoft. ("Tôi sẽ không gán cho bất kỳ ai, chắc chắn không phải là CEO của một công ty đại chúng, để nhận ra khi có những giới hạn mà công ty của họ có thể chịu đựng được," Lightcap, COO của OpenAI, nói.) Cùng lúc đó, Microsoft đang cắt giảm một số dự án trung tâm dữ liệu của riêng mình trên toàn thế giới. Những động thái này là sự thừa nhận rằng việc tiếp tục đổ tiền vào "thứ chủ yếu là tài sản bất động sản" là vô nghĩa, Lila Tretikov, cựu phó giám đốc công nghệ tại Microsoft, nói.

Mặt khác, việc thanh toán có thể có ý nghĩa quan trọng hơn nhiều đối với xã hội rộng lớn hơn. Microsoft đã rất cẩn thận với cách nói về AI, một người có kiến thức trực tiếp về tiếp thị AI của công ty, người yêu cầu không được xác định: Copilot được cho là giúp hoàn thành nhiệm vụ, không phải tự động hóa công việc. Các cuộc phỏng vấn với khách hàng và nhân viên bán hàng của Microsoft cho thấy điều sau đã xảy ra. Họ mô tả các nhà thầu, lập trình viên thuê ngoài, thực tập sinh và nhà phân tích mùa hè đều mất việc vì AI.

Trong cuốn sách The Coming Wave, xuất bản trước khi ông gia nhập Microsoft, Suleyman đã nêu rõ những rủi ro. "Những công cụ này sẽ chỉ tạm thời tăng cường trí thông minh của con người. Chúng sẽ làm cho chúng ta thông minh hơn và hiệu quả hơn trong một thời gian, và sẽ mở ra lượng tăng trưởng kinh tế khổng lồ, nhưng về cơ bản chúng đang thay thế lao động," ông viết. Suleyman ủng hộ giám sát quy định và các can thiệp khác của chính phủ như thuế mới đối với các hệ thống tự động và thu nhập cơ bản phổ quát để ngăn chặn sự sụp đổ kinh tế xã hội.

Nadella lạc quan hơn người phó của mình. Trong một cuộc phỏng vấn tại trụ sở Microsoft trong phòng hội nghị #34-3563, ngồi cạnh tổng tham mưu trưởng con người của mình, Nadella lập luận rằng các trợ lý Copilot của ông sẽ không thay thế cô ấy. Khi cô lạnh lùng gõ ghi chú về cuộc trò chuyện của chúng tôi trên máy tính bảng, ông thừa nhận rằng AI sẽ gây ra "sự thay đổi khó khăn và thay đổi trong các nhóm lao động," bao gồm cả Microsoft. (Althoff, giám đốc bán hàng, nói rằng Nadella đang gây áp lực cho nhóm của ông để tìm cách sử dụng AI để tăng doanh thu từ hoạt động thay vì tăng số lượng nhân viên. Trong khi đó, Microsoft cho biết vào ngày 13 tháng 5 rằng họ đang cắt giảm 6.000 nhân viên, khoảng 3% lực lượng lao động.) Nhưng Nadella cho rằng AI có thể mang lại nhiều lợi ích xã hội hơn so với cuộc cách mạng công nghiệp. "Khi bạn tạo ra sự dồi dào," ông nói, "thì câu hỏi là một người làm gì với sự dồi dào đó để tạo ra nhiều thặng dư hơn."

Ông lập luận, một lần nữa, rằng nó trở lại với kinh tế. Nếu Microsoft chi hàng trăm tỷ đô la cho các dự án AI, ông ước tính rằng điều đó có thể tạo ra hàng nghìn tỷ đô la hoạt động kinh tế—nhiều trung tâm dữ liệu hơn có nghĩa là nhiều xây dựng, sử dụng năng lượng, thiết bị sản xuất và vân vân. Nhiều sử dụng AI có nghĩa là nhiều cơ hội hơn để tạo ra các loại hình kinh doanh mới, đặc biệt là khi AI thu hẹp khoảng cách kỹ năng giữa một nhân viên mới, kỹ sư chuyên gia và giám đốc điều hành. "Có thể có một công ty khởi nghiệp mới với một trăm nhà sáng lập," Nadella nói. Hoặc, nếu AI đủ tốt, có lẽ 100 công ty khởi nghiệp với chỉ một nhà sáng lập.

Sẽ mất thời gian để các công việc của kỷ nguyên AI xuất hiện, ông nói. Và sau đó sự thúc đẩy kinh tế và năng suất lớn sẽ theo sau. Giống như chúng đã làm sau sự ra đời của động cơ hơi nước, điện, máy tính và internet. "Khi điều đó xảy ra, thì mọi thứ đều tính toán ở cấp độ xã hội," Nadella nói. "Nếu không, tất cả những gì bạn có là một đống GPU."