2 tiêu chuẩn đánh giá mới từ MLCommons giúp đo lường tốc độ chạy ứng dụng AI

- Tổ chức MLCommons vừa công bố 2 tiêu chuẩn đánh giá mới giúp xác định tốc độ phần cứng và phần mềm hàng đầu có thể chạy các ứng dụng AI.

- Kể từ khi ChatGPT ra mắt hơn 2 năm trước, các công ty chip đã chuyển hướng tập trung vào việc sản xuất phần cứng có thể chạy hiệu quả mã nguồn cho phép hàng triệu người sử dụng công cụ AI.

- Tiêu chuẩn đánh giá đầu tiên dựa trên mô hình AI Llama 3.1 với 405 tỷ tham số của Meta, nhắm vào khả năng trả lời câu hỏi chung, toán học và tạo mã. Định dạng mới này kiểm tra khả năng xử lý truy vấn lớn và tổng hợp dữ liệu từ nhiều nguồn.

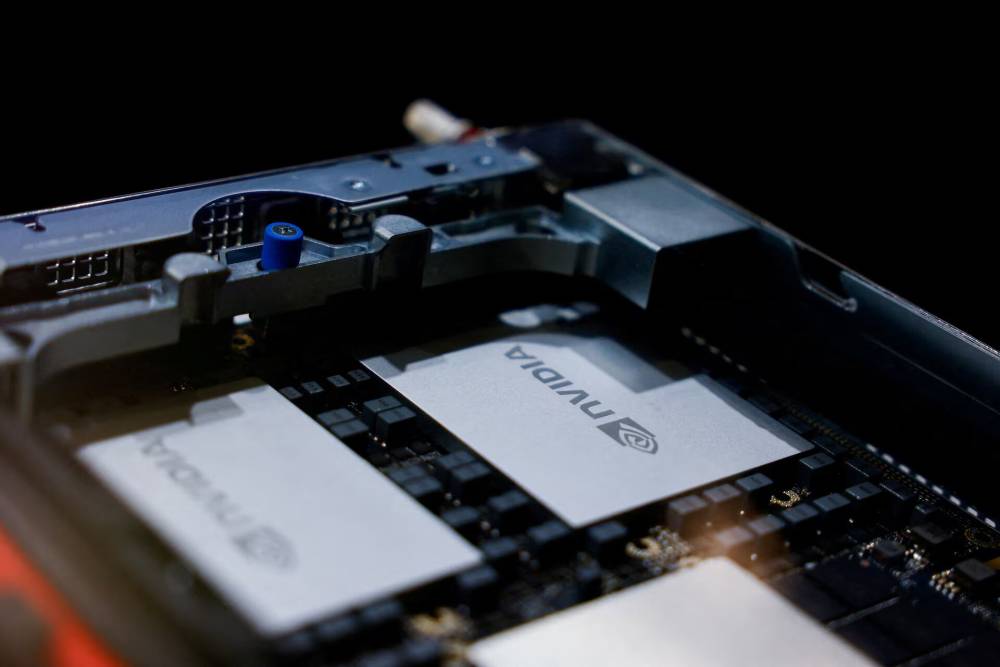

- Nvidia đã gửi nhiều loại chip của mình để đánh giá, cùng với các nhà sản xuất hệ thống như Dell Technologies. Theo dữ liệu từ MLCommons, Advanced Micro Devices (AMD) không có bài đánh giá nào cho tiêu chuẩn mô hình lớn 405 tỷ tham số.

- Máy chủ AI thế hệ mới nhất của Nvidia - Grace Blackwell, chứa 72 đơn vị xử lý đồ họa (GPU) - nhanh hơn 2,8 đến 3,4 lần so với thế hệ trước, ngay cả khi chỉ sử dụng 8 GPU trong máy chủ mới để tạo so sánh trực tiếp với mô hình cũ.

- Nvidia đang nỗ lực tăng tốc kết nối giữa các chip trong máy chủ, điều này đặc biệt quan trọng trong công việc AI khi chatbot chạy trên nhiều chip cùng lúc.

- Tiêu chuẩn đánh giá thứ hai cũng dựa trên mô hình AI nguồn mở do Meta xây dựng và nhằm mô phỏng chính xác hơn kỳ vọng về hiệu suất của các ứng dụng AI tiêu dùng như ChatGPT.

- Các tiêu chuẩn mới này được phát triển khi các mô hình cơ bản cần phải đáp ứng nhiều truy vấn hơn để cung cấp năng lượng cho các ứng dụng AI như chatbot và công cụ tìm kiếm.

📌 MLCommons đã phát triển 2 tiêu chuẩn đánh giá mới để đo lường tốc độ chạy ứng dụng AI, với máy chủ Grace Blackwell của Nvidia dẫn đầu, nhanh hơn 3,4 lần so với thế hệ trước. Các tiêu chuẩn này dựa trên mô hình Llama 3.1 405 tỷ tham số của Meta, giúp đánh giá khả năng xử lý truy vấn phức tạp.

https://www.reuters.com/technology/artificial-intelligence/new-ai-benchmarks-test-speed-running-ai-applications-2025-04-02/

Thảo luận

Follow Us

Tin phổ biến