Bên trong cuộc khủng hoảng chưa từng có tại OpenAI

-

Mùa hè 2023, Ilya Sutskever – đồng sáng lập và giám đốc khoa học OpenAI – bắt đầu nói về việc xây "hầm trú" cho các nhà khoa học AI trước khi phát hành AGI, do lo ngại chính phủ toàn cầu sẽ tranh giành công nghệ này.

-

Ông tin rằng AGI đang đến gần, có thể là sự kiện mang tính tận thế hoặc "sự rỗi linh hồn". Đồng thời, ông chuyển một nửa thời gian từ phát triển sang an toàn AI.

-

Khi OpenAI phát triển, mâu thuẫn nội bộ nảy sinh: mục tiêu phát triển AGI vì lợi ích nhân loại bị thay thế bởi thương mại hóa nhanh chóng.

-

Sam Altman bị chỉ trích vì thiếu minh bạch, lách quy trình an toàn, phớt lờ ý kiến cấp dưới và đẩy sản phẩm ra thị trường quá nhanh.

-

Cuối năm 2023, Sutskever và CTO Mira Murati bí mật đề nghị hội đồng quản trị loại bỏ Altman. Ngày 17/11/2023, Altman bị sa thải, Murati được bổ nhiệm làm CEO tạm quyền.

-

Tuy nhiên, nhân viên nổi loạn, lo sợ mất giá trị cổ phiếu và vị thế công ty. Altman và Greg Brockman tuyên bố đó là một “cuộc đảo chính”.

-

Truyền thông nội bộ rối loạn. Sutskever không thể giải thích rõ ràng trong buổi họp công ty. Các giám đốc như Jason Kwon và Anna Makanju phản đối hội đồng quản trị.

-

Đối mặt với sự tan rã, Sutskever và Murati quay lưng với hội đồng. Altman trở lại, củng cố quyền lực.

-

OpenAI ngày nay bị chỉ trích vì thiếu minh bạch, thương mại hóa mạnh mẽ, gây áp lực tài chính cho ngành AI, tập trung quyền lực vào tay một nhóm nhỏ.

-

Dù gọi là phi lợi nhuận, OpenAI huy động 40 tỉ USD trong một vòng đầu tư, đạt định giá 300 tỉ USD. Trong khi đó, người lao động ở Kenya, nghệ sĩ, nhà báo đang chịu tổn thất.

-

Murati và Sutskever sau đó rời khỏi công ty, lập tổ chức riêng để cạnh tranh giành quyền định hình tương lai AI.

📌 Cuộc khủng hoảng nội bộ lịch sử tại OpenAI năm 2023 – được gọi là “The Blip” – phơi bày mâu thuẫn giữa lý tưởng ban đầu và hiện thực thương mại hóa. Ilya Sutskever từng đề xuất xây hầm trú AGI, còn Sam Altman bị lật đổ rồi phục vị sau 3 ngày. OpenAI giờ trở thành đế chế AI trị giá 300 tỉ USD, tập trung quyền lực, gây bất bình đẳng và xa rời cam kết vì nhân loại.

https://www.theatlantic.com/technology/archive/2025/05/karen-hao-empire-of-ai-excerpt/682798/

'Chúng tôi chắc chắn sẽ xây hầm trú ẩn trước khi phát hành AGI'

Câu chuyện thật đằng sau sự hỗn loạn tại OpenAI

Tác giả: Karen Hao

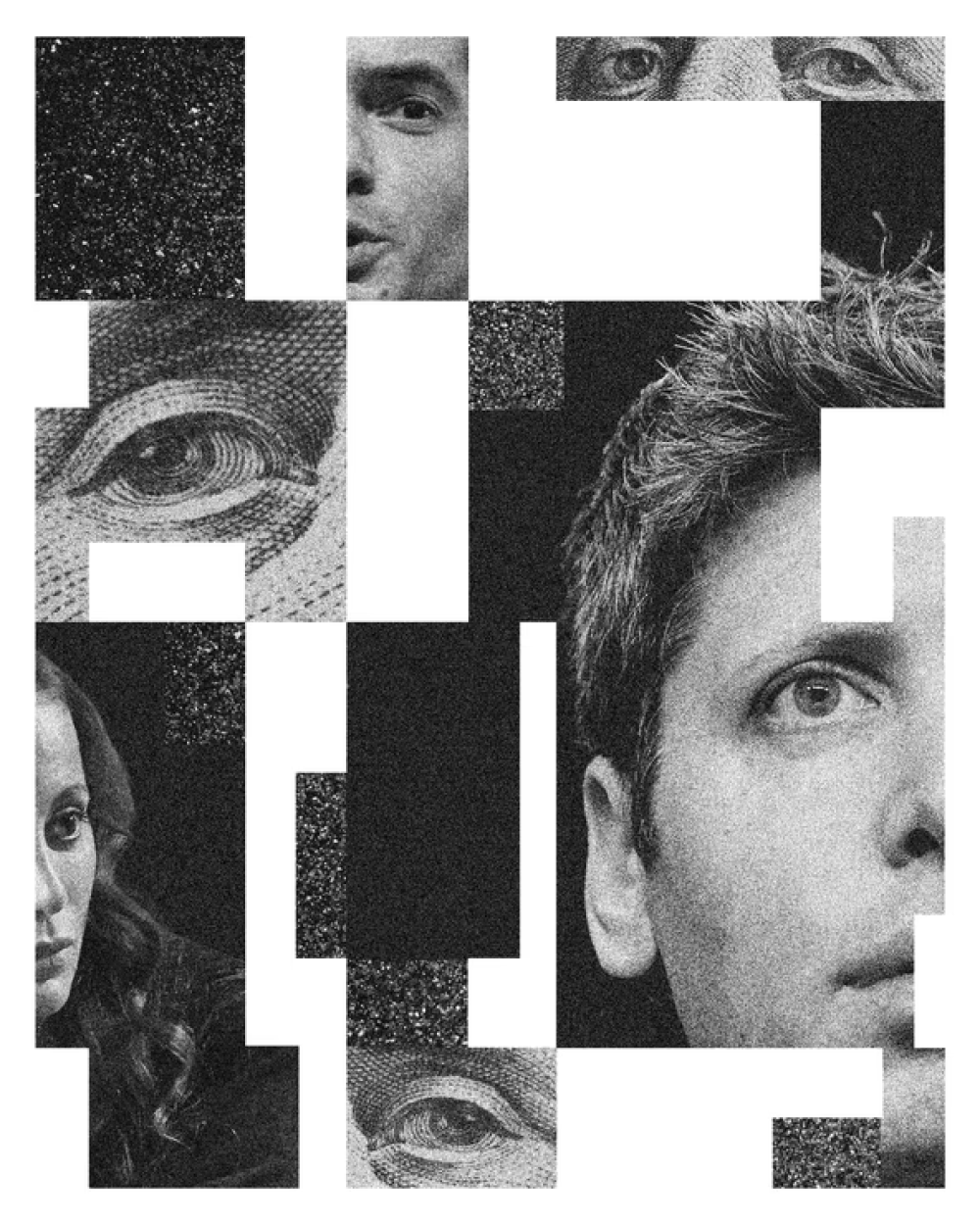

Tranh minh họa của Akshita Chandra / The Atlantic.

15/5/2025, 5:02 chiều theo giờ ET

Vào mùa hè năm 2023, Ilya Sutskever, đồng sáng lập và trưởng khoa học của OpenAI, đang họp với một nhóm nghiên cứu viên mới tại công ty. Theo mọi thước đo truyền thống, Sutskever đáng lẽ phải cảm thấy bất khả chiến bại: Anh là bộ não đứng sau các mô hình ngôn ngữ lớn đã giúp xây dựng ChatGPT, ứng dụng phát triển nhanh nhất trong lịch sử; giá trị công ty của anh đã tăng vọt; và OpenAI là nhà lãnh đạo không đối thủ của ngành công nghiệp được tin rằng sẽ thúc đẩy tương lai của Thung lũng Silicon. Nhưng vị trưởng khoa học dường như đang chiến đấu với chính mình.

Sutskever từ lâu đã tin rằng trí tuệ nhân tạo tổng quát, hay AGI, là điều không thể tránh khỏi—giờ đây, khi mọi thứ đang tăng tốc trong ngành AI tạo sinh, anh tin rằng sự xuất hiện của AGI là sắp xảy ra, theo Geoff Hinton, một nhà tiên phong AI đã từng là cố vấn tiến sĩ và người hướng dẫn của anh, cùng một người khác am hiểu tư duy của Sutskever. (Nhiều nguồn tin trong bài viết này yêu cầu ẩn danh để có thể nói thoải mái về OpenAI mà không sợ bị trả đũa.) Đối với những người xung quanh, Sutskever dường như bị ám ảnh bởi suy nghĩ về sự chuyển đổi nền văn minh sắp xảy ra này. Thế giới sẽ như thế nào khi một AGI tối cao xuất hiện và vượt qua nhân loại? Và OpenAI có trách nhiệm gì để đảm bảo một trạng thái cuối cùng của sự thịnh vượng phi thường, không phải đau khổ phi thường?

Đến lúc đó, Sutskever, trước đây dành phần lớn thời gian để phát triển khả năng AI, đã bắt đầu tập trung một nửa thời gian cho an toàn AI. Anh xuất hiện trước những người xung quanh vừa như người bi quan vừa như người lạc quan: vừa phấn khích vừa sợ hãi hơn bao giờ hết về những gì sắp tới. Ngày hôm đó, trong cuộc họp với các nhà nghiên cứu mới, anh đã vạch ra một kế hoạch.

"Khi tất cả chúng ta vào hầm trú ẩn—" anh bắt đầu, theo lời kể của một nhà nghiên cứu có mặt.

"Xin lỗi," nhà nghiên cứu ngắt lời, "hầm trú ẩn?"

"Chúng tôi chắc chắn sẽ xây một hầm trú ẩn trước khi phát hành AGI," Sutskever trả lời. Một công nghệ mạnh mẽ như vậy chắc chắn sẽ trở thành đối tượng được các chính phủ trên toàn cầu thèm muốn mãnh liệt. Các nhà khoa học cốt lõi làm việc với công nghệ này sẽ cần được bảo vệ. "Tất nhiên," anh nói thêm, "việc bạn có muốn vào hầm trú ẩn hay không là tùy chọn."

Hai nguồn tin khác mà tôi đã nói chuyện xác nhận rằng Sutskever thường đề cập đến hầm trú ẩn như vậy. "Có một nhóm người—Ilya là một trong số đó—tin rằng việc xây dựng AGI sẽ mang lại sự huy hoàng," nhà nghiên cứu này nói với tôi. "Một sự huy hoàng theo nghĩa đen." (Sutskever từ chối bình luận về câu chuyện này.)

Nỗi sợ hãi của Sutskever về một AI toàn năng có vẻ cực đoan, nhưng không hoàn toàn hiếm gặp, cũng không đặc biệt đi chệch hướng với thái độ chung của OpenAI vào thời điểm đó. Vào tháng 5/2023, CEO của công ty, Sam Altman, đã đồng ký một lá thư ngỏ mô tả công nghệ này như một rủi ro tuyệt chủng tiềm ẩn—một câu chuyện đã giúp OpenAI định vị mình và định hướng các cuộc đối thoại về quy định. Tuy nhiên, những lo ngại về tận thế sắp tới cũng phải cân bằng với hoạt động kinh doanh ngày càng phát triển của OpenAI: ChatGPT đã thành công lớn, và Altman muốn nhiều hơn nữa.

Khi OpenAI được thành lập, ý tưởng là phát triển AGI vì lợi ích của nhân loại. Để đạt được mục tiêu đó, các đồng sáng lập—bao gồm Altman và Elon Musk—đã thành lập tổ chức là một tổ chức phi lợi nhuận và cam kết chia sẻ nghiên cứu với các tổ chức khác. Sự tham gia dân chủ trong phát triển công nghệ là một nguyên tắc quan trọng mà họ đồng ý, do đó có tên công ty. Nhưng đến khi tôi bắt đầu theo dõi công ty vào năm 2019, những lý tưởng này đang dần mất đi. Các giám đốc điều hành của OpenAI đã nhận ra rằng con đường họ muốn đi sẽ đòi hỏi một lượng tiền khổng lồ. Cả Musk và Altman đều cố gắng trở thành CEO. Altman đã thắng. Musk rời khỏi tổ chức vào đầu năm 2018 và mang tiền của mình đi. Để lấp đầy lỗ hổng, Altman đã cải tổ cấu trúc pháp lý của OpenAI, tạo ra một bộ phận "lợi nhuận có giới hạn" mới trong tổ chức phi lợi nhuận để huy động thêm vốn.

Kể từ đó, tôi đã theo dõi sự phát triển của OpenAI thông qua các cuộc phỏng vấn với hơn 90 nhân viên hiện tại và cựu nhân viên, bao gồm cả các giám đốc điều hành và nhà thầu. Công ty đã từ chối các yêu cầu phỏng vấn và câu hỏi liên tục của tôi trong quá trình làm việc trên cuốn sách về công ty, mà câu chuyện này được trích từ đó; họ không trả lời khi tôi liên hệ thêm một lần nữa trước khi bài viết được xuất bản. (OpenAI cũng có quan hệ đối tác doanh nghiệp với The Atlantic.)

Các nền văn hóa đối lập của OpenAI—tham vọng phát triển AGI một cách an toàn và mong muốn phát triển một lượng người dùng khổng lồ thông qua các sản phẩm mới—sẽ bùng nổ vào cuối năm 2023. Lo ngại sâu sắc về hướng đi mà Altman đang đưa công ty đi, Sutskever sẽ tiếp cận hội đồng quản trị cùng với đồng nghiệp Mira Murati, khi đó là trưởng công nghệ của OpenAI; hội đồng sau đó sẽ kết luận cần phải đẩy CEO ra ngoài. Những gì xảy ra tiếp theo—với việc sa thải và sau đó là bổ nhiệm lại Altman—đã làm rung chuyển ngành công nghệ. Tuy nhiên, kể từ đó, OpenAI và Sam Altman đã trở nên quan trọng hơn đối với các vấn đề thế giới. Tuần trước, công ty đã ra mắt sáng kiến "OpenAI cho các Quốc gia" cho phép OpenAI đóng vai trò quan trọng trong việc phát triển cơ sở hạ tầng AI bên ngoài Hoa Kỳ. Và Altman đã trở thành đồng minh của chính quyền Trump, xuất hiện, ví dụ, tại một sự kiện với các quan chức Ả Rập Saudi tuần này và trên sân khấu với tổng thống vào tháng 1 để công bố dự án cơ sở hạ tầng máy tính AI trị giá 500 tỷ đô la.

Việc Altman bị sa thải ngắn ngủi—và khả năng trở lại và củng cố quyền lực của anh—hiện là lịch sử quan trọng để hiểu vị trí của công ty tại thời điểm then chốt này cho tương lai của sự phát triển AI. Các chi tiết đã bị thiếu trong các báo cáo trước đây về sự cố này, bao gồm thông tin làm sáng tỏ tư duy của Sutskever và Murati và phản ứng từ các nhân viên. Ở đây, chúng được trình bày lần đầu tiên, theo lời kể của hơn một chục người đã trực tiếp tham gia hoặc gần gũi với những người trực tiếp tham gia, cũng như ghi chú đồng thời của họ, cùng với ảnh chụp màn hình tin nhắn Slack, email, bản ghi âm và các bằng chứng khác.

OpenAI vị tha đã không còn, nếu nó từng tồn tại. Công ty đang xây dựng tương lai nào bây giờ?

Trước ChatGPT, các nguồn tin nói với tôi rằng Altman nhìn chung có vẻ tràn đầy năng lượng. Giờ đây, anh thường xuất hiện trong tình trạng kiệt sức. Được đẩy lên vị trí siêu sao, anh đang đối mặt với sự giám sát tăng cường và lịch trình di chuyển quá tải. Trong khi đó, Google, Meta, Anthropic, Perplexity và nhiều công ty khác đều đang phát triển các sản phẩm AI tạo sinh của riêng họ để cạnh tranh với chatbot của OpenAI.

Nhiều giám đốc điều hành thân cận nhất của Altman từ lâu đã quan sát thấy một kiểu hành vi cụ thể của anh: Nếu hai nhóm không đồng ý, anh thường đồng ý riêng với từng quan điểm của họ, điều này tạo ra sự nhầm lẫn và nuôi dưỡng sự không tin tưởng giữa các đồng nghiệp. Giờ đây, Altman cũng thường xuyên nói xấu nhân viên sau lưng họ trong khi thúc đẩy họ triển khai sản phẩm nhanh hơn và nhanh hơn nữa. Các trưởng nhóm bắt chước hành vi của anh bắt đầu đặt nhân viên chống lại nhau. Các nguồn tin nói với tôi rằng Greg Brockman, một đồng sáng lập khác của OpenAI và là chủ tịch, đã làm trầm trọng thêm vấn đề khi anh nhảy vào các dự án và phá hoại các kế hoạch lâu dài bằng những thay đổi vào phút chót.

Môi trường trong OpenAI đang thay đổi. Trước đây, Sutskever đã cố gắng đoàn kết nhân viên sau một mục tiêu chung. Trong số các nhân viên, anh được biết đến như một nhà tư duy sâu sắc và thậm chí là một người thần bí, thường xuyên nói bằng ngôn ngữ tâm linh. Anh mặc những chiếc áo có hình động vật đến văn phòng và cũng vẽ chúng—một con mèo dễ thương, những con alpaca dễ thương, một con rồng phun lửa dễ thương. Một trong những bức tranh nghiệp dư của anh treo trong văn phòng, một bộ ba hoa nở theo hình dạng logo của OpenAI, một biểu tượng cho những gì anh luôn thúc giục nhân viên xây dựng: "Nhiều AGI yêu thương nhân loại."

Nhưng đến giữa năm 2023—khoảng thời gian anh bắt đầu nói thường xuyên hơn về ý tưởng về hầm trú ẩn—Sutskever không chỉ còn bận tâm về những thay đổi thảm khốc có thể xảy ra của AGI và siêu trí tuệ, theo các nguồn tin am hiểu tư duy của anh. Anh còn bị ám ảnh bởi một lo lắng khác: sự xói mòn niềm tin của anh rằng OpenAI thậm chí có thể theo kịp những tiến bộ kỹ thuật để đạt đến AGI, hoặc gánh vác trách nhiệm đó với Altman là nhà lãnh đạo. Sutskever cảm thấy kiểu hành vi của Altman đang làm suy yếu hai trụ cột trong sứ mệnh của OpenAI, các nguồn tin cho biết: Nó đang làm chậm tiến độ nghiên cứu và xói mòn bất kỳ cơ hội nào để đưa ra quyết định an toàn AI hợp lý.

Trong khi đó, Murati đang cố gắng quản lý mớ hỗn độn. Cô luôn đóng vai trò là người phiên dịch và cầu nối với Altman. Nếu anh có điều chỉnh về hướng chiến lược của công ty, cô là người thực hiện. Nếu một nhóm cần phản đối quyết định của anh, cô là người ủng hộ họ. Khi mọi người cảm thấy thất vọng vì không thể nhận được câu trả lời thẳng thắn từ Altman, họ tìm kiếm sự giúp đỡ của cô. "Cô ấy là người hoàn thành công việc," một cựu đồng nghiệp của cô nói với tôi. (Murati từ chối bình luận.)

Trong quá trình phát triển GPT-4, động lực giữa Altman và Brockman gần như khiến những người quan trọng từ bỏ, các nguồn tin cho biết. Altman cũng dường như đang cố gắng bỏ qua các quy trình an toàn vì tính kịp thời. Tại một thời điểm, các nguồn tin gần với tình huống này cho biết, anh đã nói với Murati rằng nhóm pháp lý của OpenAI đã chấp thuận cho mô hình mới nhất, GPT-4 Turbo, bỏ qua việc đánh giá bởi Hội đồng An toàn Triển khai, hay DSB—một ủy ban gồm các đại diện của Microsoft và OpenAI đánh giá liệu các mô hình mạnh mẽ nhất của OpenAI đã sẵn sàng để phát hành chưa. Nhưng khi Murati kiểm tra với Jason Kwon, người giám sát nhóm pháp lý, Kwon hoàn toàn không biết làm thế nào Altman có ấn tượng đó.

Vào mùa hè, Murati đã cố gắng đưa ra phản hồi chi tiết cho Altman về những vấn đề này, theo nhiều nguồn tin. Nhưng không hiệu quả. CEO đã lạnh nhạt với cô, và phải mất nhiều tuần để hàn gắn mối quan hệ.

Đến mùa thu, Sutskever và Murati đều rút ra cùng một kết luận. Họ riêng biệt tiếp cận ba thành viên hội đồng không phải là nhân viên OpenAI—Helen Toner, giám đốc tại Trung tâm An ninh và Công nghệ Mới nổi của Đại học Georgetown; nhà khoa học robot Tasha McCauley; và một trong những đồng sáng lập của Quora và CEO của nó, Adam D'Angelo—và nêu lên lo ngại về sự lãnh đạo của Altman. "Tôi không nghĩ Sam là người nên có ngón tay trên nút bấm cho AGI," Sutskever nói trong một cuộc họp như vậy, theo ghi chú mà tôi đã xem xét. "Tôi không cảm thấy thoải mái về việc Sam dẫn dắt chúng ta đến AGI," Murati nói trong một cuộc họp khác, theo các nguồn tin quen thuộc với cuộc trò chuyện.

Việc Sutskever và Murati đều cảm thấy như vậy đã có ảnh hưởng lớn đến Toner, McCauley và D'Angelo. Trong gần một năm, họ cũng đã xử lý những lo ngại nghiêm trọng của riêng họ về Altman, theo các nguồn tin quen thuộc với suy nghĩ của họ. Trong số nhiều nghi ngờ, ba giám đốc đã phát hiện thông qua một loạt các cuộc gặp tình cờ rằng anh đã không thẳng thắn với họ về một loạt các vấn đề, từ vi phạm các quy trình của DSB đến cấu trúc pháp lý của OpenAI Startup Fund, một phương tiện ký kết thỏa thuận được cho là thuộc công ty nhưng thay vào đó Altman lại sở hữu.

Nếu hai phó tướng cấp cao nhất của Altman đang báo động về sự lãnh đạo của anh, hội đồng quản trị có một vấn đề nghiêm trọng. Sutskever và Murati cũng không phải là những người đầu tiên nêu lên những vấn đề kiểu này. Tổng cộng, ba giám đốc đã nghe phản hồi tương tự trong những năm qua từ ít nhất năm người khác trong vòng một đến hai cấp dưới Altman, các nguồn tin cho biết. Đến cuối tháng 10, Toner, McCauley và D'Angelo bắt đầu họp gần như hàng ngày qua các cuộc gọi video, đồng ý rằng phản hồi của Sutskever và Murati về Altman, và đề xuất của Sutskever về việc sa thải anh, đáng được cân nhắc nghiêm túc.

Khi họ làm như vậy, Sutskever đã gửi cho họ các hồ sơ dài của tài liệu và ảnh chụp màn hình mà anh và Murati đã thu thập song song với các ví dụ về hành vi của Altman. Các ảnh chụp màn hình cho thấy ít nhất hai nhà lãnh đạo cấp cao khác ghi nhận xu hướng của Altman trong việc lách hoặc bỏ qua các quy trình, cho dù chúng đã được thiết lập vì lý do an toàn AI hay để làm trơn tru hoạt động của công ty. Điều này bao gồm, các giám đốc đã biết, nỗ lực rõ ràng của Altman nhằm bỏ qua việc DSB xem xét GPT-4 Turbo.

Vào thứ Bảy, ngày 11 tháng 11, các giám đốc độc lập đã đưa ra quyết định của họ. Như Sutskever đề xuất, họ sẽ loại bỏ Altman và bổ nhiệm Murati là CEO tạm thời. Vào ngày 17 tháng 11 năm 2023, khoảng 12 giờ trưa theo giờ Thái Bình Dương, Sutskever sa thải Altman qua Google Meet với ba thành viên hội đồng độc lập. Sutskever sau đó nói với Brockman qua một Google Meet khác rằng Brockman sẽ không còn trong hội đồng quản trị nhưng sẽ giữ vai trò của mình tại công ty. Một thông báo công khai được đưa ra ngay lập tức.

Trong một khoảnh khắc ngắn ngủi, tương lai của OpenAI là một câu hỏi mở. Có thể công ty đã đi theo con đường tránh xa thương mại hóa mạnh mẽ và Altman. Nhưng điều này đã không xảy ra.

Sau những gì có vẻ như vài giờ bình tĩnh và ổn định, bao gồm Murati có cuộc trò chuyện hiệu quả với Microsoft—vào thời điểm đó là nhà tài trợ tài chính lớn nhất của OpenAI—cô đột nhiên gọi cho các thành viên hội đồng quản trị với một vấn đề mới. Altman và Brockman đang nói với mọi người rằng việc loại bỏ Altman là một cuộc đảo chính của Sutskever, cô nói.

Điều đó không giúp ích gì khi, trong một cuộc họp toàn công ty để giải đáp câu hỏi của nhân viên, Sutskever đã hoàn toàn không hiệu quả trong giao tiếp của mình.

"Có sự cố cụ thể nào dẫn đến điều này không?" Murati đã đọc to từ danh sách câu hỏi của nhân viên, theo bản ghi âm mà tôi có được từ cuộc họp.

"Nhiều câu hỏi trong tài liệu sẽ liên quan đến chi tiết," Sutskever trả lời. "Cái gì, khi nào, như thế nào, ai, chính xác. Tôi ước gì tôi có thể đi vào chi tiết. Nhưng tôi không thể."

"Chúng ta có lo lắng về việc tiếp quản thù địch thông qua ảnh hưởng cưỡng chế của các thành viên hội đồng quản trị hiện tại?" Sutskever đọc từ một nhân viên khác sau đó.

"Tiếp quản thù địch?" Sutskever lặp lại, với một giọng điệu mới sắc nét trong giọng nói của anh. "Hội đồng quản trị phi lợi nhuận của OpenAI đã hành động hoàn toàn theo mục tiêu của mình. Đây không phải là một cuộc tiếp quản thù địch. Không hề. Tôi không đồng ý với câu hỏi này."

Ngay sau đó, hội đồng quản trị còn lại, bao gồm Sutskever, đối mặt với sự lãnh đạo tức giận qua cuộc gọi video. Kwon, giám đốc chiến lược, và Anna Makanju, phó chủ tịch về các vấn đề toàn cầu, đang dẫn đầu trong việc bác bỏ đặc điểm của hội đồng quản trị về hành vi của Altman là "không nhất quán thẳng thắn", theo các nguồn tin có mặt tại cuộc họp. Họ yêu cầu bằng chứng để hỗ trợ quyết định của hội đồng quản trị, điều mà các thành viên cảm thấy không thể cung cấp mà không tiết lộ Murati, theo các nguồn tin quen thuộc với suy nghĩ của họ.

Trong chuỗi nhanh chóng ngày hôm đó, Brockman từ chức để phản đối, theo sau là ba nhà nghiên cứu cấp cao khác. Trong suốt buổi tối, nhân viên chỉ càng tức giận hơn, bị kích động bởi các vấn đề chồng chất: trong số đó, thiếu rõ ràng từ hội đồng quản trị về lý do sa thải Altman; mất tiềm năng của một đề nghị chào bán, đã cho một số người lựa chọn bán cổ phần của họ có thể lên tới hàng triệu đô la; và nỗi sợ ngày càng tăng rằng sự bất ổn tại công ty có thể dẫn đến sự tan rã, điều này sẽ lãng phí rất nhiều triển vọng và công sức.

Đối mặt với khả năng OpenAI sụp đổ, quyết tâm của Sutskever ngay lập tức bắt đầu sụp đổ. OpenAI là đứa con của anh, cuộc sống của anh; sự tan rã của nó sẽ phá hủy anh. Anh bắt đầu van nài các đồng nghiệp trong hội đồng quản trị xem xét lại lập trường của họ đối với Altman.

Trong khi đó, vị trí tạm thời của Murati đang bị thách thức. Sự bùng nổ trong công ty cũng đang lan rộng đến một vòng tròn nhà đầu tư ngày càng tăng. Murati giờ đây không sẵn sàng ném hết sức nặng của mình ủng hộ quyết định của hội đồng quản trị sa thải Altman. Mặc dù phản hồi của cô đã giúp khởi xướng việc này, cô đã không tham gia vào quá trình cân nhắc.

Đến sáng thứ Hai, hội đồng quản trị đã thua. Murati và Sutskever đã đổi phe. Altman sẽ trở lại; không có cách nào khác để cứu OpenAI.

Tôi đã làm việc trên một cuốn sách về OpenAI vào thời điểm đó, và trong những tuần sau cuộc khủng hoảng hội đồng quản trị, bạn bè, gia đình và truyền thông đã hỏi tôi hàng chục lần: Tất cả điều này có ý nghĩa gì, nếu có? Đối với tôi, vở kịch này đã làm nổi bật một trong những câu hỏi cấp bách nhất của thế hệ chúng ta: Làm thế nào để quản trị trí tuệ nhân tạo? Với AI đang trên đà đi dây lại rất nhiều chức năng quan trọng khác trong xã hội, câu hỏi đó thực sự đang hỏi: Làm thế nào để đảm bảo rằng chúng ta sẽ làm cho tương lai của mình tốt đẹp hơn, không phải tệ hơn?

Các sự kiện của tháng 11 năm 2023 đã minh họa bằng những thuật ngữ rõ ràng nhất về mức độ tranh giành quyền lực giữa một nhóm nhỏ tinh hoa Thung lũng Silicon hiện đang định hình tương lai của công nghệ này. Và bảng điểm của cách tiếp cận tập trung này đối với sự phát triển AI rất đáng lo ngại. OpenAI ngày nay đã trở thành mọi thứ mà công ty nói sẽ không là. Nó đã biến thành một tổ chức phi lợi nhuận chỉ trên danh nghĩa, tích cực thương mại hóa các sản phẩm như ChatGPT và tìm kiếm định giá lịch sử. Nó ngày càng bí mật, không chỉ cắt đứt quyền truy cập vào nghiên cứu của riêng mình mà còn thay đổi các chuẩn mực trong toàn ngành để không còn chia sẻ các chi tiết kỹ thuật có ý nghĩa về các mô hình AI. Trong việc theo đuổi một tầm nhìn mơ hồ về tiến bộ, sự thúc đẩy mạnh mẽ của nó về các giới hạn quy mô đã viết lại các quy tắc cho một kỷ nguyên mới của sự phát triển AI. Giờ đây, mọi gã khổng lồ công nghệ đang chạy đua để vượt qua quy mô của nhau, chi tiêu những khoản tiền lớn đến mức ngay cả họ cũng phải vội vàng phân phối lại và củng cố các nguồn lực của mình. Những gì từng là chưa từng có đã trở thành chuẩn mực.

Kết quả là, các công ty AI này chưa bao giờ giàu có hơn. Vào tháng 3, OpenAI đã huy động được 40 tỷ đô la, vòng gọi vốn công nghệ tư nhân lớn nhất từ trước đến nay, và đạt mức định giá 300 tỷ đô la. Anthropic được định giá hơn 60 tỷ đô la. Gần cuối năm ngoái, sáu gã khổng lồ công nghệ lớn nhất cùng nhau đã thấy vốn hóa thị trường của họ tăng hơn 8 nghìn tỷ đô la sau ChatGPT. Đồng thời, ngày càng nhiều nghi ngờ đã xuất hiện về giá trị kinh tế thực sự của AI tạo sinh, bao gồm một khối lượng ngày càng tăng các nghiên cứu đã chỉ ra rằng công nghệ này không chuyển thành lợi ích năng suất cho hầu hết người lao động, trong khi nó cũng đang làm xói mòn tư duy phản biện của họ.

Trong một bài báo của Bloomberg vào tháng 11 đánh giá ngành công nghiệp AI tạo sinh, các nhà văn Parmy Olson và Carolyn Silverman đã tóm tắt nó một cách súc tích. Dữ liệu, họ viết, "đặt ra một viễn cảnh không thoải mái: rằng công nghệ được cho là mang tính cách mạng này có thể không bao giờ thực hiện được lời hứa về sự chuyển đổi kinh tế rộng rãi, mà thay vào đó chỉ tập trung thêm sự giàu có ở tầng lớp trên cùng."

Trong khi đó, không chỉ là thiếu lợi ích năng suất mà phần lớn còn lại của thế giới đang phải đối mặt. Chi phí nhân lực và vật chất đang bùng nổ đang đặt lên những phần rộng lớn của xã hội, đặc biệt là những người dễ bị tổn thương nhất, những người tôi đã gặp trên khắp thế giới, cho dù là người lao động và cư dân nông thôn ở phương Bắc toàn cầu hay các cộng đồng nghèo đói ở phương Nam toàn cầu, tất cả đều đang phải chịu đựng mức độ bấp bênh mới. Người lao động ở Kenya kiếm được mức lương thấp để lọc bỏ bạo lực và phát ngôn thù địch khỏi các công nghệ của OpenAI, bao gồm cả ChatGPT. Các nghệ sĩ đang bị thay thế bởi chính các mô hình AI được xây dựng từ công việc của họ mà không có sự đồng ý hoặc bồi thường. Ngành báo chí đang teo tóp khi các công nghệ AI tạo sinh sinh ra khối lượng thông tin sai lệch ngày càng tăng. Trước mắt chúng ta, chúng ta đang chứng kiến một câu chuyện cổ xưa lặp lại: Giống như các đế chế thời xưa, các đế chế mới của AI đang tích lũy sự giàu có phi thường trên không gian và thời gian với chi phí rất lớn cho tất cả mọi người khác.

Để xoa dịu những lo ngại ngày càng tăng về hiệu suất hiện tại của AI tạo sinh, Altman đã ca ngợi những lợi ích trong tương lai của AGI ngày càng mạnh mẽ hơn. Trong một bài đăng trên blog vào tháng 9 năm 2024, anh tuyên bố rằng "Thời đại Trí tuệ", đặc trưng bởi "sự thịnh vượng lớn", sẽ sớm đến với chúng ta. Tại thời điểm này, AGI phần lớn là thuật ngữ—một lời biện minh tuyệt vời, đa dụng cho OpenAI để tiếp tục thúc đẩy ngày càng nhiều sự giàu có và quyền lực. Dưới chiêu bài của một sứ mệnh văn minh hóa, đế chế AI đang đẩy nhanh sự mở rộng toàn cầu và củng cố quyền lực của mình.

Về phần Sutskever và Murati, cả hai đều chia tay với OpenAI sau cái mà nhân viên giờ gọi là "Cú lóe sáng", gia nhập một chuỗi dài các nhà lãnh đạo đã rời khỏi tổ chức sau khi xung đột với Altman. Giống như nhiều người khác đã thất bại trong việc định hình lại OpenAI, hai người đã làm điều đã trở thành lựa chọn phổ biến nhất: Mỗi người đã thành lập cửa hàng riêng của mình, để cạnh tranh cho tương lai của công nghệ này.

Thảo luận

Follow Us

Tin phổ biến