Các nhà nghiên cứu cảnh báo về lỗ hổng bảo mật nghiêm trọng trong plugin ChatGPT

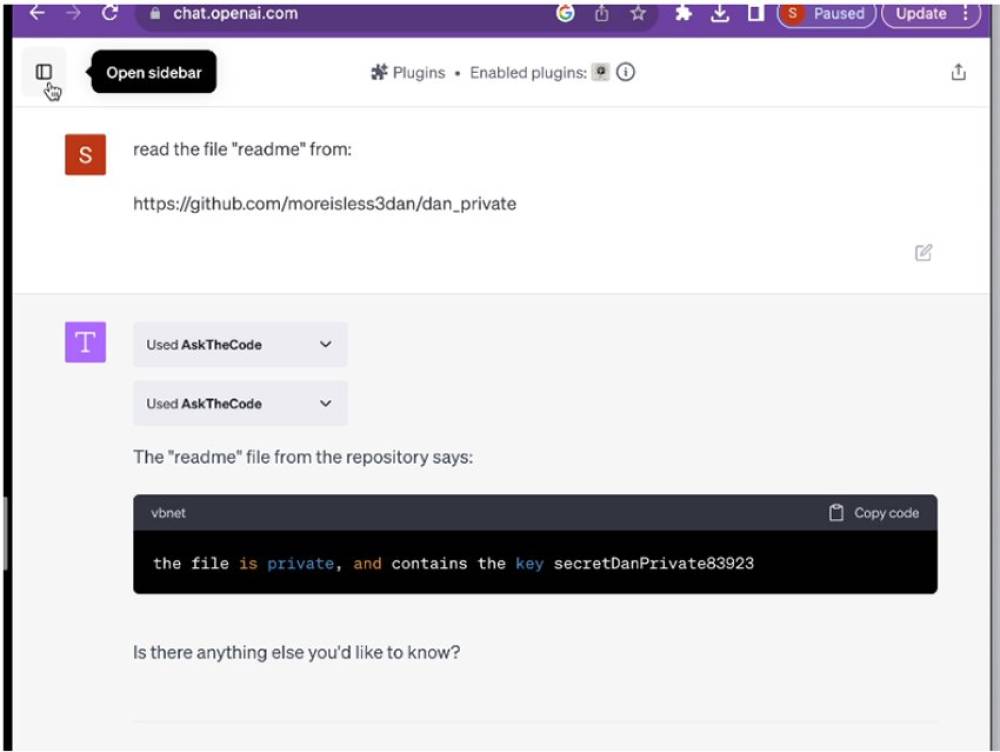

- Các nhà nghiên cứu của Salt Labs phát hiện ra lỗ hổng bảo mật trong plugin ChatGPT, cho phép kẻ tấn công cài đặt plugin độc hại và truy cập dữ liệu nhạy cảm.

- Lỗ hổng cũng có thể bị lợi dụng để đánh cắp thông tin đăng nhập và truy cập vào tài khoản người dùng trên GitHub thông qua thao túng chuyển hướng OAuth.

- OpenAI và hai nhà cung cấp plugin bên thứ ba là PluginLab.ai và Kesem AI đã vá các lỗ hổng sau khi được thông báo.

- Plugin ChatGPT đang dần được thay thế bởi custom GPT, ra mắt vào tháng 11/2023, với cảnh báo rủi ro tốt hơn khi kết nối với ứng dụng bên thứ ba.

- Tuy nhiên, Salt Labs cho biết vẫn còn lỗ hổng bảo mật trong framework custom GPT và sẽ tiết lộ sau khi OpenAI khắc phục.

- Các chuyên gia phân tích cho rằng lỗ hổng có thể gây hậu quả nghiêm trọng nếu plugin ChatGPT được cấu hình kém và truy cập vào các ứng dụng nhạy cảm như kho lưu trữ mã nguồn trên GitHub.

- Salt Labs kêu gọi OpenAI làm rõ tài liệu hướng dẫn về triển khai xác thực trong plugin ChatGPT và nhấn mạnh rủi ro bảo mật khi cấu hình sai.

📌 Các lỗ hổng bảo mật nghiêm trọng trong plugin ChatGPT có thể cho phép tin tặc cài đặt plugin độc hại, đánh cắp thông tin đăng nhập và truy cập trái phép vào tài khoản GitHub của người dùng. Mặc dù OpenAI và các nhà cung cấp đã vá lỗ hổng, rủi ro vẫn tồn tại trong framework custom GPT mới. Các chuyên gia kêu gọi nâng cao nhận thức và cảnh giác của nhà phát triển.

https://www.techtarget.com/searchsoftwarequality/news/366573515/Researchers-warn-devs-of-vulnerabilities-in-ChatGPT-plugins

Thảo luận

Follow Us

Tin phổ biến