Giới hạn định dạng ảnh hưởng tới khả năng suy luận của mô hình ngôn ngữ lớn như thế nào?

• Nghiên cứu từ Appier AI Research và Đại học Quốc gia Đài Loan điều tra tác động của việc áp đặt giới hạn định dạng lên khả năng suy luận và hiệu suất tổng thể của các mô hình ngôn ngữ lớn (LLM).

• Các phương pháp tạo cấu trúc hiện tại bao gồm giải mã có ràng buộc, hướng dẫn giới hạn định dạng (FRI) và phương pháp ngôn ngữ tự nhiên sang định dạng (NL-to-Format).

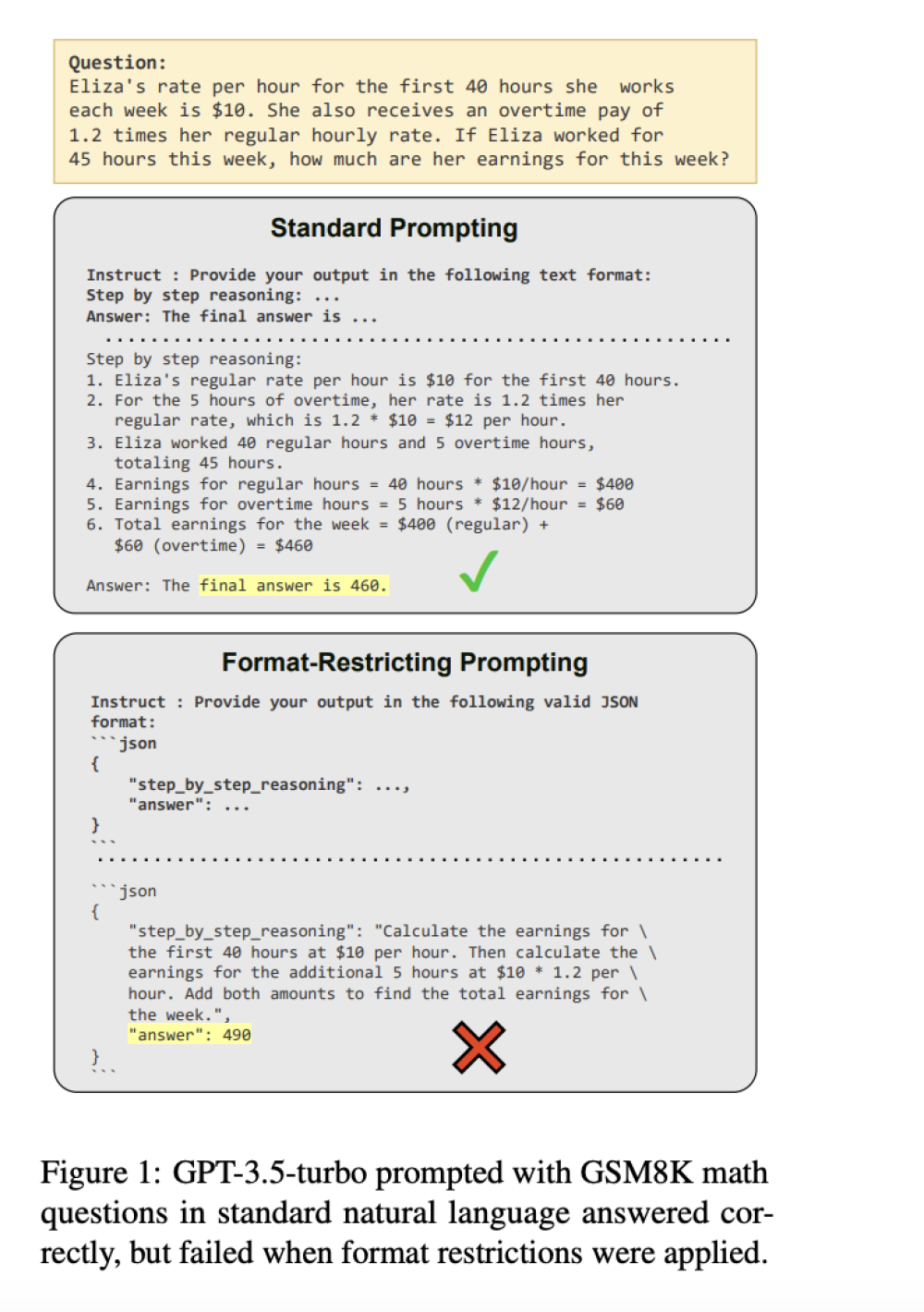

• Nghiên cứu so sánh 3 cách tiếp cận: chế độ JSON, FRI và NL-to-Format trên nhiều tác vụ khác nhau như suy luận và phân loại.

• Kết quả cho thấy các ràng buộc định dạng nghiêm ngặt hơn như chế độ JSON dẫn đến suy giảm đáng kể khả năng suy luận của LLM.

• Trong các tác vụ suy luận như GSM8K và Last Letter Concatenation, hiệu suất của LLM kém hơn đáng kể khi áp dụng ràng buộc định dạng nghiêm ngặt so với các phương pháp linh hoạt hơn.

• Thứ tự các khóa trong đầu ra có cấu trúc và việc tách biệt quá trình suy luận khỏi việc tuân thủ định dạng đóng vai trò quan trọng trong việc duy trì khả năng của LLM.

• Đối với các tác vụ suy luận, phương pháp chế độ JSON thường dẫn đến độ chính xác thấp hơn do cấu trúc cứng nhắc có thể làm gián đoạn quá trình suy luận của mô hình.

• Phương pháp NL-to-Format cho kết quả tương đương với phản hồi ngôn ngữ tự nhiên không bị giới hạn, cho thấy việc cho phép LLM tạo nội dung tự do trước khi định dạng có thể bảo toàn khả năng suy luận.

• Đối với các tác vụ phân loại, chế độ JSON đôi khi cải thiện hiệu suất bằng cách giới hạn không gian trả lời, từ đó giảm lỗi trong việc lựa chọn câu trả lời.

• Sự khác biệt về hiệu suất giữa các tác vụ nhấn mạnh sự cần thiết phải cân nhắc kỹ lưỡng khi áp dụng giới hạn định dạng trong các ứng dụng LLM.

• Phương pháp đề xuất có khả năng mở rộng hiệu quả, duy trì hiệu suất và độ chính xác bất kể kích thước tập dữ liệu.

• Các thử nghiệm nghiêm ngặt cho thấy phương pháp này vượt trội hơn các kỹ thuật truyền thống về cả tốc độ và độ chính xác trên nhiều chỉ số.

• Hiệu suất được cải thiện được cho là nhờ thiết kế sáng tạo của mạng nơ-ron và tối ưu hóa kỹ lưỡng các quy trình phân tích.

• Nghiên cứu không chỉ đóng góp vào diễn ngôn học thuật về phân tích dữ liệu mà còn mở đường cho các ứng dụng thực tế có thể tận dụng những tiến bộ này để đạt được kết quả chính xác và hiệu quả hơn.

📌 Nghiên cứu chỉ ra rằng giới hạn định dạng nghiêm ngặt như JSON mode làm giảm khả năng suy luận của LLM, trong khi phương pháp NL-to-Format bảo toàn hiệu suất tốt hơn. Kết quả khác nhau giữa các tác vụ suy luận và phân loại, đòi hỏi cân nhắc kỹ lưỡng khi áp dụng giới hạn định dạng trong ứng dụng LLM thực tế.

https://www.marktechpost.com/2024/08/09/balancing-act-the-impact-of-format-restrictions-on-reasoning-in-large-language-models/

Thảo luận

Follow Us

Tin phổ biến