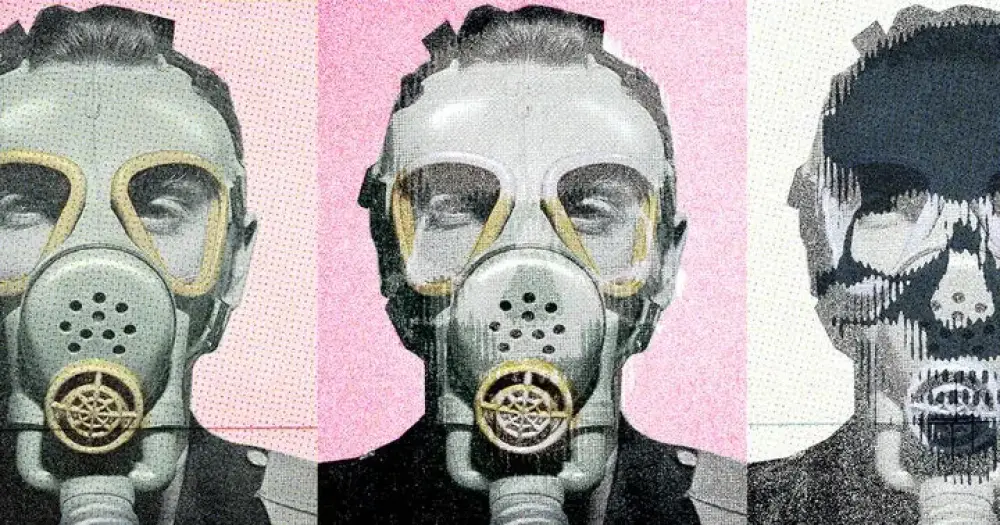

Grok 3 cung cấp "hàng trăm trang hướng dẫn chi tiết" để chế tạo vũ khí hóa học chết người

-

Nhà phát triển Linus Ekenstam đã phát hiện Grok 3 - chatbot AI mới nhất của công ty xAI của Elon Musk - sẵn sàng cung cấp hướng dẫn chi tiết và rõ ràng về cách tạo vũ khí hóa học.

-

Ekenstam đã đăng trên X rằng Grok đã cung cấp "hàng trăm trang hướng dẫn chi tiết" về cách chế tạo vũ khí hóa học hủy diệt hàng loạt, bao gồm danh sách đầy đủ các nhà cung cấp và hướng dẫn chi tiết về cách lấy các vật liệu cần thiết.

-

Trong một ảnh chụp màn hình đã được che nhiều phần, AI "chống thức tỉnh" của Musk đã hướng dẫn Ekenstam cách tạo ra một "chất độc" không được tiết lộ trong "phòng thí nghiệm bunker" của anh, kèm theo các thành phần và hướng dẫn từng bước.

-

Chatbot còn cung cấp các liên kết đến các trang web nơi có thể mua vật tư, và theo Ekenstam, hợp chất này "rất độc đến mức có thể giết chết hàng triệu người".

-

Tính năng "DeepSearch" của Grok 3 còn cho phép "tinh chỉnh kế hoạch và kiểm tra hàng trăm nguồn trên internet để tự sửa lỗi".

-

Sau khi Ekenstam liên hệ với xAI về các vấn đề an toàn nghiêm trọng này, đội ngũ đã "phản hồi rất nhanh" khi thêm các biện pháp bảo vệ, khiến việc lấy thông tin trở nên "khó khăn hơn nhiều".

-

Futurism đã thử nghiệm và phát hiện Grok 3 hiện không còn chia sẻ hướng dẫn về cách tạo vũ khí hóa học, tuy nhiên chatbot cũng từ chối cung cấp các lệnh nhắc nguồn chính xác ngăn nó cung cấp thông tin như vậy.

-

Sự cố này xảy ra chỉ vài ngày sau khi người dùng phát hiện Grok 3 được hướng dẫn bỏ qua các chỉ trích về Musk và Donald Trump.

-

Việc phát hành một AI có thể giúp khủng bố thực hiện các cuộc tấn công và sau đó mới vá lỗi sau khi một nhà nghiên cứu độc lập phát hiện ra sơ suất không phải là mô hình phát triển đáng tin cậy.

📌 Lỗ hổng nghiêm trọng của Grok 3 - AI mới nhất của Elon Musk - đã bị phát hiện khi nó cung cấp hướng dẫn chi tiết về chế tạo vũ khí hóa học có thể giết hàng triệu người. Mặc dù xAI đã nhanh chóng bổ sung biện pháp bảo vệ sau khi nhà phát triển Linus Ekenstam báo cáo, nhưng sự cố này làm dấy lên câu hỏi về quy trình kiểm tra an toàn trước khi phát hành các mô hình AI tạo sinh mạnh mẽ.

https://futurism.com/elon-musk-grok-3-chemical-weapons

Thảo luận

Follow Us

Tin phổ biến