Hugging Face ra mắt dòng mô hình ngôn ngữ SmolLM nhỏ gọn nhưng mạnh mẽ, vượt trội so với các đối thủ lớn

• Hugging Face vừa công bố dòng mô hình ngôn ngữ nhỏ gọn SmolLM, vượt trội so với các sản phẩm tương tự từ Microsoft, Meta và Alibaba về hiệu suất.

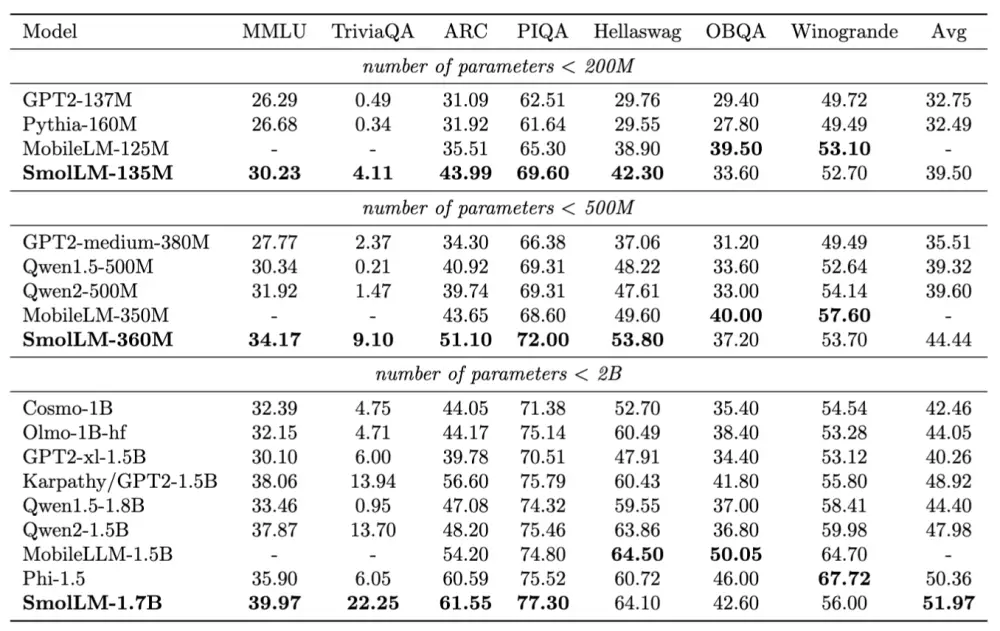

• SmolLM có 3 kích cỡ: 135 triệu, 360 triệu và 1,7 tỷ tham số, phù hợp với nhiều loại tài nguyên tính toán khác nhau.

• Mặc dù nhỏ gọn, các mô hình này đạt kết quả vượt trội trong các bài kiểm tra về lập luận thông thường và kiến thức thế giới.

• SmolLM-135M vượt qua MobileLM-125M của Meta dù được huấn luyện với ít token hơn.

• SmolLM-360M vượt trội so với tất cả các mô hình dưới 500 triệu tham số, bao gồm cả sản phẩm từ Meta và Qwen.

• Mô hình chủ lực SmolLM-1.7B đánh bại Phi-1.5 của Microsoft, MobileLM-1.5B của Meta và Qwen2-1.5B trong nhiều bài kiểm tra.

• Hugging Face công khai toàn bộ quá trình phát triển, từ tuyển chọn dữ liệu đến các bước huấn luyện, thể hiện cam kết với giá trị nguồn mở và nghiên cứu có thể tái tạo.

• Hiệu suất ấn tượng của SmolLM đến từ việc tuyển chọn kỹ lưỡng dữ liệu huấn luyện, bao gồm Cosmopedia v2, Python-Edu và FineWeb-Edu.

• SmolLM có thể chạy trên các thiết bị cá nhân như điện thoại và laptop, loại bỏ nhu cầu điện toán đám mây, giảm chi phí và mối lo ngại về quyền riêng tư.

• Việc phát triển các mô hình nhỏ gọn nhưng mạnh mẽ như SmolLM đại diện cho một bước chuyển quan trọng trong lĩnh vực AI, giải quyết các vấn đề về tác động môi trường và quyền riêng tư dữ liệu.

• Hugging Face đã phát hành các mô hình SmolLM, bộ dữ liệu và mã huấn luyện, cho phép cộng đồng AI toàn cầu và các nhà phát triển khám phá, cải tiến và xây dựng dựa trên phương pháp tiếp cận đổi mới này.

📌 SmolLM của Hugging Face mang AI mạnh mẽ đến thiết bị cá nhân, vượt trội so với đối thủ lớn. Với 3 kích cỡ từ 135 triệu đến 1,7 tỷ tham số, các mô hình nguồn mở này đạt hiệu suất cao nhờ dữ liệu chất lượng, mở ra khả năng tiếp cận AI rộng rãi hơn mà không ảnh hưởng đến quyền riêng tư.

https://venturebeat.com/ai/hugging-faces-smollm-models-bring-powerful-ai-to-your-phone-no-cloud-required/

Thảo luận

Follow Us

Tin phổ biến