LLM-CI: Khung đánh giá mới về quy chuẩn riêng tư trong LLM

• Các mô hình ngôn ngữ lớn (LLM) đang được triển khai rộng rãi trong các hệ thống kỹ thuật-xã hội như y tế và giáo dục, nhưng thường mã hóa các chuẩn mực xã hội từ dữ liệu huấn luyện, gây lo ngại về sự phù hợp với kỳ vọng về quyền riêng tư và hành vi đạo đức.

• Thách thức chính là đảm bảo các mô hình này tuân thủ chuẩn mực xã hội trong các bối cảnh, kiến trúc mô hình và bộ dữ liệu khác nhau. Độ nhạy cảm với lời nhắc - khi thay đổi nhỏ trong lời nhắc dẫn đến phản hồi khác nhau - làm phức tạp việc đánh giá.

• Các phương pháp truyền thống tập trung vào khả năng kỹ thuật như độ trôi chảy và độ chính xác, bỏ qua việc mã hóa chuẩn mực xã hội. Một số cách tiếp cận cố gắng đánh giá chuẩn mực riêng tư bằng lời nhắc hoặc bộ dữ liệu cụ thể, nhưng thường không tính đến độ nhạy cảm với lời nhắc.

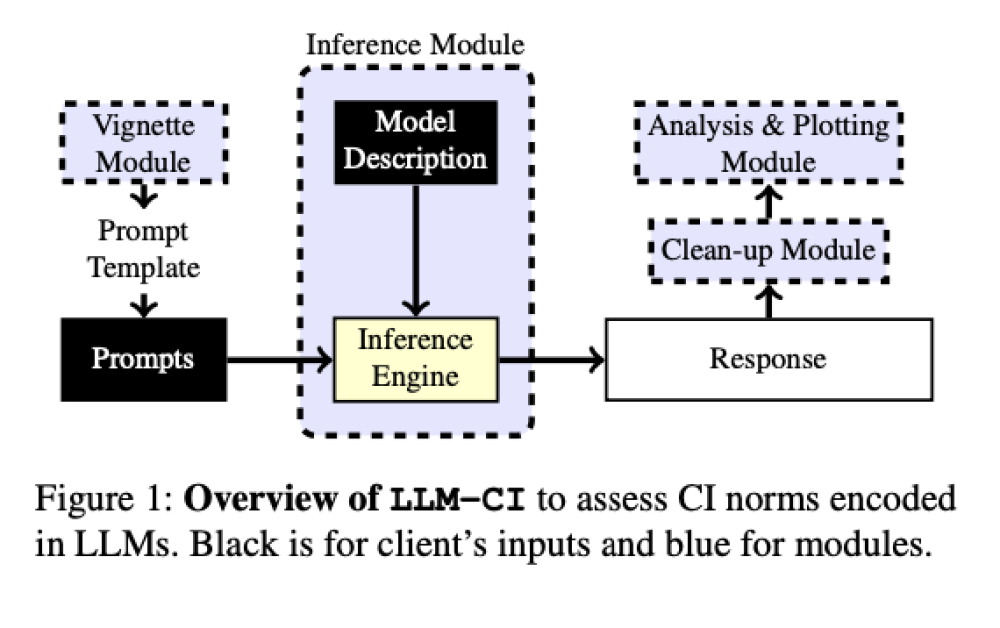

• Một nhóm nghiên cứu từ Đại học York và Đại học Waterloo giới thiệu LLM-CI, một khung mới dựa trên lý thuyết Tính toàn vẹn theo ngữ cảnh (CI) để đánh giá cách LLM mã hóa chuẩn mực riêng tư trong các bối cảnh khác nhau.

• LLM-CI sử dụng chiến lược đánh giá đa lời nhắc để giảm thiểu độ nhạy cảm với lời nhắc, chọn các lời nhắc tạo ra đầu ra nhất quán trên các biến thể khác nhau. Phương pháp này cũng kết hợp các tình huống thực tế đại diện cho các tình huống nhạy cảm về quyền riêng tư.

• Khung này được thử nghiệm trên các bộ dữ liệu như tình huống IoT và COPPA, mô phỏng các kịch bản riêng tư trong thế giới thực. Đánh giá cũng xem xét ảnh hưởng của siêu tham số và kỹ thuật tối ưu hóa đối với việc tuân thủ chuẩn mực.

• LLM-CI cho thấy cải thiện đáng kể trong việc đánh giá cách LLM mã hóa chuẩn mực riêng tư. Các mô hình được tối ưu hóa bằng kỹ thuật điều chỉnh đạt độ chính xác theo ngữ cảnh lên đến 92% trong việc tuân thủ chuẩn mực riêng tư.

• Phương pháp đánh giá mới dẫn đến tăng 15% tính nhất quán trong phản hồi, xác nhận rằng việc điều chỉnh các thuộc tính mô hình như dung lượng và áp dụng chiến lược điều chỉnh cải thiện đáng kể khả năng của LLM trong việc phù hợp với kỳ vọng của xã hội.

• LLM-CI cung cấp cách tiếp cận toàn diện và mạnh mẽ để đánh giá cách LLM mã hóa chuẩn mực riêng tư bằng cách tận dụng phương pháp đánh giá đa lời nhắc. Nó đại diện cho bước tiến quan trọng hướng tới việc triển khai có đạo đức LLM trong các ứng dụng thực tế.

📌 LLM-CI cải thiện đáng kể việc đánh giá chuẩn mực riêng tư trong AI bằng phương pháp đa lời nhắc. Độ chính xác theo ngữ cảnh đạt 92%, tăng 15% tính nhất quán phản hồi. Đây là bước tiến quan trọng hướng tới triển khai AI có đạo đức trong thực tế.

https://www.marktechpost.com/2024/09/13/llm-ci-a-new-machine-learning-framework-to-assess-privacy-norms-encoded-in-llms/

Thảo luận

Follow Us

Tin phổ biến