Mistral ra mắt Codestral Mamba - mô hình AI tạo mã nguồn nhanh hơn, dài hơn và Mathstral chuyên toán học, khoa học

• Mistral, startup AI Pháp, vừa ra mắt 2 mô hình ngôn ngữ lớn (LLM) mới: Codestral Mamba cho lập trình viên và Mathstral cho toán học/khoa học.

• Codestral Mamba 7B sử dụng kiến trúc Mamba mới, giúp tăng tốc độ suy luận và mở rộng ngữ cảnh so với kiến trúc transformer thông thường.

• Mô hình này có thể xử lý đầu vào lên tới 256.000 token, gấp đôi GPT-4 của OpenAI.

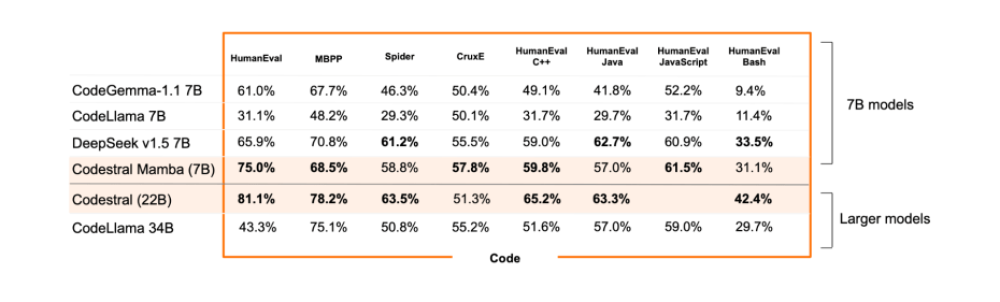

• Trong các bài kiểm tra HumanEval, Codestral Mamba vượt trội hơn các mô hình nguồn mở đối thủ như CodeLlama 7B, CodeGemma-1.17B và DeepSeek.

• Codestral Mamba được cung cấp miễn phí trên API la Plateforme của Mistral, với giấy phép nguồn mở Apache 2.0.

• Mathstral 7B là mô hình AI chuyên biệt cho lập luận toán học và khám phá khoa học, được phát triển cùng với Project Numina.

• Mathstral có cửa sổ ngữ cảnh 32K và cũng sử dụng giấy phép nguồn mở Apache 2.0.

• Mistral tuyên bố Mathstral vượt trội hơn mọi mô hình được thiết kế cho lập luận toán học.

• Cả hai mô hình đều có thể truy cập qua la Plateforme của Mistral và HuggingFace.

• Mistral gần đây đã huy động được 640 triệu USD trong vòng gọi vốn Series B, nâng định giá lên gần 6 tỷ USD.

• Công ty cũng nhận được đầu tư từ các gã khổng lồ công nghệ như Microsoft và IBM.

• Mistral đang cạnh tranh mạnh mẽ với các nhà phát triển AI khác như OpenAI và Anthropic.

• Tạo mã và trợ lý lập trình đã trở thành ứng dụng phổ biến của các mô hình AI, với các nền tảng như GitHub Copilot, Amazon CodeWhisperer và Codenium ngày càng được ưa chuộng.

📌 Mistral tung ra 2 mô hình AI mới: Codestral Mamba cho lập trình với 256.000 token và Mathstral cho toán học. Cả hai đều nguồn mở, miễn phí và vượt trội so với đối thủ trong các bài kiểm tra. Mistral đã huy động 640 triệu USD, định giá 6 tỷ USD, cạnh tranh mạnh với OpenAI và Anthropic.

https://venturebeat.com/ai/mistral-releases-codestral-mamba-for-faster-longer-code-generation/

Thảo luận

Follow Us

Tin phổ biến