Nghiên cứu Stanford: Công cụ AI pháp lý vẫn ảo giác và độ chính xác tối đa 65%

- Các công ty như LexisNexis và Thomson Reuters quảng cáo công cụ AI pháp lý của họ có thể giảm thiểu ảo giác nhờ kỹ thuật tạo sinh được tăng cường bởi truy xuất dữ liệu ngoài (RAG). Tuy nhiên, những tuyên bố này thiếu bằng chứng thực nghiệm.

- Nhóm nghiên cứu từ Đại học Stanford và Yale đã tiến hành đánh giá toàn diện về hiệu suất của các công cụ AI pháp lý, tập trung vào LexisNexis và Thomson Reuters. Họ sử dụng một hệ thống RAG để tích hợp việc truy xuất tài liệu pháp lý liên quan với các phản hồi do AI tạo ra.

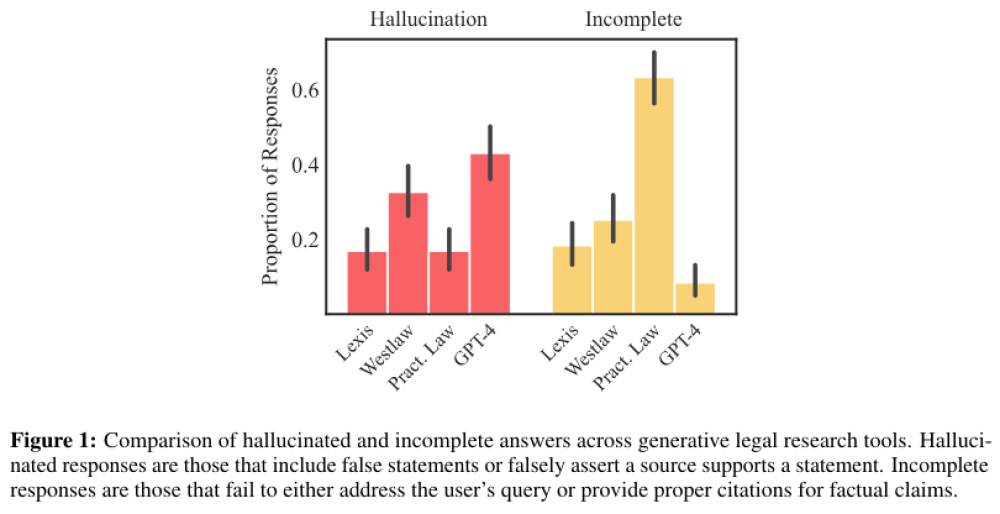

- Kết quả cho thấy mặc dù công cụ của LexisNexis và Thomson Reuters giảm ảo giác so với chatbot đa năng như GPT-4, chúng vẫn có tỷ lệ lỗi đáng kể. Công cụ của LexisNexis có tỷ lệ ảo giác 17%, trong khi công cụ của Thomson Reuters dao động từ 17% đến 33%.

- Công cụ của LexisNexis là hệ thống hoạt động tốt nhất, trả lời chính xác 65% câu hỏi. Ngược lại, công cụ nghiên cứu được hỗ trợ bởi AI của Westlaw chỉ chính xác 42% thời gian nhưng lại gây ảo giác gần gấp đôi so với các công cụ pháp lý khác được thử nghiệm.

📌 Nghiên cứu nhấn mạnh những thách thức dai dẳng về ảo giác trong các công cụ nghiên cứu pháp lý AI. Mặc dù có những tiến bộ trong các kỹ thuật như RAG, những công cụ này vẫn chưa hoàn hảo và đòi hỏi sự giám sát cẩn thận của các chuyên gia pháp lý. Cần tiếp tục cải tiến và đánh giá nghiêm ngặt để đảm bảo tích hợp AI một cách đáng tin cậy vào thực hành pháp lý, đồng thời các luật sư phải cảnh giác trong việc giám sát và xác minh đầu ra của AI.

https://www.marktechpost.com/2024/06/03/are-ai-rag-solutions-really-hallucination-free-researchers-at-stanford-university-assess-the-reliability-of-ai-in-legal-research-hallucinations-and-accuracy-challenges/

Thảo luận

Follow Us

Tin phổ biến