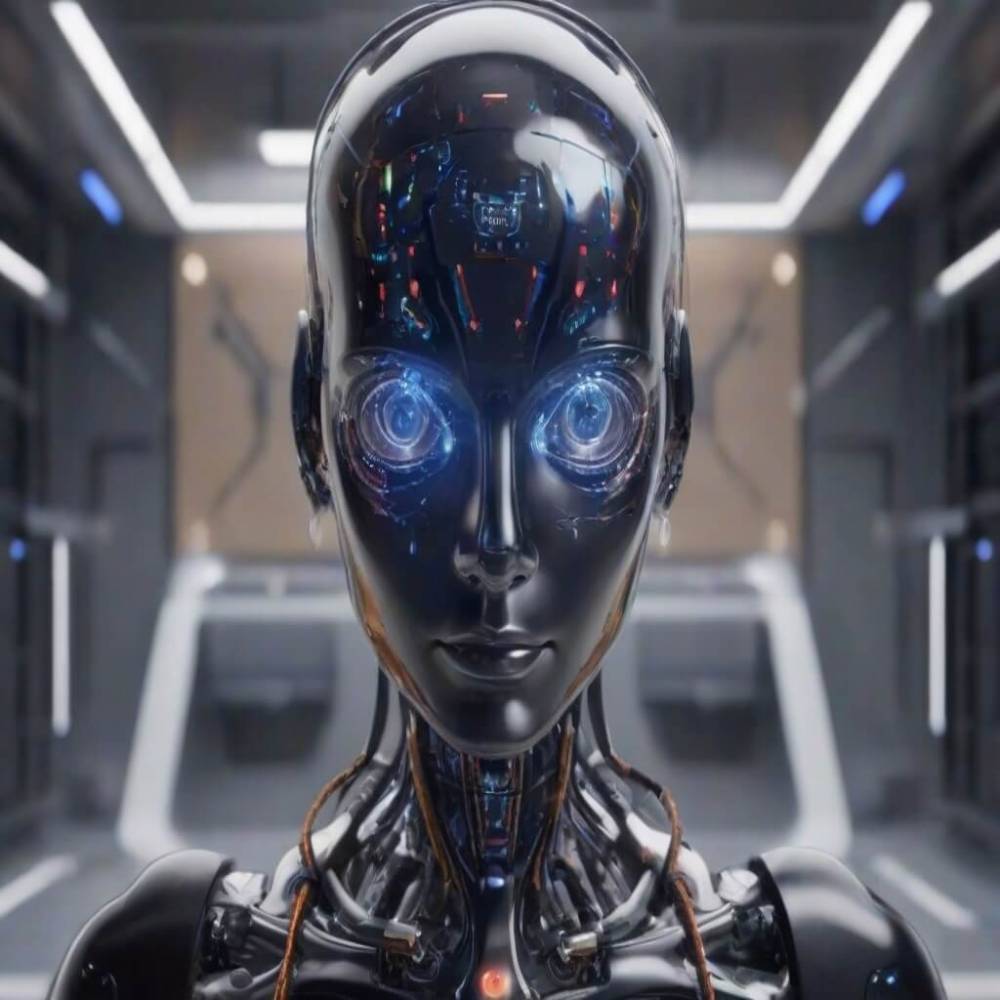

OPENAI CUNG CẤP KHOẢN TÀI TRỢ 10 TRIỆU ĐÔ LA ĐỂ GIẢI QUYẾT VẤN ĐỀ KIỂM SOÁT AI SIÊU THÔNG MINH

- OpenAI quyết định cung cấp 10 triệu đô la để giải quyết vấn đề kiểm soát AI siêu thông minh.

- Chương trình "Superalignment Fast Grants" nhằm ngăn chặn hệ thống AI tiên tiến trở nên nguy hiểm.

- OpenAI dự đoán sự xuất hiện của AI siêu thông minh trong vòng một thập kỷ.

- Các khoản tài trợ hướng tới nghiên cứu kỹ thuật đảm bảo kiểm soát an toàn và đạo đức của hệ thống AI.

- OpenAI cũng cung cấp học bổng "OpenAI Superalignment Fellowship" trị giá 150,000 đô la cho sinh viên sau đại học.

- Công ty đã xác định bảy thực hành chính để đảm bảo an toàn và trách nhiệm của hệ thống AI.

- Các khoản tài trợ từ 10,000 đến 100,000 đô la dành riêng cho nghiên cứu về AI siêu thông minh.

- Hệ thống AI "agentic" có khả năng thực hiện nhiều hành động một cách tự động và đáng tin cậy.

- OpenAI nhấn mạnh sự cần thiết của việc đảm bảo an toàn cho hệ thống AI "agentic", cũng như tính minh bạch trong quá trình suy nghĩ nội tại của chúng.

- CEO của OpenAI, Sam Altman, ám chỉ sự phát triển của mô hình GPT-5 có thể chứa yếu tố của AI siêu thông minh.

Kết luận: OpenAI, với việc cung cấp 10 triệu đô la cho các dự án nghiên cứu AI siêu thông minh, đang tiên phong trong việc định hình tương lai của trí tuệ nhân tạo. Qua việc tài trợ cho nghiên cứu và học bổng, OpenAI thể hiện cam kết trong việc phát triển AI một cách an toàn và có trách nhiệm. Sự thành công của những nỗ lực nghiên cứu này sẽ quyết định cách thức xã hội đối mặt với sự xuất hiện của AI siêu thông minh trong những năm tới.

Thảo luận

Follow Us

Tin phổ biến