Qwen2.5 - cuộc cách mạng mô hình ngôn ngữ mã nguồn mở lớn nhất lịch sử!

- Qwen2.5 là phiên bản nâng cấp của dòng Qwen, bao gồm các mô hình chuyên biệt về lập trình (Qwen2.5-Coder) và toán học (Qwen2.5-Math). Các mô hình này có sẵn ở nhiều kích thước từ 0,5B đến 72B tham số.

- Các mô hình mã nguồn mở này, trừ các phiên bản 3B và 72B, được cấp phép dưới Apache 2.0, với hiệu suất được cải thiện đáng kể so với các phiên bản trước đó như Qwen2 và CodeQwen1.5.

- Qwen2.5 được huấn luyện trên tập dữ liệu khổng lồ với 18 nghìn tỷ token, cải thiện khả năng xử lý mã hóa (HumanEval 85+) và toán học (MATH 80+), hỗ trợ tạo văn bản dài (hơn 8K token) và dữ liệu có cấu trúc như bảng hoặc JSON.

- Các mô hình này còn hỗ trợ đa ngôn ngữ, với hơn 29 ngôn ngữ, bao gồm tiếng Anh, tiếng Trung, tiếng Pháp, tiếng Tây Ban Nha, và tiếng Việt.

- Qwen2.5-Coder được huấn luyện trên 5,5 nghìn tỷ token liên quan đến mã hóa, cho phép các mô hình nhỏ hơn cạnh tranh với các mô hình lớn hơn trong các bài kiểm tra lập trình.

- Qwen2.5-Math kết hợp các phương pháp suy luận nâng cao như Chain-of-Thought (CoT), Program-of-Thought (PoT), và Tool-Integrated Reasoning (TIR) để cải thiện hiệu suất trong toán học.

- Phiên bản Qwen2.5-72B đã được so sánh với các mô hình mã nguồn mở hàng đầu như Llama-3.1-70B và Mistral-Large-V2, cho thấy khả năng vượt trội ở các bài đánh giá hiệu suất.

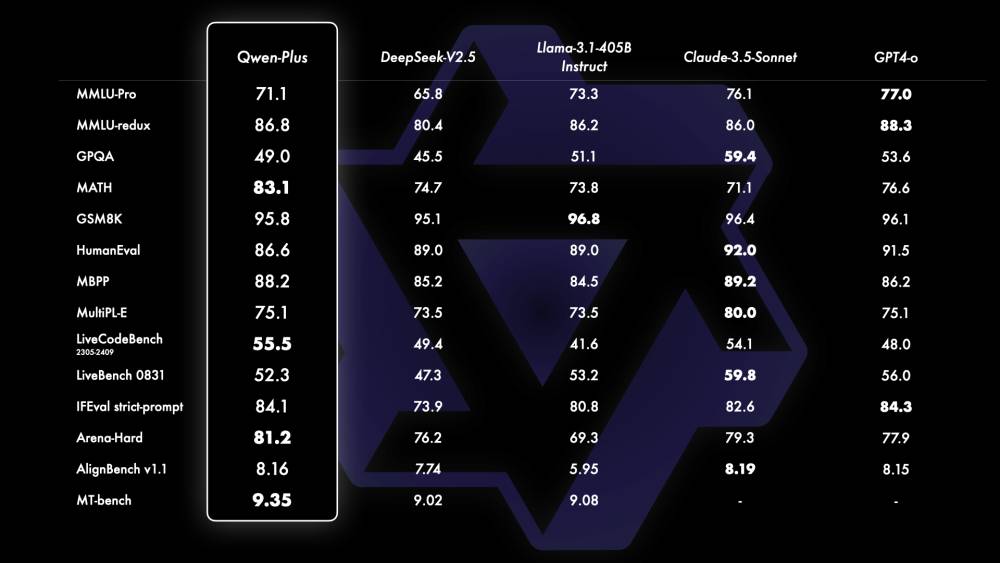

- Qwen-Plus, mô hình API, được so sánh với các mô hình hàng đầu như GPT4-o và Claude-3.5-Sonnet, cho thấy sự cạnh tranh đáng kể trong hiệu suất nhưng vẫn còn những lĩnh vực cần cải thiện.

- Các phiên bản Qwen2.5-14B và Qwen2.5-32B mang lại sự cân bằng tối ưu giữa kích thước mô hình và khả năng, vượt qua các mô hình lớn hơn như Phi-3.5-MoE-Instruct.

- Xu hướng mới trong mô hình ngôn ngữ nhỏ (SLM) đang phát triển mạnh mẽ, với Qwen2.5-3B đạt hiệu suất ấn tượng chỉ với 3 tỷ tham số, cho thấy sự tối ưu hóa về kích thước và khả năng.

- Qwen2.5-Coder và Qwen2.5-Math tiếp tục vượt trội so với các mô hình mã nguồn mở khác trong lập trình và toán học, thậm chí ở quy mô nhỏ nhất như Qwen2.5-Math-1.5B-Instruct.

- Qwen2.5 hỗ trợ triển khai dễ dàng qua các nền tảng như Hugging Face, vLLM và Ollama, cùng với việc tích hợp khả năng gọi công cụ tự động qua API.

📌 Qwen2.5 là bước tiến lớn trong việc phát triển mô hình ngôn ngữ lớn mã nguồn mở, với khả năng cải thiện đáng kể trong lập trình và toán học. Hỗ trợ đa ngôn ngữ, tích hợp công cụ, và tối ưu hóa hiệu suất trên các mô hình nhỏ, Qwen2.5 mở ra nhiều cơ hội mới trong AI.

https://qwenlm.github.io/blog/qwen2.5/

Thảo luận

Follow Us

Tin phổ biến