RAG- giải pháp cho vấn đề chất lượng và bảo mật dữ liệu khi sử dụng LLM trong doanh nghiệp

• Mô hình ngôn ngữ lớn (LLM) là giải pháp AI có thể nhận diện và tạo ra nội dung mới từ nội dung có sẵn. Dự kiến đến năm 2025, 50% công việc kỹ thuật số sẽ được tự động hóa thông qua các mô hình LLM.

• LLM được huấn luyện trên lượng lớn nội dung và dữ liệu, với kiến trúc gồm nhiều lớp mạng nơ-ron như lớp hồi quy, lớp truyền xuôi, lớp nhúng và lớp chú ý.

• AI tạo sinh (GenAI) là một khái niệm rộng hơn, bao gồm các mô hình AI được thiết kế để tạo ra nội dung mới không chỉ là văn bản mà còn cả hình ảnh, âm thanh và video.

• Các LLM phổ biến như GPT-4, Gemini và Claude được sử dụng rộng rãi trong công chúng, nhưng việc áp dụng trong doanh nghiệp còn chậm do hai vấn đề chính: chất lượng dữ liệu và bảo mật/quyền riêng tư dữ liệu.

• Vấn đề chất lượng dữ liệu: LLM được huấn luyện trên lượng lớn dữ liệu công khai, khó kiểm tra và kiểm duyệt về độ chính xác, tính thời sự và sự phù hợp. Điều này dẫn đến hiện tượng "ảo giác" hoặc phản hồi không chính xác.

• Vấn đề bảo mật và quyền riêng tư: Dữ liệu doanh nghiệp thường là tài sản có giá trị và cần được bảo vệ, không thể chia sẻ rộng rãi trên internet.

• Giải pháp "fine-tuning" giúp điều chỉnh các lớp cuối của LLM để phù hợp với dữ liệu cụ thể của doanh nghiệp, nhưng quá trình này tốn kém và rủi ro.

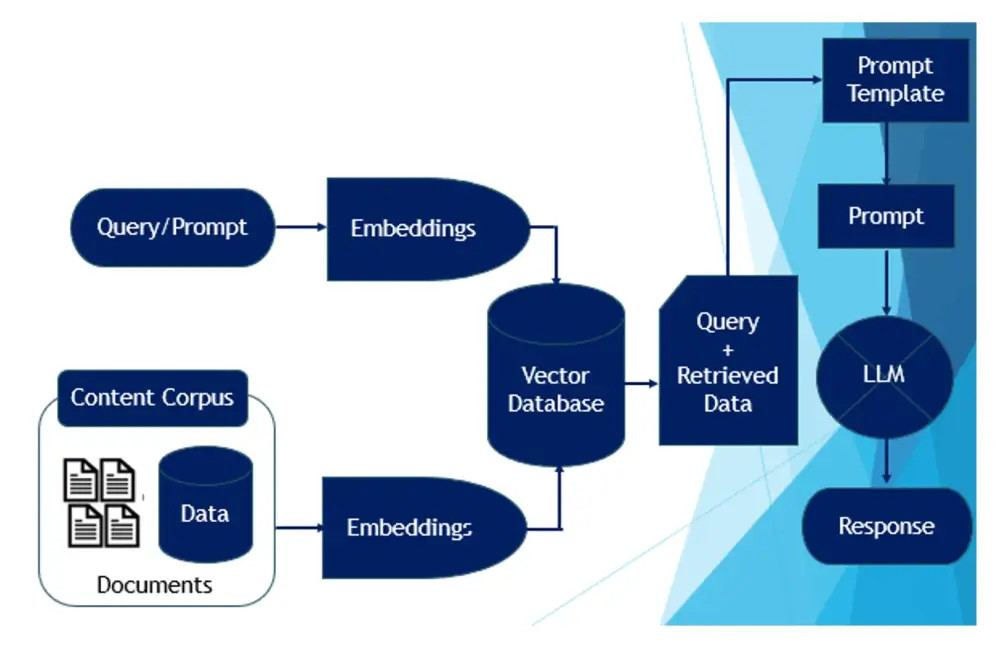

• RAG (Retrieval Augmented Generation) là một giải pháp khác, kết hợp cơ chế truy xuất với mô hình tạo sinh để tạo ra phản hồi chính xác và phù hợp với ngữ cảnh hơn.

• RAG hoạt động bằng cách xử lý nội dung thành các vector, lưu trữ trong cơ sở dữ liệu vector. Khi có truy vấn, hệ thống tìm kiếm các phần tương tự nhất trong cơ sở dữ liệu và sử dụng chúng làm ngữ cảnh cho LLM để tạo ra phản hồi cuối cùng.

• RAG có ưu điểm là tích hợp thông tin từ cơ sở kiến thức chính xác và tùy chỉnh, giảm thiểu rủi ro LLM đưa ra phản hồi chung chung hoặc không liên quan.

• Tuy nhiên, RAG vẫn phụ thuộc vào chất lượng, độ chính xác và tính toàn diện của thông tin trong cơ sở kiến thức.

• Việc triển khai RAG thường gồm 5 giai đoạn chính: huấn luyện bộ truy xuất, truy xuất tài liệu, huấn luyện bộ tạo sinh, tạo phản hồi, và tích hợp & tối ưu hóa.

📌 RAG là giải pháp hứa hẹn cho việc sử dụng LLM trong doanh nghiệp, giải quyết vấn đề chất lượng và bảo mật dữ liệu. Kết hợp truy xuất và tạo sinh, RAG nâng cao khả năng tạo phản hồi chính xác và phù hợp ngữ cảnh. Tuy nhiên, chất lượng dữ liệu vẫn là yếu tố quyết định thành công của RAG.

https://www.dataversity.net/rag-retrieval-augmented-generation-architecture-for-data-quality-assessment/

Thảo luận

Follow Us

Tin phổ biến